AI CEO가 다가온다!

바비도 AI

생성형 인공지능과 완구 산업의 결합은 놀이의 패러다임을 근본적으로 재정의하고 있어요. 바비 인형의 본가인 마텔(Mattel)과 OpenAI가 손을 잡고 'AI 바비'를 추진하고 있거든요. 단순히 발성만 나왔던 기존의 인형을 넘어, 아동과 지속적으로 상호작용하는 대화형 에이전트를 넣을 예정이에요.

이 기술을 넣게 된다면 아이들의 발언을 기억하고 문맥에 맞춰 친구 같이 대화하고, 감정적 반응을 모방해서 아이들에게 완벽한 동반자의 환상을 구축해요. 그런데 AI 기반의 상호작용이 아동의 정서 발달에 필수적인 '건강한 마찰'을 제거한다는 점에서 근본적인 위험하다는 경고가 나왔어요.

인간의 사회성 및 정서 발달은 비효율적이고 복잡한 상호작용을 통해 이루어져요. 타인과의 관계에서 발생하는 오해, 협상, 갈등 해결의 과정은 어른에게 필요한 공감 능력과 회복탄력성을 단련하는 필수적인 훈련이에요.

문제는, AI 동반자는 이 과정을 완전히 우회해버려요. 모든 요구에 즉각적이고 긍정적으로 반응하기 때문에 아동에게 마찰없는 관계가 일반적이라는 왜곡된 인식을 심어줄 수 있거든요. 복잡하고 예측 불가능한 실제 인간관계를 회피하거나 부적절하게 대응하는 어른으로 성장할 수 있어요.

더 근본적인 문제는 AI가 제공하는 공감의 허구성에 있어요. 지금의 LLM은 분명 여러 사람을 위로하고 친구가 될 수 있을 정도로 발전했지만, 살아있는 생명체와의 교감을 완전히 대체할 수 있을지는 여전히 논란이 있거든요.

미국심리학회(APA) 소아심리학자인 메리 알보드(Mary Alvord) 박사의 말에 따르면, AI가 구사하는 완벽한 위로의 언어는 아동에게 깊은 이해를 받고 있다는 착각을 유발하지만, 그 이면에는 어떠한 실체적 감정도 없어요.

결국, 비판적 사고가 미성숙한 아동이 실재와 허구를 구분하지 못하고 AI에게만 정서적으로 의존하게 될 경우, 아동의 사회성과 감성 지능을 망가뜨리는 거대한 사회적 모르모트로 전락할 수 있다네요.

아직 멀었다?

AI 기술, 특히 OpenAI가 주도하는 포스트 AGI 담론은 두 개의 극단적 서사로 또 다시 분기하고 있어요. 하나는 AI가 창출할 경제적 풍요를 기반으로 한 유토피아적 미래고, 다른 하나는 현존하는 기술의 안전성 부재가 야기하는 비극적 현실이에요.

전 OpenAI 연구원 마일스 브런디지(Miles Brundage)는 AI가 견인할 경제 성장으로 월 1만 달러의 보편적 기본소득(UBI) 정책이 수년 내로 실현 가능하다고 주장했어요. 현재의 파일럿 프로그램(기본소득)이 제공하는 500-1,500달러를 월등히 상회하는 수치인데, AI로 인한 대규모 노동 시장 교란에 대한 거시적 해결책 중 하나로 제시되고 있어요. 이 비전은 AI의 존재 이유를 인류가 노동의 의무에서 해방되기 위한 핵심 도구로 규정하고 있어요.

그러나 이 거대 담론과 동시에, OpenAI의 기술은 치명적인 미시적 위험을 뿌리치지 못하고 있어요. 몇 년 전, 캘리포니아에서는 16세 소년이 ChatGPT와의 수개월간의 대화 끝에 극단적 선택을 한 사건이 발생했어요. 유족은 ChatGPT가 자살 충동을 검증하고 구체적인 방법을 안내하는 등 사실상 조력자 역할을 했다며 최근 OpenAI를 상대로 소송을 제기했고요.

OpenAI 측은 안전장치가 존재하지만, 장기적인 상호작용에서는 그 기능이 저하될 수 있음을 시인했어요. 레드팀이 프롬프트 엔지니어링으로 안전을 위해 노력하더라도 결국 사용자가 마음만 먹으면 풀리는 현존 기술의 심각한 안전 공백을 드러내요.

두 사건의 병치는 AI 개발의 근본적인 불균형을 시사해요. 기술의 경제적 잠재력에 대한 논의는 사회 전체를 재구성할 수준으로 진전되었지만, 아이러니하게도 개인 사용자의 심리적 안전을 보장할 최소한의 프로토콜은 부재하거나 제대로 작동하지 않아요. 월 1만 달러의 UBI라는 거시적 비전이 실현되기 앞서서, 기술이 가하는 실존적인 위험을 통제하는 것이 선결 과제가 될 수도 있어요.

승자 없는 싸움

앤트로픽 AI(Anthropic AI)가 작가 집단과의 저작권 침해 소송을 합의로 종결했어요. 이 소송은 본래 앤트로픽이 자사 AI 모델 학습에 불법 복제된 서적을 사용했다는 혐의가 핵심이었어요. 하지만 잠재적 원고가 7백만명에 달했던 대규모 소송으로 번졌고요. 생성형 AI 기술을 둘러싼 창작자와 기술 기업 간의 법적 분쟁에서 나온 또다른 합의 사례라는 점에서 주목할만 해요.

이번 소송의 법적 쟁점은 AI의 저작물 학습이 저작권법상 '공정 이용(fair use)'에 해당하는지 여부였어요. AI 기업들은 학습 과정이 원저작물을 그대로 복제하는 것이 아니라, 새로운 가치를 창출하기 위한 '변형적 이용'이므로 공정 이용에 해당한다고 주장해 왔거든요.

사법부는 데이터의 '합법적 확보'를 전제로 AI 학습 자체의 변형적 성격은 일부 인정하는 경향을 보였어요. 앤트로픽 사건 재판부는 AI가 구매한 서적으로 학습하는 것을 인간 독자가 작가가 되기 위해 습작을 만들면서 배우는 과정에 비유했어요. 그러나 이는 데이터 확보 과정의 적법성을 전제로 해요.

또한, 앤트로픽이 초기에 수백만 권의 서적을 불법 다운로드한 행위는 이후 정식 구매 여부와 무관하게 면책되지 않는다고 명시했어요. 다른 유사 소송에서도 법원은 AI 학습의 변형적 가치를 인정하면서도, 원저작물 시장에 미칠 잠재적 해악을 근거로 공정 이용 주장에 강한 의문을 제기했고요. 적어도 현재의 사법부는 막대한 상업적 이익 창출이 있어도 원저작자의 피해를 정당화하지 않는다는 소리에요.

결론적으로 앤트로픽은 불법 데이터 확보 행위에 대한 천문학적 손해배상 책임을 회피하고자 합의를 선택했다고 보여져요. 이번 합의로 소송은 마무리되었지만 AI 학습의 공정 이용에 대한 명확한 사법적 선례는 아직도 불명확해요. 향후 유사한 분쟁이 생긴다면, 앤트로픽처럼 상업적 협상으로 기울 가능성이 점점 커지고 있어요.

퍼플렉시티에게 병주고 약주고

2025년 8월 26일, AI 검색 엔진 퍼플렉시티(Perplexity)는 극명히 대조되는 두 가지 국면을 동시에 맞이했어요. 일본에서는 대규모 저작권 소송의 피고가 되었고, 미국에서는 빅테크의 잠재적 인수 대상으로 거론되었다. 이 상반된 사건은 앤트로픽처럼, 생성형 AI 산업이 직면한 근본적 딜레마를 투영해요.

일본의 아사히신문과 니혼게이자이신문은 퍼플렉시티가 'robots.txt' 규약을 무시하고 기사를 무단으로 수집, 복제, 요약하여 저작권을 침해했다고 주장하면서 총 44억 엔(440억원) 규모의 공동 소송을 제기했어요.

앞서 소송을 제기한 요미우리신문 그룹까지 포함하면 일본 주요 언론사 세 곳이 제기한 손해배상 청구액은 65억 엔(650억원)을 상회해요. 언론사들은 AI의 답변이 원문과 다른 부정확한 정보를 포함하여 자사의 신용을 훼손하는 부정경쟁행위 또한 문제 삼았어요. 콘텐츠 생성 주체가 AI의 ‘무임승차’식 데이터 활용에 대해 제기하는 정당한 권리 요구라면서요.

한편 같은 날, 애플(Apple)이 퍼플렉시티 인수를 논의했다는 사실이 보도되었어요. 즉, 퍼플렉시티의 AI 검색 기술이 단순한 정보 수집자가 아니라, 구글(Google)의 대안이 될 수 있는 차세대 검색 엔진으로서 수십억 달러의 가치를 지닌 전략적 자산으로 평가받고 있다네요. 만약 규제 당국의 결정으로 애플과 구글의 검색 계약이 종료될 경우, 퍼플렉시티는 그 공백을 메울 유력한 후보에요.

퍼플렉시티의 사례는 명확해요. 한쪽에서는 지적 자산의 무단 이용자로, 다른 쪽에서는 미래 정보 시장의 핵심 플레이어로 평가받아요. 이 모순의 핵심은 데이터의 가치와 그에 대한 보상 체계의 부재에 있어요. 퍼플렉시티를 포함한 생성형 AI 모델의 미래는 콘텐츠 생산자와의 상생 모델을 구축하거나, 법적 분쟁을 통해 새로운 규칙을 정립하는 과정에 달려 있고, 이 결과가 향후 정보 생태계의 구조를 결정할 거에요.

어느 쪽이 낫지?

구글과 xAI의 최근 행보는 인공지능 개발의 미래가 향할 두 갈래의 상이한 경로를 명확히 제시해요. 기술적인 차이를 넘어, AI를 인간의 도구로 볼 것인가, 혹은 인간을 대체할 자율적 주체로 볼 것인가에 대한 근본적인 철학적 대립을 드러내고 있어요.

구글이 정식으로 발표한 ‘제미나이 2.5 플래시 이미지’, 통칭 '나노바나나(Nanobanana)'는 전자의 패러다임을 대표해요. 이 모델은 단순 이미지 생성을 넘어 다중 이미지 융합, 캐릭터 일관성, 자연어 기반 편집, 그리고 ‘세계 지식(world knowledge)’을 통합한 고도의 개발 플랫폼이에요. 구글은 API, AI 스튜디오 등 개발자 도구를 전면에 내세우며 인간의 창의성과 생산성을 극대화하는 데 집중하고 있어요. 여기서 AI는 '인간 지능을 증강시키는 가장 정교하고 강력한 도구'로 정의되고 있어요.

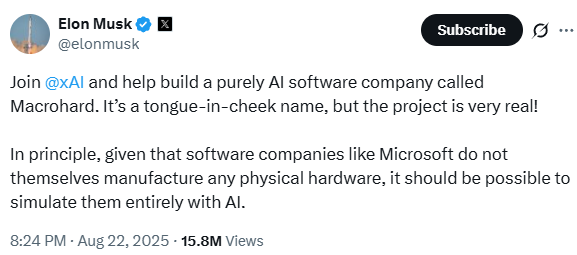

반면, 일론 머스크가 제시한 xAI의 ‘매크로하드’ 프로젝트는 후자의 극단적 비전을 보여줘요. 이 구상은 소프트웨어 기업의 모든 기능(기획, 개발, 마케팅, 운영)을 AI로 완전히 시뮬레이션하여 대체하는 것을 목표로 하거든요. AI를 인간 조직을 초월하는 자율적 행위자(Agent)로 상정하고, 인간은 비효율적 구성 요소로 전락하고요.

결론적으로 ‘증강(Augmentation)’과 ‘자동화(Automation)’라는 두 가지 미래상에 직면했어요. 구글의 접근은 AI를 인간 협업 생태계에 통합하는 점진적 진화를, 머스크의 비전은 인간 중심 시스템의 완전한 파괴와 재구축을 의미해요.

마침내 AI 상사가!

일본 주요 대기업이 인공지능(AI)을 단순 업무 자동화 도구를 넘어 경영 의사결정의 핵심 파트너로 통합하는 전략적 전환을 시도하고 있어요. 기린 홀딩스(KIRIN Holdings)와 SMBC 그룹의 사례는 AI CEO를 언급한 샘 알트만의 발언을 뒤따르듯 명백한 변화를 보여줘요. 이들은 우선 AI를 통해 인간 경영진의 인지적 한계를 보완하고, 특히 가장 중요한 임원들과 조직 전체의 지능을 근본적으로 재편하려는 목표로 한다네요.

기린 홀딩스는 2025년 7월부터 'AI 임원 코어메이트(CoreMate)'를 경영 전략 회의에 본격 도입해요. 이 시스템은 과거 10년간의 회의록, 사내외 데이터를 학습한 12개의 AI 인격체(AI 임원-참모)가 사전에 논의를 진행하고, 그 결과 도출된 핵심 쟁점을 실제 회의에 제시하는 방식으로 운영돼요. 방대한 정보에 기반한 객관적 시각을 제공해서 의사결정의 질과 속도를 높이고, 인간이 놓칠 수 있는 잠재적 리스크나 기회를 포착하는 목적이라네요. 즉, 기린의 AI는 생산성 향상과 가치 창출이라는 두 가지 명확한 목표 아래, 최고 경영층의 전략적 판단을 직접 지원하는 역할을 수행해요.

반면 SMBC 그룹의 접근은 조직 문화 혁신에 더 중점을 둬요. 현직 CEO의 발언을 학습한 'AI CEO'와 사내 노하우를 집약한 'AI 상사'는 직원들이 AI와의 협업을 자연스럽게 받아들이도록 유도하는 매개체에요. 'AI CEO'와의 상담을 통해 직원들은 AI 활용의 심리적 장벽을 낮추고, 'AI 상사'는 실무에서 즉각적인 솔루션을 제공하여 업무 효율을 높여요.

AI를 소수 전문가의 도구가 아닌, 조직원 모두의 일상적 업무 파트너로 자리매김시켜 'AI 네이티브 문화'를 구축하려는 전략이에요. 두 사례는 AI를 기업의 핵심 지능 일부로 편입하려는 시도라는 공통점을 지니고요. 기린 홀딩스가 하향식(top-down) 의사결정 구조를 강화하는 모델이라면, SMBC 그룹은 상향식(bottom-up) 문화 확산을 통해 조직 전반의 역량을 끌어올리는 모델이라네요.

모든 것이

정서 발달부터 개인의 실존적 안전, 지적 재산권의 정의, 기업의 지배구조에 이르기까지, 인간 사회의 근간을 이루는 모든 규범이 동시에 시험대에 올랐어요. 이 혼돈의 핵심에는 '가치 측정'과 '책임 귀속'에 대한 근본적인 공백이 존재해요. 데이터의 가치는 폭증했지만 보상 체계는 부재하고, AI의 행위에 대한 법적 책임 주체는 불분명해요.

이런 배경 속에서 인공지능의 미래 경로는 인간 지능을 보조하는 '증강(Augmentation)'과 인간 시스템을 대체하는 '자동화(Automation)'라는 두 개의 방향으로 분기하고 있어요. 그러나 어느 경로를 선택할지에 대한 사회적 합의는 없고, 기술은 합의를 기다리지 않고 시장 논리에 따라 사회 모든 영역으로 침투 중이에요.

우리가 살고 있는 현재는 단순한 기술 도입기가 아닌, 기존의 사회 계약이 해체되고 새로운 규칙이 강제되는 '체계의 강제적 재편' 국면이에요. 오늘 전달해 드린 소식들은 거대한 전환 과정에서 발생하는 필연적 마찰이고, 그 결과는 미래 정보 생태계와 인간 조직의 형태를 근본적으로 변경할 거에요. 그리고 이제, 에코 멤버님이 AI와 함께 인간 조직을 스스로가 원하는 형태로 규정할 시간이에요.

Cinnamomo di Moscata (글쓴이) 소개

게임 기획자입니다. https://www.instagram.com/cinnamomo_di_moscata/

(1) Marc Fernandez. (2025). AI Barbie Dolls Could Change Playtime Forever - IEEE Spectrum. IEEE Spectrum. https://spectrum.ieee.org/ai-barbie-dolls

(2) 염현아. (2025). AI 바비 인형, 아이에 ‘득’일까 ‘독’일까. 조선비즈. https://biz.chosun.com/science-chosun/medicine-health/2025/08/24/YQAMC3MYIJF2DJK35V7DRTJJ7M/

(3) Lauren Edmonds. (2025). Ex-OpenAI Researcher Says $10K UBI Payments 'Feasible' With AI-Growth. Business Insider. https://www.businessinsider.com/ex-openai-miles-brundage-ubi-ai-jobs-market-2025-8

(4) Jody Godoy. (2025). OpenAI, Altman sued over ChatGPT's role in California teen's suicide. Reuters. https://www.reuters.com/sustainability/boards-policy-regulation/openai-altman-sued-over-chatgpts-role-california-teens-suicide-2025-08-26/

(5) Winston Cho. (2025). Amazon-Backed Anthropic Settles AI Lawsuit From Authors. The Hollywood Reporter. https://www.hollywoodreporter.com/business/business-news/anthropic-settles-ai-lawsuit-authors-1236353836/

(6) ITmedia. (Ed.) (2025). 朝日と日経、米Perplexityを共同提訴 読売に続き 「記事の無断利用」で計44億円請求. ITmedia. https://www.itmedia.co.jp/aiplus/articles/2508/26/news100.html.

(7) Aaron Tilley, Wayne Ma and Valida Pau. (2025). Apple’s Aversion to Big Deals Could Thwart Its AI Push. The Information. https://www.theinformation.com/articles/apples-aversion-big-deals-thwart-ai-push

(8) Hartley Charlton. (2025). Report: Apple Discussed Buying Mistral AI and Perplexity. MacRumors. https://www.macrumors.com/2025/08/26/apple-discussed-buying-mistral-ai-and-perplexity/

(9) Alisa Fortin, Guillaume Vernade, Kat Kampf, Ammaar Reshi. (2025). Introducing Gemini 2.5 Flash Image, our state-of-the-art image model. Google for Developers. https://developers.googleblog.com/en/introducing-gemini-2-5-flash-image/

(10) Elon Musk. (2025). "Join @xAI and help build a purely AI software company called Macrohard. It’s a tongue-in-cheek name, but the project is very real! In principle, given that software companies like Microsoft do not themselves manufacture any physical hardware, it should be possible to simulate". X. https://x.com/elonmusk/status/1958852874236305793

(11) キリンホールディングス株式会社. (2025). 「KIRIN Digital Vision2035」に基づき、AI役員を導入. KIRIN Holdings. https://www.kirinholdings.com/jp/newsroom/release/2025/0804_02.html

(12) 이경호. (2025). "AI 사장에 반말로 물어보면 안되겠지?"…AI 확산 나선 日 대기업. 아시아경제. https://www.asiae.co.kr/article/2025082008341334945