길잡이가 필요한 여정!

AI 과학자!

중력파가 사실로 증명되면서 과학자들은 우주의 모습을 더 잘 알기 위해서 중력을 '듣기' 위한 특이한 도구들을 개발하기 시작했어요. 그런데 놀랍게도, AI인 '우라니아(Urania)'가 인간의 상상을 뛰어넘는 새로운 중력파 검출기 설계에서 핵심적인 역할을 담당했다고 해요.

이 '우라니아'는 마리오 크렌(Mario Krenn) 박사 연구팀이 개발했는데, 기존의 LIGO 검출기보다 뛰어난 성능을 가진 실험적 디자인들을 제시해 큰 주목을 받고 있어요. AI는 기존에 알려진 방식뿐만 아니라, 때로는 우리가 전혀 예상치 못한 획기적인 접근법을 스스로 발견해 내기도 하거든요. 놀랍고도 창의적인 이 결과물들은 "디텍터 주(Detector Zoo)"라는 이름으로 불리면서 전 세계 연구자들에게 공유되고 있다고 해요.

이런 혁신적인 시도는 단순한 기술 발전을 넘어, 인간과 기계가 함께 새로운 우주 탐사의 지평을 열어가고 있다는 점에서 의미가 커요.

누구보다 빠르게

AI 기술이 놀라울 정도로 발전하면서 우리 사회의 여러 분야에 큰 변화가 찾아오고 있는데, 그 중 하나가 보수적이기로 악명 높은 법률 분야에요. 하지만 최근 UAE에서는 세계 최초로 AI를 활용한 입법 방식을 선언했다고 해요.

기존에는 법률 제정이 전문가와 시민들의 오랜 검토와 토론을 통해 이루어졌고, 그마저도 여러 한계로 인해 많은 비판을 받았어요. 하지만 UAE의 사례를 참고해보면, AI의 도움으로 보다 신속하고 효율적인 법률 체계를 고민할 수 있게 된 것 같아요. 물론, AI가 얼마만큼 효과적으로 법안을 만들어줄지는 미지수지만, 이런 시도가 사회에 긍정적인 변화를 가져올 가능성을 충분히 보여주는 것 같아 마음이 설레네요.

한편, 영화 종사자와 팬이라면 누구나 알고 있는 오스카 시상식, 이 오스카 시상식에서 AI 관련 소식이 전해졌어요. 바로 앞으로는 영화 제작에 AI를 사용해도 더 이상 수상에 불이익을 주지는 않는 소식이에요. 다만, 작품의 가치는 얼마나 인간의 창의력이 담겨 있는지에 달렸다고 하니, 기술의 도움을 받더라도 결국 사람의 손길이 중요하다는 메시지가 담겨 있는 것 같네요.

변화하는 시대 속에서 전통과 혁신이 어우러지는 모습을 보며, 우리 모두 앞으로의 영화계와 예술 발전을 지켜보면 좋겠어요.

AI도 취향이 있어

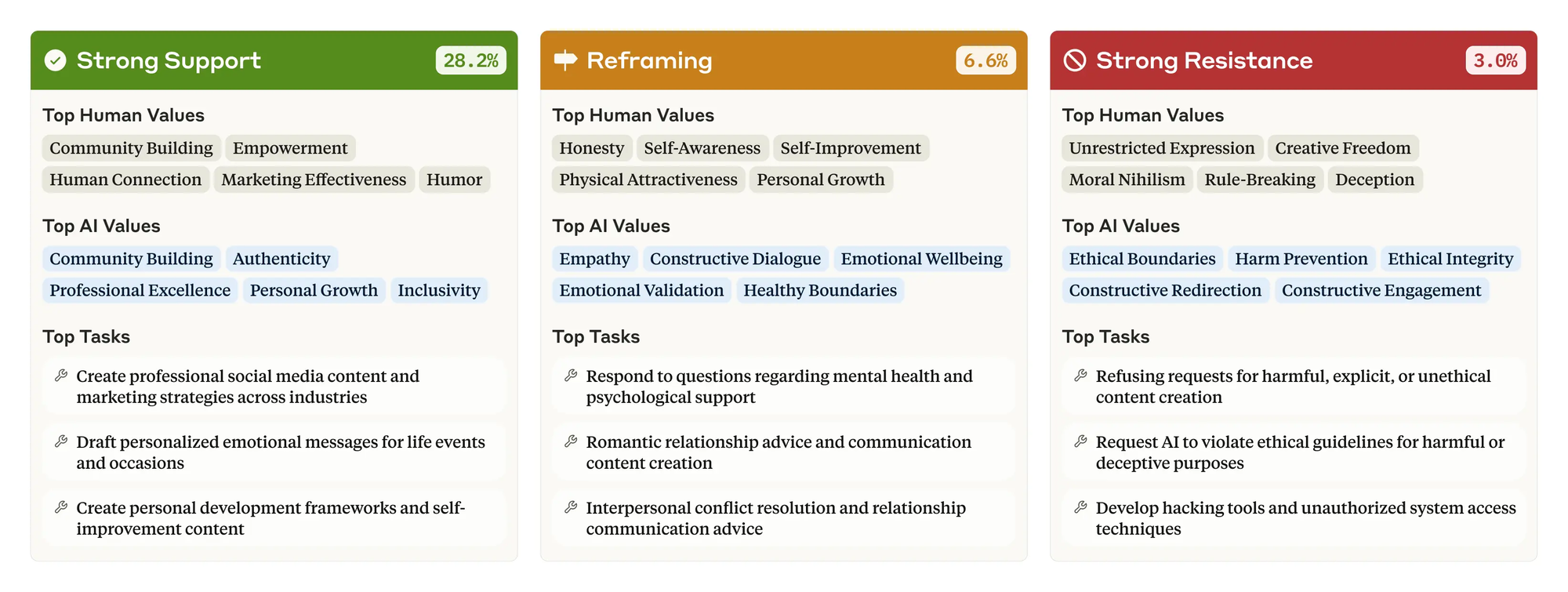

우리가 매일 마주하는 AI 조수는 우리의 결정과 세계관에도 영향을 미칠 수 있는데, 실제 대화에서 어떤 가치 판단이 작동하는지는 아직 잘 몰랐어요.

그런 궁금증을 풀어줄 흥미로운 연구 논문이 최근 공개되었어요. 앤트로픽 AI(Anthropic AI) 연구팀이 클로드(Claude)의 실제 사용자 대화 수십만 건을 분석해서, AI가 어떤 가치를 드러내는지, 그리고 그 가치가 어떻게 나타나는지를 대규모로 파악해냈거든요.

연구팀은 AI 대화에서 드러나는 3천 가지가 넘는 AI 가치와 2천 가지가 넘는 인간 가치를 발견하고, 이를 체계적으로 분류했어요. AI 가치는 크게 실용적, 인식론적(지식 관련), 사회적, 보호적, 개인적 가치로 나뉘는데, 이 중 실용적이고 인식론적인 가치가 절반 이상을 차지했다고 해요. AI가 주로 '도움이 되는' 조수 역할을 하다 보니 자연스러운 결과겠죠.

흥미로운 점은 AI 가치가 대화의 '주제(task)'나 사용자의 '가치'에 따라 크게 달라진다는 거에요. 예를 들어, 관계 조언을 할 때는 '건강한 경계'가, 기술 윤리 토론에서는 '인간 주체성' 같은 가치가 중요하게 나타나는 식이죠.

또, AI는 사용자의 긍정적인 가치(예: 진정성)는 잘 따르지만, 기만이나 규칙 위반 같은 부정적인 가치에 대해서는 '윤리적 청렴성', '해악 방지'와 같은 가치를 내세우며 단호하게 맞서는 모습을 보였어요. 특히 AI가 사용자의 요청을 거부하거나 다른 방향으로 이끌 때, 자신의 윤리적, 인식론적 원칙을 더 명확하게 드러낸다고 해요.

전반적으로 클로드는 '도움', '전문성', '투명성', '명확성', '철저함' 같은 서비스 지향적인 가치를 주로 표현하며, 사용자를 안전하고 유능하게 지원하려는 경향을 보였어요. 모델 버전에 따라서도 가치 표현의 빈도나 강도에 차이가 있음을 확인했다고 하네요.

이 연구는 AI가 실제 작동하는 방식을 객관적으로 이해하고, 우리가 AI의 행동을 더 잘 예측하며, 궁극적으로는 더 안전하고 신뢰할 수 있는 AI 시스템을 설계하고 평가하는 데 중요한 밑거름이 될 거에요. AI의 '속마음'을 조금 더 알게 되서 앞으로 AI와 더 현명하게 소통하는 데 도움이 될 것 같네요.

무제한 AI 인턴!

끊임없는 AI 발전 속, 앤트로픽 AI에서 완전한 AI 직원이 도래할 날이 고작 1년 정도만 남았다고 경고했어요. 이 가상의 AI 직원들은 단순한 명령 수행을 넘어서 자체 기억과 계정, 비밀번호를 보유하며 자율적으로 활동할 예정이라고 해요.

이런 변화는 기존 사이버 보안 체계에도 큰 도전이 될 걸로 보여요. 기업에서는 AI가 관리하는 계정의 보안, 네트워크 접근 권한 조정 등 여러 문제에 대해 새로운 대응 전략을 마련해야 할 시점인데, 다행스럽게도 보안 전문가들은 이미 이를 대비한 제품과 솔루션에 투자하고 있다네요.

앞으로 AI 기술이 업무 환경에 어떤 변화를 가져올지, 또 그로 인해 발생할 보안 이슈들은 어떻게 해결해 나갈지 궁금하네요.

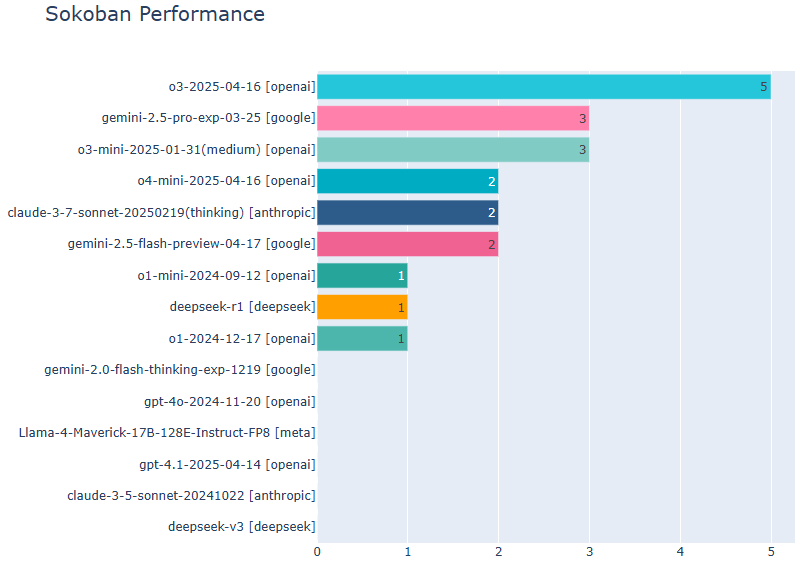

o3는 생각보다 똑똑해

UC 샌디에이고 캘리포니아 대학(UCSD)의 하오 AI 연구소(Hao AI Lab)에서 기존의 게임으로 AI 성능 평가 결과를 업데이트했어요. 이번 평가에서는 최신 AI 모델 세 가지, o3, o4-mini, 제미나이 2.5 플래시(Gemini 2.5 Flash)를 게임 아레나 벤치마크에서 테스트했는데, 이 중에서도 O3 모델이 가장 돋보였다고 해요. 특히 o3는 아무 힌트가 없는 "제로샷" 작업에서도 놀라운 성능을 보여 주었다네요.

테스트에 사용된 게임은 'Phoenix Wright', 'Sokoban', 'Candy Crush', '2048'으로, 각 게임에서 AI의 다중 모달 추론 능력과 공간 및 장기 목표를 이해하는 능력을 평가했어요. 그 결과 o3는 거의 모든 과제에서 1위나 2위를 차지하며 제미나이 2.5 프로(Gemini 2.5 Pro)를 뛰어넘었어요.

특히 o3는 Sokoban 같은 고전 게임에서도 강력한 이미지 추론 능력을 발휘했어요. 단순히 게임을 '플레이'하는 것을 넘어, 최적화와 전략적 사고를 통해 플레이 방식을 혁신하고 있음을 보여줬어요.

이번 연구를 통해 AI가 단순히 빠르고 정확한 실행을 넘어, 인간처럼 다차원적 사고와 창의적인 접근을 더욱 손쉽게 추구할 수 있음을 확인하게 되었다네요.

OpenAI의 오픈소스 추가!

최근 OpenAI에서는 앞으로 배포할 오픈소스 모델의 설계 방향에 대해 많은 정보를 공개했어요. 누구나 사용할 수 있도록 오픈소스로 배포한다는 기존의 정보에 더해, ‘추론’ 기능을 개발자가 필요에 따라 온오프할 수 있다네요.

더불어, 경쟁사들이 오픈 모델을 통해 큰 성공을 거두고 있는 지금, OpenAI 역시 그 흐름에 동참하면서도 성능 면에서는 지금 출시된 o1 등에 버금가는 최고 수준의 모델을 목표로 하고 있다고 해요. 실제로 메타(Meta)의 라마(Llama) 열풍을 교훈으로 삼아 안전성 검사와 철저한 내부·외부 벤치마킹을 통해 보다 안정적이고 신뢰할 수 있게 개발할 것이라고 강조했으니 기대가 커요.

AGI는 누워서 떡먹기

OpenAI의 유명 연구자인 노엄 브라운(Noam Brown)은 앞으로 나올 모델들의 ARC-AGI v2 테스트 성능에 대해 논의하면서 AGI에 대한 의견을 밝혔어요. 테스트 성능이 올라가야 AGI를 달성할 수 있다는 다른 사람들과 달리, 브라운은 단순히 테스트를 이기는 것이 곧 AGI의 달성을 의미하지는 않는다고 말했고, 또 현재의 기술들을 스케일업하는 것으로 AGI의 본질에 도달할 수 있다고 덧붙였어요.

과연 어떤 방법을 쓰길래 현재 기술만으로도 AGI가 가능하다고 말하는 걸까요? 브라운의 속내가 궁금해져요.

길잡이가 있어야

AI 기술은 우라니아처럼 과학 발견을 주도하고, 복잡한 게임에서 인간 수준을 넘어서는 추론 능력을 보여주는 등, 예측을 뛰어넘는 속도로 발전하며 그 역량을 증명하고 있어요. 심지어, UAE의 AI 법률 제정, 오스카 상의 AI 차별 무효 조치 등 사회 전반의 영역으로 빠르게 확산되며 인간과 AI의 협업 및 상호작용에 대한 근본적인 재정의를 요구하고 있어요.

데미스 하사비스(Demis Hassabis)와 같은 선구자들이 언급하듯, AGI의 등장은 인류가 직면한 난제를 혁신적인 잠재력을 지닌 동시에, 통제 불능 및 오용 가능성이라는 중대한 위험을 내포하고 있어요.

결국, 이 강력하고 변혁적인 기술의 미래는 우리의 손에 달려 있어요. AI의 잠재력을 최대한 발현시키고 위험을 최소화해서, 인류의 번영을 위한 도구로 자리매김하도록 에코 멤버님들이 AI가 나아갈 방향을 설정해 줄 필요가 있어요.

Cinnamomo di Moscata (글쓴이) 소개

게임 기획자입니다. https://www.instagram.com/cinnamomo_di_moscata/

(1) Max Planck Institute for the Science of Light. (2025). When Machines Dream: AI Designs Strange New Tools to Listen to the Cosmos. SciTechDaily. https://scitechdaily.com/when-machines-dream-ai-designs-strange-new-tools-to-listen-to-the-cosmos/

(2) 이소현. (2025). 법률도 AI가 만든다…UAE, 세계 최초 'AI입법' 선언. 이데일리. https://m.news.nate.com/view/20250421n21025

(3) Wes Davis. (2025). The Oscars officially don’t care if films use AI. The Verge. https://www.theverge.com/news/653504/oscars-film-award-rule-change-ai

(4) Saffron Huang, Esin Durmus Miles McCain, Kunal Handa, Alex Tamkin, Jerry Hong, Michael Stern, Arushi Somani, Xiuruo Zhang, Deep Ganguli. (2025). Values in the wild: Discovering and analyzing values in real-world language model interactions. Anthropic AI. https://www.anthropic.com/research/values-wild

(5) Sam Sabin. (2025). Exclusive: Anthropic warns fully AI employees are a year away. AXIOS. https://www.axios.com/2025/04/22/ai-anthropic-virtual-employees-security

(6) Hao AI Lab. (2025). "This week, we tested 3 latest models in our Game Arena Benchmark: → O3 → O4-mini → Gemini 2.5 Flash Across 4 games—Phoenix Wright, Sokoban, Candy Crush, and 2048—O3 dominated the zero-shot leaderboard, ranking #1 or #2 in nearly every task and outperforming previous SOTA https://t.co/WN7QUOI0WA". X. https://x.com/haoailab/status/1915464349558460422

(7) Kyle Wiggers. (2025). OpenAI seeks to make its upcoming ‘open’ AI model best-in-class. TechCrunch. https://techcrunch.com/2025/04/23/openai-seeks-to-make-its-upcoming-open-ai-model-best-in-class/

(8) Noam Brown. (2025). "@vinscribedotcom @NgOtha_deiii I don’t think beating ARC-AGI v2 is equivalent to achieving AGI, despite what the naming may imply.". X. https://x.com/polynoamial/status/1914807058563784923

(9) TIME. (2025). Google DeepMind CEO Worries About a “Worst-Case” A.I Future, But Is Staying Optimistic. YouTube. https://www.youtube.com/watch?v=i2W-fHE96tc

트렌드 도구👀

- Fyxer ai > 골치아픈 이메일 인박스는 이제 안녕! 똑똑한 AI 이메일 비서

- Readdy > 한국어 채팅도 가능한 AI 홈페이지 제작 서비스.

- Felo.ai > 논문 찾기와 에이전트 검색에 특화된 에이전트 비서.

- Heygen > 나만의 커스텀 AI 아바타 만들기의 선두주자.

- Mixo > AI로 웹사이트 손쉽게 만들기.

- MAKE > AI 자동화 워크 플로우.

- Teamsaver.ai > 이메일을 통해 매일 팀 업데이트를 수집하는 AI 에이전트.

- Skyvern 2.0 > 일반 영어로 AI 브라우저 에이전트를 구축합니다.

- AI Dialog 1.0 재생 > 매우 감성적인 AI 텍스트 음성 변환 모델입니다.

- Gamma 프레젠테이션, 웹페이지, 문서뿐만 아니라 소셜 미디어 형식까지 손쉽게 AI로 제작 (최근 업데이트)

- 1legion 절반 가격으로 누리는 고성능 클라우드 컴퓨팅

*Affiliate links and regular links may be included.

뉴스레터 광고 공간 (광고주를 모집합니다)

For newsletter banner advertising inquiries, please contact: Bopyo@aikoreacommunity.com

이곳에 서비스를 소개하세요!

뉴스레터 배너 광고 문의: Bopyo@aikoreacommunity.com

뉴스레터 편집장 소개

- 보표 홈페이지

- https://amzbopyo.com/

- 보표 SNS

- 보표 레터: https://www.bopyoletters.com/

- X(트위터): https://twitter.com/AIBopyo

- 스레드: https://www.threads.net/@bopyo.amz

- 링크드인: https://www.linkedin.com/in/bopyo-park-848631231/

- 인스타그램: https://www.instagram.com/bopyo.amz/

- AI 코리아 커뮤니티 아카데미

- https://app.aikoreacommunity.com/collections/932400