청구서가 날아왔다

'1비트'!

지난 10년간 인공지능(AI) 발전의 공식은 단순했어요. "더 크게, 더 많이." 매개변수(Parameter)와 막대한 GPU(그래픽 처리 장치)를 동원해 모델의 덩치를 키우는 방식은 AI의 놀라운 성능 향상을 가져왔지만, 동시에 최첨단 지능을 거대한 데이터센터(Data Center) 안에 가둬버리는 구조적 한계를 낳았어요.

스마트폰, 로봇, 보안이 중요한 기업 환경 등 우리 삶의 실제 현장에서 AI가 즉각적으로 작동하기에는 그 유지 비용과 크기가 너무 컸던 거예요. 그러나 최근 AI 연구소 프리즘ML(PrismML)이 발표한 '1비트 본사이(1-bit Bonsai)' 모델은 이러한 패러다임의 대전환을 예고하고 있어요.

혁신의 핵심은 모델의 크기와 전력 대비 성능을 극대화하는 '지능 밀도(Intelligence Density)'에 있어요. 프리즘ML이 공개한 본사이 8B 모델은 임베딩(Embedding), 어텐션 레이어(Attention Layer) 등 네트워크 전체가 1비트로 설계된 진정한 의미의 1비트 모델이에요.

기존 16비트 기반의 8B 클래스 모델들과 경쟁할 만한 뛰어난 성능을 유지하면서도, 용량은 14분의 1 수준인 1.15GB에 불과해요. 지능 밀도 지표에서 경쟁 모델 대비 10배 이상의 압도적인 효율을 달성하며, '성능을 높이려면 크기가 커져야 한다'는 오랜 상충 관계를 깨는 새로운 지평, 이른바 파레토 프론티어(Pareto Frontier)를 연 거예요.

지능이 고도로 농축되면서 일어나는 변화는 그야말로 혁명적이에요. 1.15GB의 초경량 사이즈 덕분에 본사이 8B는 아이폰(iPhone) 17 프로와 같은 모바일 기기에 무리 없이 탑재돼요. 실제로 최신 아이폰 17 프로 맥스에서 초당 44토큰(Token), M4 프로 맥(Mac)에서는 초당 131토큰을 생성하는 놀라운 처리 속도를 보여줘요.

클라우드(Cloud)에 의존하지 않고 기기 내에서 직접 구동되는 온디바이스(On-device) 방식이라 지연 시간이 극히 짧고, 민감한 데이터가 외부 서버로 유출될 위험도 없어요. 전력 효율성 또한 기존 대비 4~5배 뛰어나고, 향후 1비트 연산에 특화된 하드웨어(Hardware)가 보급되어 무거운 곱셈 연산을 단순 덧셈으로 대체하게 된다면 그 효율은 또 한 번 비약적으로 도약할 거예요.

과거 방 하나를 꽉 채우던 거대한 에니악(ENIAC) 컴퓨터가 오늘날 주머니 속 스마트폰으로 진화하여 세상을 바꿨듯, AI 역시 혁신적인 경량화를 통해 진정한 대중화의 궤도에 올랐어요.

당황하면 뇌를 움츠려

우리는 매일같이 챗GPT(ChatGPT)와 같은 거대 언어 모델(LLM, Large Language Model)에 질문을 던져요. 일상적인 대화에는 청산유수처럼 답하지만, 고도의 논리적 추론이 필요한 수학 문제나 학습하지 않은 낯선 상황, 이른바 분포 외 데이터(OOD, Out-of-Distribution)가 주어지면 AI 역시 성능이 저하되며 '당황'하는 모습을 보여요. 그렇다면 이렇게 어려운 문제에 직면했을 때, AI의 내부 네트워크에서는 과연 어떤 일이 벌어질까요? 최근 발표된 한 연구가 이 거대한 '블랙박스(Black Box)'의 비밀을 한 꺼풀 벗겨냈어요.

연구의 핵심 결론은 명확해요. "문제가 어려울수록, 낯선 데이터일수록 AI 내부의 활성화 상태가 더욱 '희소(Sparse)'해진다"는 거예요. 연구진은 수학 문제의 난이도를 높이거나, 객관식 오답 선택지를 늘리고, 심지어 모순되는 지식을 주입하는 등 다양한 방식으로 모델을 시험했어요.

그 결과, 난이도가 상승할수록 LLM의 마지막 은닉층(Last Hidden State)에서 활성화되는 신경망의 차원이 급격히 좁아졌어요. 소수의 노드(Node)에만 에너지가 집중되고 나머지는 꺼지는 '희소성'이 증가한 거예요. 인간으로 치면, 익숙한 일은 여유롭게 처리하지만 낯선 위기 상황에서는 시야가 좁아지고 특정 감각에만 극도로 집중하게 되는 것과 흡사해요.

그렇다면 왜 이런 현상이 일어나는 걸까요? 연구에 따르면 이는 단순한 오류가 아니라 AI가 사전 학습 과정에서 터득한 일종의 '적응 메커니즘(Adaptation Mechanism)'이에요. AI는 훈련을 통해 완벽히 마스터한 익숙한 인 디스트리뷰션(In-Distribution) 데이터에 대해서는 정보를 넓게 분산시켜 안정적이고 밀도 있는, 이른바 덴스(Dense)한 표현을 형성해요. 반면, 낯설거나 난이도가 높은 데이터를 만나면 이러한 밀도를 유지하지 못하고, 불확실성을 통제하기 위해 소수의 핵심 특징에만 연산을 집중시켜요.

즉, 내부 네트워크의 '풍부한 활성화'는 AI가 해당 지식을 완전히 숙달했다는 증거이며, 반대로 '희소성'의 증가는 AI가 현재 한계치에서 분투하고 있다는 강력한 신호인 거예요.

더욱 흥미로운 점은 이 발견이 단순한 분석에 그치지 않고 AI의 성능을 높이는 열쇠가 된다는 거예요. 연구진은 이 희소성 지표를 '난이도 판별기'로 활용해 새로운 프롬프트 학습법인 SG-ICL(Sparsity-Guided In-Context Learning)을 제안했어요.

모델이 보여주는 희소성을 기준으로 문제들의 난이도를 측정하고, AI에게 예시를 보여줄 때 '쉬운 문제에서 어려운 문제 순'으로 맞춤형 커리큘럼(Curriculum)을 짜준 거예요. 결과는 성공적이었고, 기존 방식보다 AI의 추론 정확도가 눈에 띄게 향상됐어요.

AI가 어려움을 느낄 때 보내는 이 '뇌파' 같은 신호를 잘 활용한다면, AI의 고질적 문제인 환각(Hallucination) 현상을 스스로 진단하거나, 어떤 상황에서도 흔들리지 않는 더 견고한 AI를 만드는 데 중요한 나침반이 될 거예요.

나도 게이머 대신 AI

인텔(Intel)의 차세대 대형 GPU 아키텍처(Architecture) '배틀메이지(Battlemage)'가 또다른 소식을 전했어요. 하지만 아쉽게도 게이머들을 위한 제품은 아니에요. 인텔은 32GB의 막강한 VRAM(Video RAM)을 탑재한 워크스테이션(Workstation) 및 로컬 AI 추론용 GPU '아크 프로(Arc Pro) B70'과 'B65'를 발표했어요. 대형언어모델(LLM) 구동에 있어 방대한 모델과 컨텍스트(Context)를 메모리에 한 번에 담아내는 것이 핵심인 만큼, 256비트 버스(Bus)와 608GB/s의 대역폭을 갖춘 32GB VRAM은 로컬 환경에서 AI를 구동하려는 이들에게 매우 매력적인 무기예요.

이번 신제품에서 가장 눈에 띄는 것은 단연 '가성비'예요. 32개의 Xe 코어(Core)와 22.9 TFLOPS의 연산 능력을 갖춘 주력 모델 아크 프로 B70의 가격은 949달러로 책정됐어요. 이는 1,800달러에 달하는 경쟁사 엔비디아(NVIDIA)의 'RTX 프로 4000 24GB'나 1,299달러인 AMD의 '라데온 AI 프로(Radeon AI Pro) R9700'보다 훨씬 저렴한 수준이에요.

토큰당 처리 비용(Cost-per-token) 측면에서 확실한 우위를 점하며, 상대적으로 저렴한 비용에 32GB VRAM을 확보하려는 예산에 민감한 AI 개발자들과 기업들의 틈새시장을 정확히 조준했어요. 20개 코어를 갖추어 연산력보다 넉넉한 메모리 용량이 필요한 크리에이터(Creator)를 겨냥한 B65 모델 역시 4월 중순 출시를 앞두고 있어요.

그러나 하드웨어의 스펙과 저렴한 가격만으로 AI 생태계를 장악할 수는 없어요. 엔비디아가 오랫동안 다져온 철옹성 같은 '쿠다(CUDA)' 생태계는 인텔이 넘어야 할 가장 큰 산이에요. 엔비디아의 최신 칩(Chip)들이 NVFP4 등 새로운 하위 정밀도 데이터 타입(Data Type)을 지원해 효율을 극대화하는 반면, 배틀메이지의 가속 지원은 FP16과 INT8에 머물러 있어요.

또한 8-GPU 단위로 유연하게 서버를 확장할 수 있는 엔비디아와 달리, 인텔은 아직 다중 GPU 확장성 면에서 증명해야 할 과제가 많아요. 초기 도입 비용은 저렴하지만, 소프트웨어(Software) 호환성과 최적화를 위한 추가적인 시간과 총소유비용(TCO, Total Cost of Ownership)을 고려하면 숙련된 기업들은 여전히 엔비디아를 선호할 가능성이 높아요.

인텔이 대형 배틀메이지 칩을 게이밍(Gaming) 시장이 아닌 전문가용 AI 시장에 우선 투입한 것은 현재 반도체 시장 상황을 반영한 냉철한 전략적 판단이에요. 칩 공급망이 불안정한 상황에서 립부 탄(Lip-Bu Tan) CEO 체제의 인텔은 이윤이 적고 경쟁이 치열한 메인스트림(Mainstream) 게이밍 시장보다, 마진(Margin)이 높은 AI 및 프로페셔널(Professional) 시장에 집중하는 '선택과 집중'을 택했어요.

비록 당장 엔비디아의 거대한 아성을 무너뜨리긴 어렵겠지만, 온프레미스(On-premise) AI 서버를 실험적으로 구축하려는 스타트업(Start-up)이나 연구소에게 '가성비 32GB 로컬 AI GPU'라는 훌륭한 선택지를 제공했다는 점만으로도 인텔의 이번 행보는 충분히 위협적이고 의미 있어요.

AI 윤리 vs. 국가 안보!

최근 미국 샌프란시스코(San Francisco) 연방지방법원은 AI 기업 앤트로픽(Anthropic)과 트럼프(Trump) 행정부 간의 법적 공방에서 앤트로픽의 손을 들어줬어요. 리타 F. 린(Rita F. Lin) 판사는 미국 정부가 앤트로픽의 AI 기술 사용을 전면 금지하려던 조치에 제동을 걸며 예비적 금지 명령(Preliminary Injunction)을 내렸어요. 단순한 정부 계약 취소 논란을 넘어, 이 사건은 인공지능 시대를 맞이한 국가 권력과 기술 기업 간의 묵직한 가치관 충돌을 여실히 보여줘요.

갈등의 핵심은 'AI의 윤리적 사용과 통제권'에 있어요. 챗봇(Chatbot) '클로드(Claude)' 개발사인 앤트로픽은 자사의 AI가 대규모 대중 감시나 자율 살상 무기 배치에 사용되지 않아야 한다는 안전장치를 요구했어요. 반면, 미 국방부(Pentagon)는 국가 안보를 내세우며 어떠한 제약도 수용할 수 없다는 강경한 입장을 보였어요. 급기야 정부는 앤트로픽이 국방 공급망에 위협이 된다며 퇴출을 선언했고, 앤트로픽은 수십억 달러의 수익 손실과 부당한 탄압을 주장하며 소송으로 맞섰어요.

법원의 판단은 명확했어요. 린 판사는 정부의 금지 조치가 진정한 안보 목적이라기보다는 앤트로픽을 징벌하기 위한 의도가 짙다며, 이를 "전형적이고 불법적인 수정헌법 제1조(First Amendment), 즉 표현의 자유에 대한 보복"이라고 규정했어요.

정부 측은 앤트로픽이 펜타곤의 인공지능 정책을 좌우하려 해 신뢰를 무너뜨렸고, 향후 시스템에 사보타주(Sabotage, 파괴 공작)를 가할 위험이 있다고 주장했어요. 그러나 법원은 앤트로픽이 군에 도입된 AI 모델을 임의로 중단하거나 작동 방식을 조작할 기술적 수단이 없다는 점을 명확히 지적하며, 사보타주 주장에 합당한 근거가 없다고 일축했어요.

이번 예비적 금지 명령은 단순히 한 기술 스타트업의 승리를 넘어서는 의미를 가져요. 국가가 자신의 정책 방향과 다른 윤리적 견해를 가진 계약 업체를 어떻게 대해야 하는가에 대한 중대한 선례가 될 것이기 때문이에요. 인공지능 기술이 국방과 안보의 핵심 전력이 될수록, 첨단 기술을 개발한 기업의 윤리적 철학과 맹목적인 국가 안보 논리는 필연적으로 충돌할 수밖에 없어요.

클로드의 발목을 잡은 아날로그적 실수

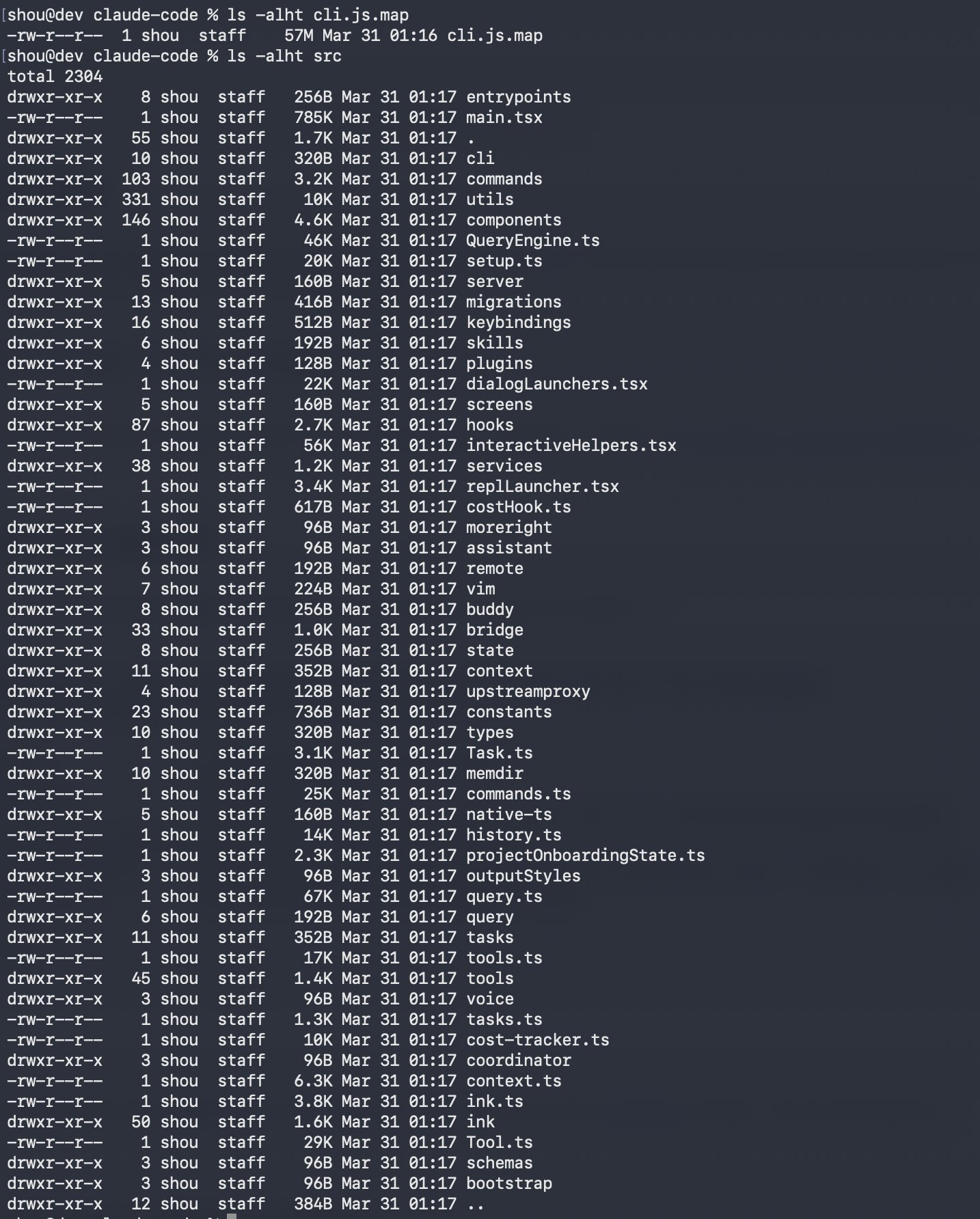

2026년 3월 말, 전 세계 AI 업계는 선두 주자 중 하나인 앤트로픽(Anthropic)이 연달아 겪은 두 건의 황당한 유출 사고로 술렁였어요. 하나는 차세대 초고성능 AI 모델의 존재가 웹 관리 시스템의 허술함 때문에 세상에 드러난 것이고, 다른 하나는 개발자 도구인 '클로드 코드(Claude Code)'의 소스코드(Source Code)가 npm 레지스트리(Registry)의 매핑 파일 관리 실수로 통째로 유출된 사건이에요.

포춘(Fortune) 보도를 통해 드러난 앤트로픽의 새 모델 '클로드 미토스(Claude Mythos)'와 새로운 최상위 등급 '카피바라(Capybara)'는 기존 최고 모델인 오푸스(Opus) 4.6을 아득히 뛰어넘는 성능을 자랑해요. 앤트로픽 스스로가 "지금껏 구축한 것 중 가장 뛰어나며, 도약(Step Change)을 이룬 모델"이라고 평가할 정도예요.

특히 코딩(Coding)과 사이버 보안(Cyber Security) 분야에서 압도적인 능력을 보여, 회사는 이 모델이 해커에게 악용될 경우 방어자의 역량을 초과하는 전례 없는 사이버 위협이 될 수 있다며 극도의 경계심을 표했어요.

그러나 여기서 뼈아픈 역설이 발생해요. 세계 최고 수준의 사이버 보안 능력을 갖춘 AI를 개발하고, 중국 국가 지원 해커들의 실제 공격 시도까지 선제적으로 탐지해 낸 기업이 정작 가장 기초적인 보안 사고에 무너진 거예요. 미토스의 존재와 유럽 CEO 비공개 서밋(Summit) 정보가 유출된 것은 콘텐츠 관리 시스템(CMS, Content Management System)의 '기본 공개' 설정을 바꾸지 않은 단순한 '인적 오류(Human Error)' 때문이었어요. 불과 며칠 뒤인 3월 31일 발생한 소스코드 유출 역시 개발 과정에서 흔히 발생하는 패키지(Package) 배포 과정의 부주의에서 비롯됐어요.

이 일련의 사태는 AI 산업 전체에 중대한 교훈을 던져요. 우리가 아무리 지능적이고 복잡한 인공지능을 만들어낸다 한들, 이를 다루고 배포하는 시스템의 말단에는 결국 '불완전한 인간'이 존재한다는 사실이에요. AI 모델이 지닌 잠재적 위험, 이른바 AI 안전성(AI Safety) 문제를 통제하고 고도화된 해킹 시나리오를 방어하는 데 천문학적인 자본을 쏟아부어도, 직원의 클릭 한 번이나 잘못된 파일 업로드 하나가 회사의 핵심 기밀을 무방비로 노출할 수 있어요.

최첨단 기술의 성패는 아이러니하게도 가장 기초적인 '보안의 기본기'에 달려 있어요. 앤트로픽의 이번 유출 사태는 AI 기술의 비약적인 발전 속도에 맞춰 조직 내부의 평범하고 일상적인 작전 보안(OpSec, Operational Security) 수준 역시 동반 상승해야 함을 증명하는 훌륭한 반면교사예요.

AI 혁신의 가혹한 청구서

글로벌 소프트웨어(Software) 공룡 오라클(Oracle)이 대규모 인력 구조조정에 돌입했다는 소식은 2026년 현재 IT 업계가 직면한 냉혹한 딜레마(Dilemma)를 적나라하게 보여줘요. 16만 명 이상의 직원을 거느렸던 오라클은 최근 수만 명 규모의 감원을 준비 중이에요.

한때 안정적인 데이터베이스(Database) 시장의 절대강자였던 회사의 주가는 올해에만 25% 폭락하며 빅테크(Big Tech) 기업 중 가장 뼈아픈 하락세를 겪고 있어요. 이 극단적인 조치의 이면에는 '인공지능(AI) 인프라(Infrastructure) 구축'이라는 천문학적인 비용 청구서가 자리 잡고 있어요.

생성형 AI(Generative AI)의 폭발적 성장과 함께 클라우드(Cloud) 및 데이터센터(Data Center) 인프라의 중요성은 그 어느 때보다 커졌어요. 아마존(Amazon)과 같은 거대 클라우드 경쟁사들과의 격차를 좁히기 위해, 오라클은 자본 지출을 급격히 늘리며 사활을 건 투자를 단행해 왔어요.

지난 1월 500억 달러 규모의 자금 조달 계획을 발표할 정도로 공격적인 행보를 보였지만, 이는 고스란히 막대한 부채 증가와 현금 흐름 악화라는 부메랑으로 돌아왔어요. 결국 투자자들의 압박 속에서 회사는 2만~3만 명의 직원을 내보내 80억~100억 달러의 잉여 현금 흐름(Free Cash Flow)을 확보하는 '극약 처방'을 선택한 거예요.

하지만 작금의 상황을 단순한 기업의 몰락으로 보기는 어려워요. 사프라 카츠(Safra Catz)의 뒤를 이은 마이크 시실리아(Mike Sicilia)와 클레이 마구아크(Clay Maguire) 공동 CEO 체제는 철저히 미래를 향한 체질 개선에 집중하고 있어요.

오픈AI(OpenAI)와의 3,000억 달러 규모 계약 등에 힘입어 오라클의 남은 이행 의무(RPO, Remaining Performance Obligations)는 5,530억 달러라는 경이로운 수준까지 치솟았어요. "AI 인프라 수요가 공급을 초과하고 있다"는 경영진의 확신처럼, 오라클은 당장의 출혈을 감수하더라도 미래 AI 생태계의 주도권을 쥐겠다는 강력한 배수진을 친 셈이에요.

오라클의 이번 위기는 비단 한 기업만의 문제가 아니에요. 막대한 자본이 블랙홀처럼 빨려 들어가는 AI 전쟁 속에서, 기존의 안정적인 사업을 유지하며 새로운 혁신의 토대를 닦아야 하는 전통 테크(Tech) 기업들의 고뇌를 대변해요.

토큰 인 차이나!

과거 '세계의 공장'으로 불리며 값싼 공산품을 수출하던 중국이 이제는 전혀 다른 형태의 수출품으로 전 세계 시장을 공략하고 있어요. 바로 인공지능(AI) 시대의 두뇌 활동 단위라 할 수 있는 '토큰(Token)'이에요. 최근 중국 정부는 토큰을 새로운 경제 성장 지표이자 주력 수출 분야로 공식화하며, 본격적인 '토큰 경제(Token Economy)'의 서막을 알렸어요.

성장세는 그야말로 폭발적이에요. 중국 국가데이터관리국에 따르면 지난 3월 기준 중국의 일일 토치예요. 이러한 기하급수적 성장의 배경에는 단순 챗봇을 넘어 복잡한 코딩과 의사결정을 자율적으로 수행하는 AI 에이전트(AI Agent)의 확산이 자리 잡고 있어요. 더욱 주목해야 할 것은 글로벌 시장에서 입증되고 있는 중국 AI의 경쟁력이에요.

딥시크(DeepSeek), 미니맥스(MiniMax) 등 중국의 주요 오픈소스(Open-source) 모델들은 압도적인 가성비를 무기로 글로벌 플랫폼(Platform)에서 미국 모델들을 제치고 주간 사용량 1위를 차지하는 기염을 토했어요. 성능은 미국의 최상위 모델에 뒤지지 않으면서도 가격은 훨씬 저렴해, 전 세계 개발자들을 거침없이 빨아들이고 있는 거예요.

중국이 내세우는 '토큰 수출'의 본질은 결국 '에너지의 고부가가치화'에 있어요. 중국 서부 지역의 풍부하고 저렴한 재생에너지를 막대한 컴퓨팅(Computing) 파워를 통해 AI 토큰으로 치환하여 판매하겠다는 고도의 경제 논리예요.

전기를 그대로 수출할 때보다 이를 AI 토큰으로 변환해 팔면 그 가치가 무려 22배나 뛴다고 해요. 이는 단순히 전기료가 싸서 가능한 마법이 아니에요. 초고압 송전 설비부터 액체 냉각(Liquid Cooling) 데이터센터, 서버 조립에 이르기까지 중국 특유의 수직 통합된 거대한 인프라 공급망이 뒷받침되었기에 가능한 결과예요.

나아가 중국 정부는 토큰의 공식 명칭으로 '츠위안(楊元, Cìyuán)'을 제안하며, 새로운 디지털 경제의 표준 단위로 브랜드화하려는 야심마저 드러내고 있어요. 경쟁력 있는 가격의 중국산 토큰은 자금력이 부족한 전 세계 중소기업과 신흥국 사용자들의 진입 장벽을 낮추며 중국발 AI 생태계의 지배력을 강화할 거예요.

컨트롤 스킬

이번 칼럼에서 함께 살펴본 이야기들은 표면적으로는 각기 다른 주제처럼 보이지만, 사실 하나의 거대한 흐름을 가리키고 있어요. 1비트짜리 초경량 모델이 클라우드의 족쇄를 끊고, AI가 자신의 '당황'을 스스로 진단하며, 하드웨어 전쟁의 전선이 게이머의 책상에서 기업의 서버실로 옮겨가는 것. 그리고 그 모든 가속의 끝에서 법정이, 유출 사고가, 수만 명의 해고가 기다리고 있어요.

기술이 강력해질수록, 그것을 멈추거나 방향을 틀 수 있는 권리가 누구에게 있는지가 더욱 절박한 질문이 돼요. 앤트로픽의 소송전과 오라클의 구조조정, 중국의 토큰 수출 야심은 모두 같은 진실을 가리키고 있어요. AI 혁신의 청구서는 반드시 누군가가 치른다는 것, 그리고 그 '누군가'가 우리 자신이 되지 않으려면 기술의 방향을 읽는 눈이 필요하다는 것이에요. 속도보다 방향이, 성능보다 책임이 더 중요해진 시대에, 가장 값진 경쟁력은 결국 에코 멤버님들의 인간다운 판단력이에요.

Cinnamomo di Moscata (글쓴이) 소개

게임 기획자입니다. https://www.instagram.com/cinnamomo_di_moscata/

(1) PrismML. (2026). Announcing 1-bit Bonsai: The First Commercially Viable 1-bit LLMs. https://prismml.com/news/bonsai-8b

(2) arXiv:2603.03415 [cs.CL]

(3) Jeffrey Kampman, Andrew E. Freedman. (2026). Intel Arc Pro B70 and Arc Pro B65 GPUs bring 32GB of RAM to AI and pro apps — bigger Battlemage finally arrives, but it's not for gamers. tom's hardware. https://www.tomshardware.com/pc-components/gpus/intel-arc-pro-b70-and-arc-pro-b65-gpus-bring-32gb-of-ram-to-ai-and-pro-apps-bigger-battlemage-finally-arrives-but-its-not-for-gaming

(4) Rachel Metz. (2026). Anthropic Wins Court Order Pausing Trump Ban on AI Tool. Bloomberg. https://www.bloomberg.com/news/articles/2026-03-26/anthropic-wins-court-order-blocking-trump-ban-on-use-of-ai-tool

(5) Beatrice Nolan. (2026). Exclusive: Anthropic acknowledges testing new AI model representing ‘step change’ in capabilities, after accidental data leak reveals its existence. Fortune. https://fortune.com/2026/03/26/anthropic-says-testing-mythos-powerful-new-ai-model-after-data-leak-reveals-its-existence-step-change-in-capabilities/

(6) Chaofan Shou. (2026). "Claude code source code has been leaked via a map file in their npm registry! Code: https://t.co/jBiMoOzt8G https://t.co/rYo5hbvEj8". X. https://x.com/Fried_rice/status/2038894956459290963

(7) Jordan Novet, Seema Mody. (2026). AI AgeOracle cutting thousands in latest layoff round as company continues to ramp AI spending. CNBC. https://www.cnbc.com/2026/03/31/oracle-layoffs-ai-spending.html

(8) 임대준. (2026). 중국, '토큰 경제' 강조..."풍부한 전력을 토큰으로 변환해 전 세계에 수출". AI타임스. https://www.aitimes.com/news/articleView.html?idxno=208626