AI 시대의 다가올 삶은?

AI도 홀로서기가 필요해

최근 AI 연구자 안드레이 카파시(Andrej Karpathy)는 인간 피드백을 통한 강화 학습(RLHF)이 언어 모델의 인간과 같은 문제 해결 능력을 훈련하는 데 충분하지 않다고 주장했어요. RLHF는 ChatGPT와 같은 모델을 이해하고 자연스럽게 만드는 데 중요한 역할을 했지만, 카파시는 이를 병목 현상(Bottleneck)으로 보고 있다고 해요.

카파시는 구글 딥마인드(Google DeepMind)의 알파고(AlphaGo)와 비교하며, 알파고는 스스로 바둑을 두며 최적의 성능을 달성했다고 설명했어요. 반면, 대조적으로 RLHF는 인간 평가자가 상태를 비교해 선호도를 선택하는 방식으로, 이는 실제 문제 해결보다는 인간의 '좋은 느낌’을 모방하는 데 그친다고 해요.

카파시는 언어 모델의 진정한 문제 해결 능력을 위해서는 알파고나 알파프루프(AlphaProof)처럼 스스로 문제를 해결하도록 만드는 창의적인 접근이 필요하다고 강조해요. 이를 뒷받침하듯 구글 딥마인드도 최근 논문에서 AGI의 기초로서 개방성을 주장했어요.

일론의 수제자 출격!

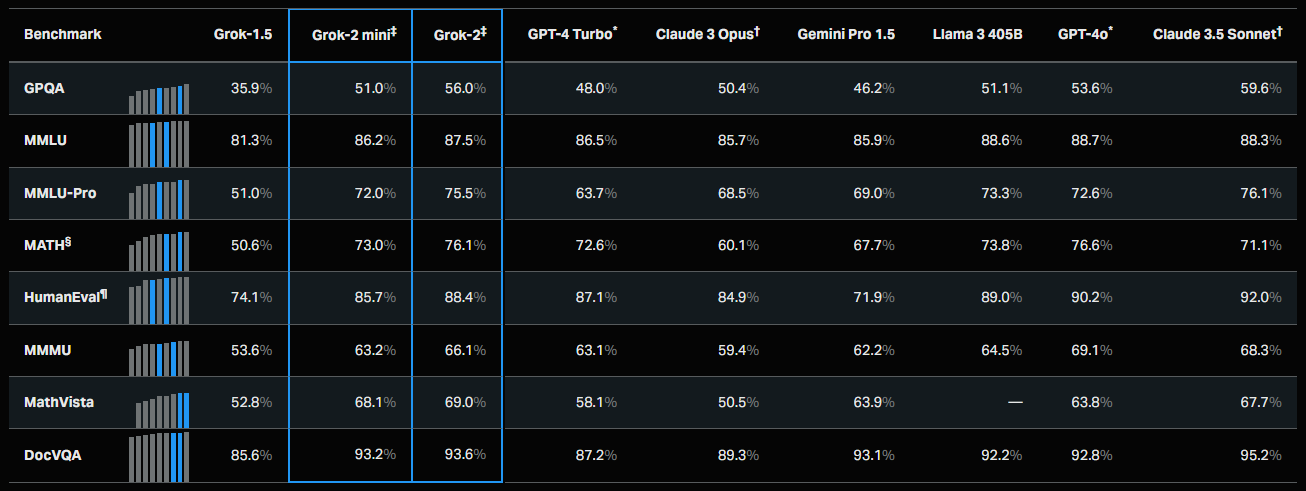

최근 일론 머스크(Elon Musk)는 자신의 트위터를 통해 xAI의 새로운 진전을 알렸어요. 그는 "Grok 2는 인공지능의 새로운 시대를 열 것"이라고 언급하며, 이 기술이 가져올 혁신에 대한 기대감을 드러냈어요.

Grok 2는 xAI에서 개발한 최신 AI 모델로, GPT-4o를 비롯한 기존의 AI 기술을 소폭 뛰어넘는 성능을 자랑한다고 해요. 이 모델은 자연어 처리 능력이 크게 향상되어, 인간과의 대화에서 더욱 자연스럽고 정확한 응답을 제공행. 또한, 테슬라(Tesla)와 스페이스X(SpaceX)의 CEO인 일론 머스크 답게 다양한 분야에서 활용될 수 있는 유연성을 갖추고 있어, 의료, 금융, 교육 등 여러 산업에서 큰 변화를 일으킬 것으로 기대된다고 해요.

특히, Grok 2는 데이터 처리 속도와 효율성 면에서 탁월한 성능을 보여준다고 해요. 이는 대규모 데이터 분석과 실시간 응답이 필요한 분야에서 매우 중요한 요소에요. 엘론 머스크는 이 기술이 "인류의 삶을 더욱 풍요롭게 만들 것"이라고 강조하며, 앞으로의 발전 가능성에 대한 기대를 높였습니다.

결론적으로, Grok 2는 그동안 후발주자였던 xAI의 새로운 도약을 의미하며, 다양한 산업에서 혁신을 이끌어낼 잠재력을 가지고 있어요. 머스크와 xAI가 빚어낸 이 기술이 앞으로 어떤 변화를 가져올지 주목해 볼 필요가 있어보여요.

그록 2(Grok-2)와 다른 AI의 성능 비교(수치가 클수록 좋음)

진정한 AI 시대가 빠르면 내년에?!

구글의 전 CEO인 에릭 슈미트는 다시 구글로 복귀했어요. 그리고 스탠포드 대학(Stanford Universit)에서 연 최근의 비공개 강연에서 AI와 기술적 특이점에 대해 심도 있는 논의를 펼쳤어요. 그는 AI의 발전이 가져올 변화를 세 가지 주요 측면에서 설명했다고 해요.

1. 긴 컨텍스트 창의 도입

AI 모델의 컨텍스트 창이 길어지면서, AI는 더 많은 정보를 "기억"으로 활용할 수 있게 된다고 해요. 이는 AI가 방대한 양의 데이터를 처리하고, 더 정확한 답변을 제공할 수 있게 한다는 점에서 중요한 발전이에요.

2. 에이전트의 등장

에이전트는 특정 분야에 특화된 AI로, 예를 들어 화학 분야의 에이전트는 수많은 화학 서적을 학습하고 새로운 지식을 발견해 기존 모델에 추가할 수 있어요. 이는 AI의 전문성을 높이고, 다양한 분야에서 인간 대신 굳은 일을 도맡아하며 혁신을 이끌어낼 거에요.

3. 텍스트 투 액션

AI가 텍스트 명령을 받아 실제 행동으로 옮기는 능력은 매우 강력해요. 예를 들어, 사용자가 AI에게 특정 앱을 복제하고 개선하라고 명령하면, AI는 이를 수행할 수 있어요. 이는 개인 맞춤형 프로그래머를 갖게 되는 것과 같아, 혁신적인 아이디어의 실현을 가속화할 거에요.

에릭 슈미트는 이러한 변화들이 앞으로 1-2년 안인 2025-2026년에 현실화될 것이라고 전망하며, AI가 사회에 미칠 영향에 대해 깊이 고민해야 한다고 강조했어요.

한편으로 그는, 너무나 많은 돈이 AI에 투자되고 있어서 가난한 나라는 계속 가난할 것이라고 우려하는 모습이나, NVIDIA(엔비디아)의 반도체와 소프트웨어가 너무 뛰어나서 한동안은 엔비디아만 계속 성장할 것, 그리고 AI를 딥페이크에 악용하는 사람들이 너무 많아서 인증 기술이 발전해야 할 것이라 예견하는 등 AI가 불러올 어두운 면도 확실하게 언급해주었다고 해요.

Stanford ECON295/CS323 I 2024 I The Age of AI, Eric Schmidt [REUPLOAD]

— Anatolii (@quasa0) August 15, 2024

The source video appears to be taken down less than a day since being posted pic.twitter.com/tWV9AvM9AD

에릭 슈미트의 스탠포드 대학 강연 영상

AI 도입과 생산성의 역설

2023년은 "효율성의 해"로 불리며, 경제적 역풍에 대비해 기업들은 비용 절감과 생산성 향상을 목표로 했어요. 이에 따라 많은 기업들이 인공지능(AI)을 도입하여 적은 자원으로 더 많은 성과를 내고자 시도했어요. 그러나 AI 도입이 반드시 생산성 향상으로 이어지지는 않았다고 해요

업워크(Upwork)의 연구에 따르면, 96%의 C-레벨 리더들이 AI 도입이 회사의 생산성을 높일 것이라고 기대하고 있어요. 그러나 실제로는 많은 직원들이 AI 도입으로 인해 업무 부담이 증가하고 있다고 느끼고 있어요. 77%의 직원들이 AI 도구 사용이 오히려 생산성을 감소시키고 있다고 보고했거든요.

특히, AI 도입과 함께 증가한 업무 강도로 인해 직원들의 번아웃이 심각해지고 있어요. 71%의 직원들이 번아웃을 경험하고 있으며, 이로 인해 3명 중 1명은 향후 6개월 내에 직장을 그만둘 가능성이 있다고 응답했어요.

AI의 잠재력을 최대한 활용하기 위해서는 기존의 업무 구조와 평가 방식을 근본적으로 재고할 필요가 있어보여요. 직원들이 AI 도구를 효과적으로 활용할 수 있도록 교육과 지원이 필요하며, 성과 평가도 양적 성과뿐만 아니라 창의성과 혁신을 포함하도록 변화해야 한다고 해요.

AI의 한계와 미래

최근 AI의 발전은 눈부시지만, 그 한계와 미래에 대한 논의도 예전부터 계속 이어져왔어요. OpenAI에서 AI 안전을 연구 중인 스콧 애런슨(Scott Aaronson) 교수는 AI의 한계에 대해 두 가지 관점을 제시했어요. 첫째, 데이터의 한계로 인해 AI가 벽에 부딪힐 수 있다는 점이에요. 둘째, 컴퓨팅 자원의 병목현상이에요. 특히, GPU 생산량과 에너지 소비가 큰 문제로 작용할 수 있다고 해요. 물론 기술 발전으로 극복해 나가고 있지만, 아직까지는 쉽지 않다고 해요.

애런슨 교수는 AI의 발전이 경험적이라는 점을 강조해요. 지금까지의 진전은 모두 시도해본 결과로 얻어진 것이며, 이론적으로 예측된 바가 없다고 해요. 그는 AI와 인간의 차이를 물리적 구성 요소에서 찾아요. 인간은 탄소 기반이고, AI는 실리콘 기반이라는 점에서 근본적인 차이가 있다고 해요. 따라서, 인간은 유한하지만 AI는 무한하기 때문에 서로의 행동이 차이날 수가 있다네요.

또한, AI의 안전성 문제도 중요한 화두에요. 그는 OpenAI에서 AI 안전성을 연구하며, AI가 인간에게 우호적이지 않을 가능성에 대해 경고해요. 그는 AI가 인간의 범죄 데이터를 학습하여 나쁜 사람들이 악용할 수 있는 가능성을 지적하고 있어요.

결론적으로, 애런슨 교수는 AI의 발전은 막을 수 없는 흐름이지만, 그 안전성과 윤리적 문제에 대한 지속적인 연구와 논의가 필요하다고 말했어요.

2025년이 온다면

AI의 발전은 빠르면 내년에 우리의 삶에 지금보다도 더욱 큰 변화를 가져올 거에요. 그러나 이러한 변화는 단순히 기술적 진보에 그치지 않고, 사회적, 윤리적 문제를 함께 고려할 필요가 있어요. AI가 인간의 삶을 더욱 풍요롭게 만들 수 있는 잠재력을 지니고 있지만, 그 과정에서 발생할 수 있는 부작용과 한계도 명확히 인식하고 대비해야 해요.

앞으로의 AI 시대는 기술과 인간이 조화롭게 공존하며, 서로의 장점을 극대화할 수 있는 방향으로 나아가야 할 거에요. 이러한 노력이 결실을 맺을 때, 에코 멤버님들은 그동안 해왔던 일들이 돌아와서 진정한 AI 시대의 혜택을 누릴 수 있을 거에요.

같이 읽어보면 좋은 글

Cinnamomo di Moscata (글쓴이) 소개

게임 기획자입니다. AI 아티스트로도 활동 중입니다. https://www.instagram.com/cinnamomo_di_moscata/

(1) Matthias Bastian. (2024). AI researcher says that ChatGPT's "secret ingredient" may be holding back LLM capabilities. the decoder. https://the-decoder.com/ai-researcher-says-that-chatgpts-secret-ingredient-may-be-holding-back-llm-capabilities/

(2) Elon Musk. (2024). "Grok 2 beta release soon https://t.co/t6e9RcXPkl". X. https://x.com/elonmusk/status/1822764457640055012

(3) xAI. (2024). Grok-2 Beta Release. xAI Blog. https://x.ai/blog/grok-2

(4) Anatolii. (2024). "Stanford ECON295/CS323 I 2024 I The Age of AI, Eric Schmidt [REUPLOAD] The source video appears to be taken down less than a day since being posted https://t.co/tWV9AvM9AD". X. https://x.com/quasa0/status/1823933017217482883

(5) MinasAnor. (2024). 에릭 슈미트 - Stanford 강의 (08.14 업로드). 디시인사이드. https://gall.dcinside.com/mgallery/board/view/?id=thesingularity&no=513026

(6) The Upwork Research Institute. (2024). From Burnout to Balance: AI-Enhanced Work Models for the Future. Upwork. https://www.upwork.com/research/ai-enhanced-work-models

(7) 임대준. (2024). AI 생산성의 역설..."직원들, 경영진과 AI 체감 달라". AI타임스. https://www.aitimes.com/news/articleView.html?idxno=162419

(8) The Institute of Art and Ideas. (2024). OpenAI expert Scott Aaronson on consciousness, quantum physics and AI safety | FULL INTERVIEW. YouTube. https://www.youtube.com/watch?v=e9O75xFQUio

(9) MinasAnor. (2024). OpenAI 전문가 Scott Aaronson 인터뷰 요약. 디시인사이드. https://gall.dcinside.com/mgallery/board/view/?id=thesingularity&no=510624

뉴스레터 광고 공간 (광고주를 모집합니다)

For newsletter banner advertising inquiries, please contact: Bopyo@aikoreacommunity.com

이곳에 서비스를 소개하세요!

뉴스레터 배너 광고 문의: Bopyo@aikoreacommunity.com

뉴스레터 편집장 소개

- 보표 홈페이지

- https://amzbopyo.com/

- 보표 SNS

- 보표 레터: https://www.bopyoletters.com/

- X(트위터): https://twitter.com/AIBopyo

- 스레드: https://www.threads.net/@bopyo.amz

- 링크드인: https://www.linkedin.com/in/bopyo-park-848631231/

- 인스타그램: https://www.instagram.com/bopyo.amz/

- AI 코리아 커뮤니티 아카데미

- https://app.aikoreacommunity.com/collections/932400