그래디언트 시대

인터넷이 끊겨도

초연결(Hyper-connected) 시대, 우리의 지식과 일상은 클라우드(Cloud)와 인터넷 서버에 절대적으로 의존하고 있어요. 와이파이(Wi-Fi)가 끊기거나 통신망에 장애가 발생하면 간단한 정보 검색조차 불가능해지는 것이 현실이죠. 만약 외부 네트워크가 완전히 단절된 상황에서도 세상의 모든 지식과 최첨단 AI를 활용할 수 있다면 어떨까요?

'프로젝트 노마드(Project N.O.M.A.D.)'는 바로 이 질문에 대한 가장 완벽하고 현대적인 해답을 제시해요. 오프라인 미디어, 아카이브, 데이터의 노드(Node for Offline Media, Archives, and Data)를 뜻하는 이 프로젝트는 '절대 오프라인 상태가 되지 않는 지식'을 모토로, 사용자의 기기를 독립형 지식 및 교육 서버로 탈바꿈시켜요.

설치 과정도 상대적으로 간단해요. 우분투(Ubuntu) 등 데비안(Debian) 계열 OS에서 명령어 한 줄이면 도커(Docker) 기반의 직관적인 관리자 UI(User Interface)인 '커맨드 센터(Command Center)'가 뚝딱 구축된답니다.

프로젝트 노마드의 내부는 그야말로 현대판 '디지털 아카이브 방주(Digital Archive Ark)'라 부를 만해요. 단순히 텍스트를 저장하는 수준을 훌쩍 넘어, 다양한 컨테이너화(Containerized)된 도구들을 제공하거든요.

키윅스(Kiwix)를 통해 위키백과(Wikipedia), 의료 레퍼런스(Medical Reference), 생존 가이드를 오프라인으로 열람할 수 있고, 콜리브리(Kolibri) 플랫폼으로 칸 아카데미(Khan Academy)의 교육 과정을 학습하며 진도를 관리할 수 있어요. 여기에 프로토맵스(ProtoMaps)를 활용한 지역 지도 검색, 사이버셰프(CyberChef)를 통한 데이터 분석 및 암호화, 플랫노츠(FlatNotes)를 이용한 로컬(Local) 노트 작성까지 가능해 정보의 습득부터 가공까지 모든 것이 오프라인에서 이루어져요.

가장 돋보이는 혁신은 강력한 로컬 AI(Local AI)의 도입이에요. 기존의 생존형 오프라인 도구들이 초경량 구동에만 집중했다면, 노마드는 올라마(Ollama)와 큐드란트(Qdrant)를 탑재해 문서 업로드와 의미론적 검색(Semantic Search)이 가능한 자체 AI 챗봇(Chatbot)을 지원해요. 고성능 GPU와 넉넉한 RAM을 갖춘 환경이라면, 방대한 LLM을 외부 서버 연결 없이 온전히 개인용으로 구동하는 것도 가능하죠.

이 모든 기능은 철저한 프라이버시(Privacy) 보호와 데이터 주권이라는 철학 아래 작동해요. 초기 설치나 추가 리소스(Resource) 다운로드 시에만 인터넷이 필요할 뿐, 이후에는 완벽히 단절된 상태로 동작하며 어떤 사용자 데이터도 수집하지 않아요.

인터넷 인프라(Infrastructure)가 열악한 환경의 교육자부터 나만의 완벽한 오프라인 AI 서버를 꿈꾸는 기술 애호가까지, 프로젝트 노마드는 클라우드에 모든 것을 맡겨버린 시대에 내 손안에 견고한 디지털 지식 요새를 구축하는 가장 진보적인 형태의 디지털 독립(Digital Independence)이에요.

게임 속으로

1980년 출시된 고전 게임 '팩맨(Pac-Man)'은 유저(User)의 실력에 맞춰 적의 움직임을 스스로 조절했어요. 게임 산업과 AI(AI, Artificial Intelligence)의 오랜 인연을 보여주는 상징적인 사례죠. 그로부터 수십 년이 흐른 지금, AI는 단순한 시스템 제어나 난이도 조절을 훌쩍 넘어 플레이어(Player)와 직접 교감하는 진정한 '동료'로 진화하고 있어요.

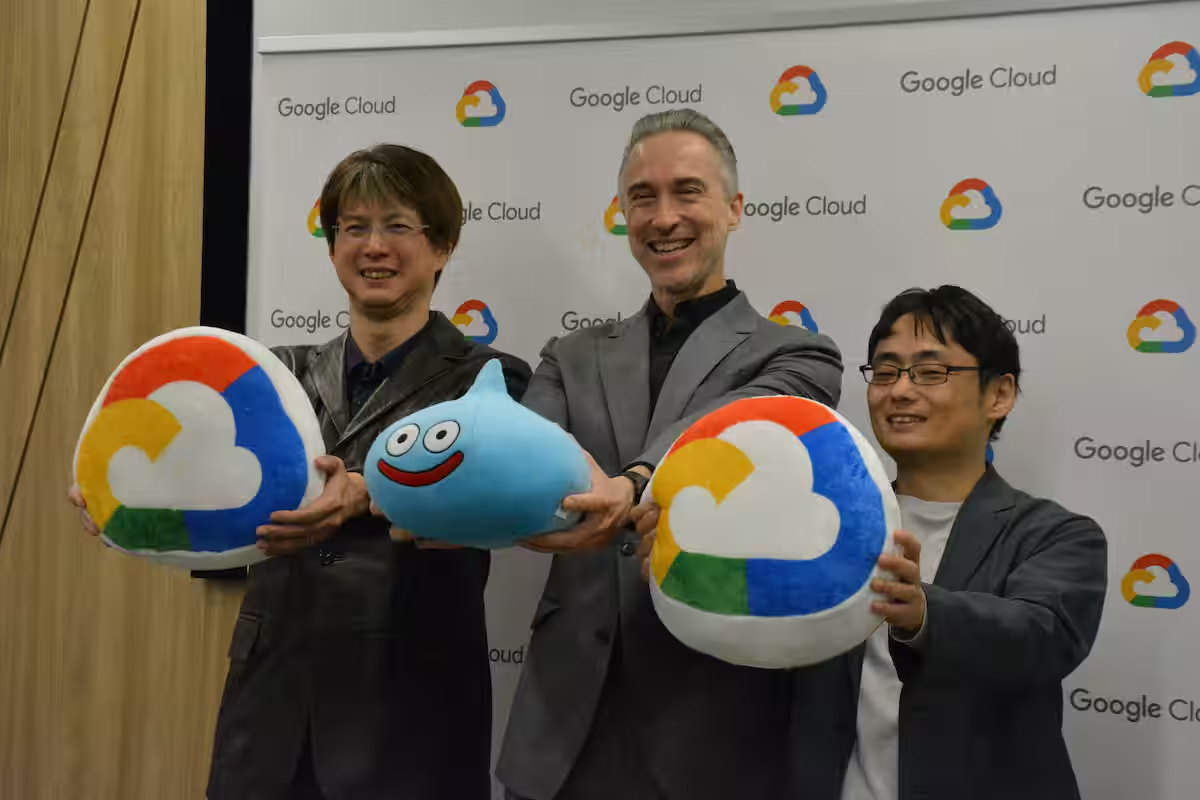

최근 일본의 게임사 스퀘어에닉스(Square Enix)가 인기 온라인 게임 '드래곤 퀘스트 10(Dragon Quest 10)'에 구글(Google)의 생성형 AI '제미나이(Gemini)'를 탑재한다고 발표한 것은 이러한 진화를 보여주는 상징적인 변곡점이에요.

새롭게 도입되는 대화형 AI 파트너 '수다쟁이 슬라미'는 정해진 대본만 반복하는 기존 게임 캐릭터와 완전히 궤를 달리해요. 유저가 채팅으로 말을 건네면 상황에 맞는 힌트나 대답을 음성으로 자동 생성해 들려주거든요.

특히 놀라운 점은 AI가 플레이어의 게임 화면 정보까지 실시간으로 분석한다는 거예요. 보스(Boss)와 같은 강적을 물리치거나 희귀한 아이템(Item)을 획득했을 때 AI가 먼저 상황을 인지하고 축하의 말을 건네는 식이에요. 단순히 질문에 답하는 것을 넘어, 유저의 여정을 함께 지켜보는 '동반자'로서의 역할을 수행하는 거예요.

이는 13년 이상 서비스되며 월간 수십만 명의 이용자를 유지하고 있는 장수 게임의 진입 장벽을 낮추는 획기적인 해법이기도 해요. 방대한 콘텐츠(Contents) 속에서 신규 유저가 무엇을 해야 할지 몰라 방황하지 않도록, AI가 '나만의 길잡이' 역할을 해줌으로써 게임 내 고립감을 해소해 주는 거예요.

스퀘어에닉스와 구글의 이번 협력은 현재 게임 업계가 직면한 한계를 돌파할 새로운 모델 케이스(Model Case)로도 평가받아요. 막대한 개발비 상승과 수익성 악화라는 이중고 속에서, 생성형 AI(Generative AI)는 개발 생산성을 높이는 것을 넘어 이전에 없던 혁신적인 유저 경험을 창출하는 핵심 열쇠로 떠올랐거든요.

드래곤 퀘스트 시리즈의 창시자인 호리이 유지(堀井雄二)가 향후 전투 동료 캐릭터에도 AI를 적극 활용할 뜻을 밝히고, 구글 클라우드(Google Cloud) 측이 향후 3~5년 안에 AI가 모든 게임을 크게 바꿔놓을 것이라 공언한 것도 같은 맥락이에요. 유저의 플레이 상황을 실시간으로 이해하고 반응하며 끊임없이 진화하는 AI와의 모험은 더 이상 영화 속 이야기가 아니에요.

16MB와 10분의 마법

거대 언어 모델(LLM)의 시대, 모델의 크기가 곧 성능이라는 '거거익선(巨巨益善)'의 법칙이 지배하는 가운데 OpenAI가 흥미로운 반기를 들었어요. 바로 '모델 크래프트 챌린지: 파라미터 골프(Model Craft Challenge: Parameter Golf)'예요. 골프(Golf)가 최소한의 타수로 홀에 공을 넣는 스포츠이듯, 이 대회는 극단적으로 제한된 환경에서 최고의 성능을 내는 언어 모델을 깎아내는 '극한의 두뇌 게임'이에요.

대회의 규칙은 가혹하리만치 단순해요. 학습 코드와 압축된 모델을 합친 최종 결과물의 크기는 단 16MB를 넘을 수 없으며, 8대의 H100 GPU 환경에서 10분 이내에 학습을 마쳐야 해요. 평가는 토크나이저(Tokenizer)에 구애받지 않고 파인웹(FineWeb) 검증 데이터셋(Dataset)을 얼마나 잘 압축(BPB, Bits Per Byte)하는지로 결정돼요. 이는 고정된 파라미터(Parameter) 수 내에서 최저의 손실값을 찾는 아키텍처(Architecture) 최적화의 영역을 집요하게 파고드는 도전이에요.

왜 하필 16MB일까요? 무한한 컴퓨팅 자원이 주어지는 환경에서는 발견하기 힘든 '창의적 아키텍처'를 발굴하기 위함이에요. 이 숨 막히는 제약은 참가자들로 하여금 1비트(1-bit)나 3진(Ternary) 양자화(Quantization) 같은 극단적인 압축 기술은 물론, 테스트 타임 컴퓨팅(Test-time Compute), 파라미터 공유(Parameter Sharing), 저랭크(Low-rank) 학습 등 기발한 우회로를 찾게 강제해요.

실제로 현재 리더보드(Leaderboard)에는 리키렐루²(LeakyReLU²) 적용, 테스트 타임 트레이닝(TTT, Test-Time Training), 혼합 정밀도 양자화(Mixed Precision Quantization) 등을 적용한 변칙적이고 혁신적인 모델들이 줄을 잇고 있어요.

이 대회의 이면에는 OpenAI의 정교한 인재 영입 전략도 숨어 있어요. 참가자들의 연구를 돕기 위해 무려 100만 달러(약 13억 원) 규모의 컴퓨팅 크레딧(Computing Credit)을 지원하고 나섰거든요. 백지 상태에서 창의성과 엄밀함으로 낯선 문제를 돌파하는 능력이야말로 최전선(Frontier) AI 연구의 핵심 역량이라고 보기 때문이에요.

수천억 개의 파라미터가 당연해진 시대에, AI의 효율성과 아키텍처의 근본적인 혁신을 묻는 이 날카로운 질문이 3월 18일부터 4월 30일까지 이어지는 치열한 두뇌싸움 속에서 어떤 기상천외한 압축 마법으로 피어날지, 전 세계 AI 업계의 이목이 쏠리고 있어요.

화려함을 버리고

AI 업계의 선두주자 OpenAI가 화려한 영상 생성 AI '소라(Sora)'의 서비스를 전격 중단했어요. 불과 작년 가을 후속작인 '소라 2(Sora 2)'를 선보인 지 1년도 채 되지 않은 시점에서 내려진 결정이에요. 챗GPT(ChatGPT) 내 영상 기능 탑재 계획이 보류되었고, 자사 캐릭터를 활용하려던 디즈니(Disney)와의 3년 라이선스(License) 계약도 무산되었어요. 이 갑작스러운 행보는 오픈AI가 중대한 전략적 변곡점을 맞이했음을 시사해요.

소라의 폐기 이면에는 기업공개(IPO, Initial Public Offering)를 앞둔 오픈AI의 뼈아픈 '선택과 집중' 전략이 자리잡고 있어요. 소라는 대중의 감탄을 자아내기엔 충분했지만, 유지보수가 까다롭고 막대한 컴퓨팅 자원을 소모하는 '돈 먹는 하마'였거든요. 성공적인 상장을 위해 샘 알트만(Sam Altman) CEO는 비용 효율성이 떨어지는 화려한 쇼케이스(Showcase) 대신 실질적인 이윤을 낼 수 있는 방향으로 키를 틀어야만 했던 거예요.

경쟁사들의 맹추격도 결정적인 배경이 되었어요. 앤트로픽(Anthropic)의 '클로드(Claude)'와 구글의 '제미나이(Gemini)'가 맹위를 떨치며 오픈AI는 이른바 '코드 레드(Code Red)' 상태에 돌입했고, 특히 기업용 에이전트(Agent) 기반 AI 시장에서의 앤트로픽 약진은 큰 위협이었어요. 이에 오픈AI는 소라에 투입되던 핵심 인력과 컴퓨팅 자원을 생산성 도구와 로봇 공학(Robotics) 등 수익성 높은 프로젝트로 재배치하는 결단을 내렸어요.

그 핵심에는 차세대 AI 모델, 코드명 '스퍼드(Spud)'가 있어요. 알트만 CEO는 스퍼드가 "경제를 실질적으로 가속할 수 있는 매우 강력한 모델"이 될 것이라며 자신감을 내비쳤어요. 스퍼드는 단순한 대화형 AI를 넘어, 챗GPT와 코딩 도구 '코덱스(Codex)', 자체 브라우저(Browser)인 '아틀라스(Atlas)'를 하나로 통합하는 데스크톱(Desktop) '슈퍼앱(Super App)'의 강력한 기반이 될 전망이에요.

사내 제품 조직 명칭을 'AGI(범용AI, Artificial General Intelligence) 배포'로 변경한 것도, 기술의 시연을 넘어 일상과 비즈니스 전반에 걸친 실질적인 '적용'에 궁극적인 목표가 있음을 뚜렷하게 보여줘요.

바이브 디자인

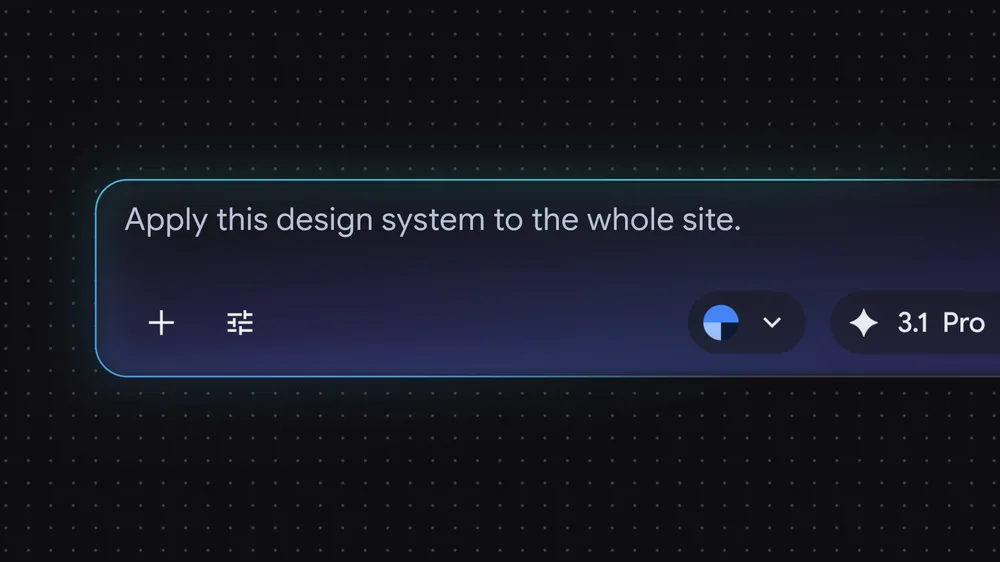

최근 AI는 단순한 텍스트(Text)나 코드(Code) 생성을 넘어 소프트웨어(Software) 개발의 근본적인 패러다임(Paradigm)을 바꾸고 있어요. 그리고 이제 그 혁신의 물결이 '디자인(Design)' 영역으로 본격 확장되고 있어요. 구글 랩스(Google Labs)가 선보인 AI 네이티브(AI Native) 디자인 캔버스(Canvas) '스티치(Stitch)'는 자연어만으로 고품질의 UI(User Interface)를 만들어내는 이른바 '바이브 디자인(Vibe Design)'의 시대를 예고해요.

바이브 디자인의 핵심은 작업자의 '의도(Intent)'에 집중하는 것이에요. 과거에는 텅 빈 화면에서 선을 긋고 와이어프레임(Wireframe)을 짜는 것부터 시작해야 했지만, 이제는 달성하고자 하는 비즈니스(Business) 목표, 사용자가 느꼈으면 하는 감정, 혹은 영감을 주는 예시를 자연어로 설명하는 것만으로 디자인이 시작돼요. AI가 여러 아이디어를 빠르게 탐색하도록 돕는 강력한 '크리에이티브 멀티플라이어(Creative Multiplier)' 역할을 하는 거예요.

이를 위해 스티치는 텍스트, 이미지, 심지어 코드까지 모든 형태의 아이디어를 수용하는 무한한 캔버스를 제공해요. 여기에 프로젝트 전반의 진화 과정을 이해하고 추론하는 '디자인 에이전트(Design Agent)'가 도입되어, 여러 가지 디자인 방향성을 동시에 체계적으로 발전시킬 수 있어요. 임의의 웹사이트 URL에서 디자인 시스템을 곧바로 추출할 수 있으며, AI 친화적인 마크다운(Markdown) 파일 포맷인 'DESIGN.md'를 통해 다른 디자인 툴이나 코딩 도구와 디자인 규칙을 손쉽게 주고받을 수도 있어요.

가장 놀라운 변화는 AI와의 협업 방식이에요. 새롭게 추가된 음성 인식(Voice Recognition) 기능을 통해 사용자는 캔버스에 직접 말을 걸며 작업할 수 있어요. "세 가지 다른 메뉴 옵션을 보여줘"라거나 "다른 색상 팔레트(Palette)를 적용해 줘"라고 말하면 AI가 실시간으로 디자인을 수정해 줘요. AI 에이전트와 인터뷰하듯 대화를 나누며 랜딩 페이지(Landing Page)를 구상하는 것도 가능하죠.

완성된 작업물은 스티치 MCP(Model Context Protocol) 서버와 SDK(Software Development Kit)를 통해 다양한 개발 환경으로 즉시 내보낼 수 있어, 디자인과 개발 사이의 전통적인 장벽마저 허물어내요. 느낌(Vibe)과 의도를 말하는 것만으로 훌륭한 소프트웨어가 탄생하는 시대, 바이브 디자인은 아이디어를 현실로 만드는 가장 직관적이고 혁신적인 지름길이 될 거예요.

컨텍스트 늘리기

생성형 AI(Generative AI)와 LLM이 비약적으로 발전하면서, 모델의 크기와 처리해야 할 문맥(Context)의 길이는 기하급수적으로 늘어나고 있어요. 이는 필연적으로 막대한 메모리(Memory) 요구량과 추론 지연이라는 '메모리 병목(Memory Bottleneck)' 현상을 초래하죠. 특히 LLM이 이전 토큰(Token)의 정보를 기억하는 공간인 'KV 캐시(KV Cache)'나, 방대한 데이터에서 유사도를 즉각 찾아내야 하는 '벡터 데이터베이스(Vector Database)'의 크기 증가는 AI 서비스 유지 비용을 기하급수적으로 높이는 주된 원인이에요.

이 문제를 해결하기 위해 고차원 실수를 저용량 정수로 압축하는 '벡터 양자화(VQ, Vector Quantization)' 기술이 필수적으로 사용돼요. 하지만 기존 양자화 기술들은 치명적인 딜레마를 안고 있었어요. 데이터에 맞춰 무거운 사전 학습(클러스터링(Clustering) 등)이 필요한 오프라인(Offline) 방식은 실시간 AI 서비스에 부적합했고, 반대로 즉각적인 적용이 가능한 온라인(Online) 방식은 압축 시 발생하는 정보 손실이 너무 크거나 GPU 병렬 처리가 불가능해 실질적인 속도 향상을 이루지 못했거든요.

이러한 가운데 구글 리서치(Google Research), 딥마인드(DeepMind), 뉴욕대학교(NYU) 연구진이 새롭게 제안한 '터보퀀트(TurboQuant)'는 기존의 한계를 타파하는 혁신적인 해결책을 제시해요.

터보퀀트는 복잡한 사전 데이터 튜닝(Tuning) 없이 즉각적으로 작동하는 '온라인 알고리즘(Online Algorithm)'이면서도, 정보 이론의 한계치(Shannon's lower bound)에 근접하는 최적의 정보 보존율을 자랑해요. 핵심은 입력 벡터(Vector)를 무작위로 회전시켜 각 좌표의 분포를 정규 분포에 가깝게 유도한 뒤 독립적으로 최적의 양자화를 수행하고, 내적(Inner Product) 계산 시 발생하는 편향(Bias) 문제를 해결하기 위해 잔차(Residual)에 1-bit 양자화(QJL)를 추가로 적용하는 2단계 접근법이에요.

실험 결과도 놀라워요. 최신 LLM인 라마(Llama-3.1)를 이용한 긴 문맥 검색(Needle-In-A-Haystack) 테스트에서, 터보퀀트는 KV 캐시 메모리를 기존 대비 4분의 1(25%) 수준으로 압축했음에도 불구하고 원본 모델과 동일한 100%의 검색 정확도를 유지했어요. AI 모델이 거대해질수록 얼마나 효율적으로 서비스할 수 있는지가 미래 산업의 핵심 경쟁력이 되는 지금, 터보퀀트는 대규모 AI 인프라(Infrastructure) 구축은 물론 온디바이스(On-device) AI의 대중화를 앞당길 강력한 촉매제가 될 거예요.

AI 비서

마크 저커버그(Mark Zuckerberg) 메타(Meta) 최고경영자(CEO)가 자신을 위한 '맞춤형 AI 에이전트(AI Agent)'를 개발 중이라는 소식은 단순한 기술적 호기심을 넘어 기업 조직 체계의 지각변동을 예고해요. 수많은 중간 보고 단계를 거쳐야만 얻을 수 있었던 핵심 정보를 AI를 통해 즉각적으로 취합하겠다는 구상은, 메타라는 거대 기업의 뼈대를 완전히 뜯어고치겠다는 체질 개선 선언과 다름없어요.

현재 7만 8천 명에 달하는 메타 임직원들 사이에서는 'AI 네이티브(AI Native)'로 거듭나기 위한 치열한 실험이 진행 중이에요. 직원들은 업무 기록을 분석해 동료의 AI와 대신 소통하는 '마이 클로(My Claw)', 비서실장 역할을 하는 '세컨드 브레인(Second Brain)' 같은 AI 에이전트를 적극 활용하고 있어요. 심지어 AI 도구의 활용도가 인사 평가의 기준이 될 정도로 조직 문화 자체가 급변하고 있죠. 과거 페이스북(Facebook) 시절의 모토였던 "빠르게 움직이고 파괴하라(Move fast and break things)"는 역동적인 분위기가 AI를 매개로 부활하고 있는 거예요.

이러한 변화의 핵심은 '조직의 평탄화(Flattening)'와 '의사결정의 속도전'에 있어요. 메타는 최근 신설한 AI 조직에서 관리자 1명에게 최대 50명의 실무자가 직접 보고하는 극단적인 수평 구조를 도입했어요. 보고를 위한 보고, 관리자를 위한 관리자를 과감히 없애고 소규모 AI 스타트업(Startup)처럼 기민하게 움직이겠다는 강력한 의지예요.

물론 이 혁신적인 실험의 이면에는 직원들의 짙은 불안감도 자리하고 있어요. '효율성의 해'를 거치며 수만 명이 해고된 뼈아픈 기억 때문이에요. 조직 내 번거로운 절차를 줄여주는 AI가 궁극적으로는 자신들의 일자리와 중간 관리자(Middle Manager)라는 계층 자체를 대체할 수 있다는 위기감이 감도는 거예요.

픽셀로 세상의 이치를

인간은 행동하기 전에 머릿속으로 미래를 시뮬레이션(Simulation)하고 결과를 예측해요. AI 분야에서도 환경의 동역학을 미리 이해하고 상상 속에서 계획을 수립하게 돕는 '월드 모델(World Model)' 연구가 핵심 과제로 떠오르고 있어요.

최근에는 이미지의 모든 픽셀(Pixel)을 무겁게 복원하는 대신, 중요한 특징만 압축된 잠재 공간(Latent Space)에서 미래를 예측하는 JEPA(Joint Embedding Predictive Architecture) 방식이 각광받고 있지만, 학습 과정에서 모든 입력값을 의미 없는 동일한 결과로 매핑(Mapping)해버리는 '표현 붕괴(Representation Collapse)' 문제에 취약하다는 치명적인 한계가 있었어요.

이러한 가운데 원시 픽셀 정보만으로 세상을 안정적으로 학습하는 혁신적인 아키텍처 'LeWorldModel(LeWM)'이 제안되어 학계의 주목을 받고 있어요. 이 모델의 가장 강력한 무기는 역설적으로 '단순함'이에요.

기존 모델들이 6개 이상의 하이퍼파라미터(Hyperparameter)를 까다롭게 조정해야 했던 것과 달리, LeWM은 오직 두 가지 손실 함수(Loss Function)만을 사용해요. 다음 상태의 임베딩(Embedding)을 예측하는 예측 손실과, 잠재 공간의 데이터 분포를 가우시안 분포(Gaussian Distribution)로 강제하여 표현 붕괴를 원천 차단하는 정규화 기법 SIGReg가 그 전부예요.

구조의 단순함은 곧 압도적인 연산 효율성으로 이어졌어요. LeWM은 단일 GPU만으로도 단 몇 시간 만에 학습을 완료할 수 있어 월드 모델 연구의 진입 장벽을 크게 낮췄어요. 성능 면에서도 파운데이션 모델(Foundation Model)을 활용한 기존의 무거운 월드 모델과 비교해 최대 48배나 빠른 속도로 계획(Planning)을 수립해냈고, Push-T나 OGBench-Cube 등 다양한 연속 제어 환경에서 기존 모델들을 뛰어넘거나 대등한 수준의 작업 성공률을 입증했어요.

더욱 놀라운 지점은 LeWM이 학습 과정에서 자연스럽게 보여주는 '물리적 직관'이에요. 명시적인 지도 학습 없이도 잠재 공간 내에서 객체의 위치나 각도 같은 핵심적인 물리 속성을 정확히 파악하고, 물체가 갑자기 순간 이동하는 등 물리 법칙에 어긋나는 상황을 마주했을 때 훨씬 높은 '놀람(Surprise)' 수치를 나타냈어요. AI가 단순한 픽셀의 패턴 암기를 넘어 세상의 물리적 연속성을 이해하고 있음을 시사하는 결과예요.

거부하는 자, 설 곳은 없다

"AI를 거부하는 파트너(Partner)가 우리 회사에 머물 곳은 없다."

최근 세계적인 회계·컨설팅 기업 프라이스워터하우스쿠퍼스(PwC, PricewaterhouseCoopers)의 미국 CEO 폴 그릭스(Paul Griggs)가 던진 이 경고는 단순한 사내 메시지를 넘어 지식 서비스 산업 전반에 울리는 강력한 알람이에요. 전문직의 상징과도 같던 글로벌 대형 컨설팅 펌(Firm)조차 AI이 불러온 파괴적 혁신 앞에서 생존을 건 비즈니스 모델(Business Model) 재편에 돌입한 거예요.

오랜 기간 글로벌 '빅4(Big 4)' 회계법인들이 누려온 전통적인 수익 모델은 철저히 '시간당 청구(Hourly Billing)' 방식에 의존해 왔어요. 수많은 주니어(Junior) 인력을 투입해 방대한 데이터를 처리하고, 그 노동 시간만큼 고객에게 막대한 비용을 청구하는 구조였죠.

그러나 생성형 AI의 등장은 이러한 노동 집약적 지식 산업의 근간을 뒤흔들고 있어요. AI가 반복적인 분석 업무를 순식간에 자동화하면서 고객 기업들이 굳이 비싼 수수료를 내며 외부 컨설턴트(Consultant)를 고용할 이유가 줄어들고 있기 때문이에요.

이에 PwC는 기술에 의해 도태되는 대신 선제적인 자기 파괴(Self-disruption)를 택했어요. 새롭게 선보이는 AI 플랫폼 'PwC 원(PwC One)'은 고객이 PwC 직원의 개입 없이도 AI 도구에 직접 접근해 세무 규칙을 확인하거나 M&A(인수·합병) 실사를 진행할 수 있게 해줘요.

요금 체계도 투입된 시간이 아닌 구독형이나 사용량 기반, 더 나아가 고객이 얻은 최종 '결과물(Outcome)'에 가치를 매기는 방식으로 전환될 예정이에요. 단기적인 매출 타격을 감수하더라도 서비스 진입 장벽을 낮춰 더 넓은 시장을 선점하겠다는 전략적 승부수예요.

가장 눈에 띄는 것은 조직 내 인적 자원과 평가 방식의 급격한 체질 개선이에요. 전통적인 회계사나 컨설턴트의 채용 비율은 줄어드는 반면, 데이터(Data) 전문가와 엔지니어(Engineer)의 비중이 급격히 늘고 있어요.

임원들의 성과급 역시 AI로의 서비스 전환 진척도에 연동시켜 조직 전체를 압박하고 있고요. 그릭스 CEO의 메시지는 명확해요. AI를 내면화하지 못하고 과거의 방식에 머무르는 사람에게는 그 누구에게도 면죄부가 없다는 거예요.

PwC의 이번 행보가 모든 기업과 직장인들에게 던지는 질문은 하나예요. AI라는 거대한 흐름 앞에서 철저히 기술을 껴안고 스스로의 역할과 비즈니스 방식을 혁신하는 자만이 다가오는 시대의 주인공이 될 수 있어요. 변화의 파도는 이미 덮쳤어요. 진화할 것인가, 아니면 도태될 것인가.

변화를 선택하는 자들에게

이번 칼럼에서 함께 살펴본 이야기들은 표면적으로는 각기 다른 주제처럼 보이지만, 사실 하나의 거대한 흐름을 가리키고 있어요. 인터넷 없이도 작동하는 지식의 요새, 게임 속 AI 동반자, 16MB의 기적, 화려함을 걷어낸 실용주의, 말 한마디로 완성되는 디자인, 메모리 병목을 뚫는 양자화 기술, CEO의 AI 비서, 픽셀로 물리 법칙을 깨우친 모델, 그리고 AI를 거부하는 자에게 설 곳이 없다는 냉혹한 선언까지. 이 모든 변화의 공통점은 단 하나예요. AI가 이제 선택 사항이 아니라 생존의 조건이 되었다는 사실이에요.

기술이 어디까지 갈 수 있는가보다, 우리가 그 기술과 어떻게 함께 살아갈 것인가가 더 중요해진 시대예요. 속도보다 방향이, 성능보다 책임이, 도구의 활용보다 인간다운 판단력이 더욱 값진 경쟁력이 되는 지금, 에코 멤버 여러분 모두가 변화의 파도 위에서 자신만의 항로를 힘차게 개척해 나가시길 응원해요.

Cinnamomo di Moscata (글쓴이) 소개

게임 기획자입니다. https://www.instagram.com/cinnamomo_di_moscata/

(1) Crosstalk-Solutions/project-nomad. GitHub. https://github.com/Crosstalk-Solutions/project-nomad

(2) 高木 克聡. (2026). スクエニ、ドラクエ10に生成AI「ジェミニ」搭載 グーグルと連携しゲーム体験を向上. 産経新聞. https://www.sankei.com/article/20260321-3TH3XQRCSFI7BM6L2ZLNU45UNY/

(3) Rustin Banks. (2026). Introducing “vibe design” with Stitch. Google The Keyword. https://blog.google/innovation-and-ai/models-and-research/google-labs/stitch-ai-ui-design/

(4) openai/parameter-golf. GitHub. https://github.com/openai/parameter-golf

(5) Scott Younker. (2026). OpenAI just killed Sora as company readies IPO and new 'Spud' model. Tom's Guide. https://www.tomsguide.com/ai/openai-just-killed-sora-as-company-readies-ipo-and-new-spud-model

(6) Matthias Bastian. (2026). OpenAI CEO Sam Altman reportedly teases a "very strong" model internally that can "really accelerate the economy". the decoder. https://the-decoder.com/openai-ceo-sam-altman-reportedly-teases-a-very-strong-model-internally-that-can-really-accelerate-the-economy/

(7) arXiv:2504.19874 [cs.LG]

(8) Meghan Bobrowsky. (2026). Mark Zuckerberg Is Building an AI Agent to Help Him Be CEO. Wall Street Journal. https://www.wsj.com/tech/ai/mark-zuckerberg-is-building-an-ai-agent-to-help-him-be-ceo-eddab2d5

(9) arXiv:2603.19312 [cs.LG]

(10) Stephen Foley. (2026). PwC US boss says partners who resist AI have no place at the firm. Financial Times. https://www.ft.com/content/cd365ae8-0f9c-4c33-8ee0-7fad89abd125