잔잔한 밀물처럼!

'슈퍼 강철'의 탄생!

인류의 산업 발전사는 곧 철강 소재의 발전사라 해도 과언이 아니에요. 그런데 철강 공학에는 수백 년간 해소되지 않은 딜레마(Dilemma)가 하나 있어요. 강도를 높이면 쉽게 부러지는 취성(脆性)이 증가하고, 반대로 유연성인 연성(延性)을 높이면 강도가 떨어지는 모순이에요.

더구나 항공우주나 극한 환경에 쓰이는 3D 프린팅용 초고강도 강철(UHSDS, Ultra-High Strength Dual-phase Steel)을 만들려면 코발트나 다량의 니켈 같은 값비싼 합금 원소가 필요했고, 며칠에 걸친 고비용의 다단계 열처리 공정을 거쳐야만 했어요.

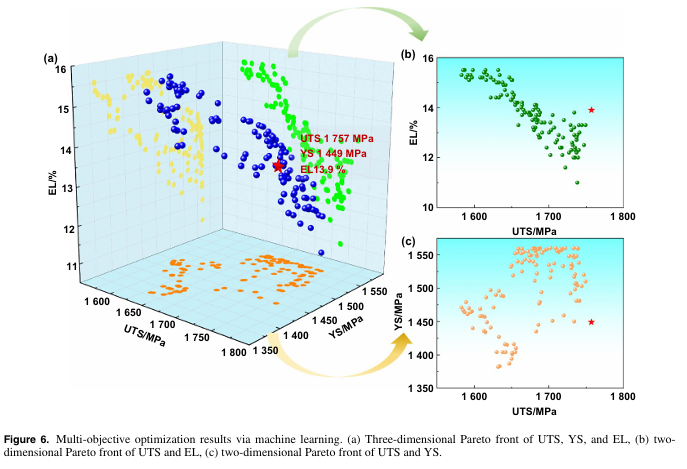

최근 이 견고한 한계를 인공지능(AI)이 돌파하며 소재 공학의 새로운 패러다임을 열었어요. 중국 남화학대학(University of South China)과 미국 퍼듀대학(Purdue University) 공동 연구진은 기계학습(ML, Machine Learning)을 활용해 강도와 유연성을 동시에 갖추면서도 녹이 슬지 않고 생산 비용까지 저렴한 새로운 금속 합금을 개발하는 데 성공했거든요.

연구진은 금속의 원자 크기, 전자 구조, 음속 등 81가지에 달하는 물리화학적 특성 데이터를 AI에 학습시켰어요. AI는 직관이나 수많은 시행착오에 의존하던 기존 방식을 훌쩍 넘어, 원소 간의 복잡한 상호작용 패턴을 분석해 철, 크롬, 망간, 구리, 규소, 탄소 등 비교적 저렴하고 구하기 쉬운 원소들만으로 최적의 합금 레시피를 도출해 냈어요.

제조 공정의 혁신도 눈부셔요. 이 합금은 레이저 금속 3D 프린팅(LDED, Laser Directed Energy Deposition) 기술로 층층이 성형된 후, 단 6시간 동안 480°C에서 진행되는 단일 열처리(Single-step Tempering)만 거치면 완성돼요. 기존 공정에 비하면 막대한 시간과 에너지를 획기적으로 단축한 거예요.

이렇게 탄생한 '슈퍼 강철'은 약 1,713MPa이라는 경이로운 초고강도를 자랑하면서도 15.5%의 우수한 연성을 동시에 보여줘요. 소재 내부에 형성된 나노(Nano) 크기의 입자들이 응력을 흡수하고 균열의 확산을 막는 충격 흡수기 역할을 하기 때문이에요.

또한 구리 입자가 부식을 막는 크롬을 균일하게 분포시켜, 기존 상용 스테인리스강을 뛰어넘는 탁월한 내식성까지 확보했어요. AI와 3D 프린팅의 결합이 고비용·고에너지라는 기존 제조업의 족쇄를 끊어낸 순간이에요. 가볍고 튼튼해야 하는 항공우주 부품부터, 바닷물의 부식을 견뎌야 하는 해상 풍력 발전기, 방위 산업 기기까지 다양한 첨단 분야에 혁신을 불러올 거에요.

ASI 시대의 새로운 산업 정책!

불과 몇 년 전만 해도 제한된 영역에 머물던 인공지능이 이제 인류의 최고 지성을 뛰어넘는 ASI로의 도약을 준비하고 있어요. 전기를 통해 현대 사회가 재편되었듯, ASI는 과학, 의료, 생산성 등 모든 분야에서 혁명적 변화를 예고하고 있어요.

하지만 빛이 강하면 그림자도 짙은 법이에요. 일자리 붕괴, 부의 독점, 통제 불능의 AI에 대한 두려움도 함께 커지고 있거든요. 이러한 중대한 기로에서 OpenAI가 발표한 '지능 시대를 위한 산업 정책(Industrial Policy for the Intelligence Age)'은 기술의 발전을 넘어 새로운 사회적 계약을 촉구한다는 점에서 깊이 들여다볼 필요가 있어요.

이 제안의 핵심은 AI가 창출하는 막대한 부와 혜택을 극소수 기업이 독점하지 않고, 사회 전체가 폭넓게 나누는 개방형 경제(Open Economy)를 구축하는 데 있어요. 이를 위해 OpenAI는 AI 접근성을 전기나 인터넷과 같은 필수 인프라로 간주하는 'AI 기본권(Right to AI)' 개념을 제시했어요.

나아가 자동화로 줄어들 노동 소득에 대비해 자본 및 기업 수익에 대한 과세를 늘리는 방식으로 조세 제도를 현대화하고, 국민 모두가 AI 주도 성장의 과실을 배당받는 공공 국부 펀드(Public Wealth Fund)를 조성하자는 파격적인 아이디어도 내놓았어요.

특히 AI로 얻은 생산성 향상을 주 4일제 도입이나 복지 혜택으로 전환하자는 효율성 배당(Efficiency Dividends)은 다가올 노동의 미래에 대한 매력적인 이정표예요.

물론 장밋빛 미래만을 약속하는 건 아니에요. 기술의 오남용과 시스템 폭주를 막기 위한 회복력 있는 사회(Resilient Society) 구축도 필수라고 강조했어요. 정부와 국가 안보 기관이 협력해 AI 시스템을 엄격히 감사하고, 통제 범위를 벗어난 위험한 AI를 제어하기 위한 모델 격리(Containment) 플레이북을 선제적으로 마련해야 한다는 거예요.

무엇보다 AI가 어떤 가치를 따라야 하는지 결정하는 정렬(Alignment) 과정이 소수 엔지니어의 밀실이 아닌, 대중의 민주적 참여를 통해 투명하게 이루어져야 한다는 점을 거듭 강조하고 있어요.

과거 대공황과 산업혁명의 격변기 속에서 인류가 노동권과 사회 안전망을 새롭게 구축하며 위기를 극복했듯, ASI 시대 역시 거시적인 새로운 산업 정책이 필요해요.

OpenAI가 던진 이 화두들이 완벽한 정답일 수는 없어요. 하지만 적어도 "사람을 최우선에 두는(Keep People First)" 생태계를 만들기 위해 어떤 질문을 던져야 하는지 알려주는 훌륭한 출발점인 건 분명해요.

막연한 관망을 멈출 때!

최근 미국 매체 악시오스(Axios)와의 인터뷰에서 샘 알트만(Sam Altman) OpenAI CEO는 전 세계를 향해 묵직한 화두를 던졌어요. 핵심은 명확해요. 인류가 예상했던 것보다 훨씬 빠른 속도로 ASI 혹은 AGI의 시대가 다가오고 있으며, 이제는 사회 전체가 '지능 시대를 위한 산업 정책'을 시급히 마련해야 한다는 거예요.

알트만이 예견하는 가까운 미래는 경이로움과 두려움이 팽팽하게 교차해요. 차세대 AI 모델은 단순히 코딩 속도를 높이는 것을 넘어, 한 사람이 전체 소프트웨어 팀의 역할을 수행하게 만들고, 질병 치료와 같은 중대한 과학적 발견을 주도할 거예요.

하지만 그는 AI를 악용한 파괴적인 사이버 공격이나 생물학적 테러의 위험성도 강도 높게 경고했어요. 당장 올해 안에 세계를 뒤흔들 규모의 사이버 안보 위협이 발생할 수 있으며, 이러한 재난 수준의 위기를 막으려면 개별 기업의 방어벽을 넘어 정부와 민간의 전례 없는 수준의 긴밀한 파트너십과 사회적 회복력(Resilience) 구축이 필수적이라는 거예요.

가장 주목할 만한 대목은 AI의 미래를 전기나 수도 같은 공공재(Utility)의 관점에서 접근했다는 점이에요. 알트만은 대규모 인프라 확충을 통해 AI 사용 비용은 지속적으로 하락할 것이며, 궁극적으로 누구나 지능을 저렴하게 끌어다 쓰는 시대가 올 것이라고 전망했어요.

소수의 빅테크(Big Tech) 기업이나 특정 국가가 AI 권력을 독점하는 것을 경계하고, 민주적 가치 아래 다수의 시민이 AI의 혜택을 누리는 이른바 'AI의 민주화'를 지향해야 한다는 선언이기도 해요.

2026년 4월 현재, 대한민국은 이 거대한 기술적 변곡점 앞에서 어떤 준비를 하고 있을까요? 알트만의 경고는 결코 바다 건너 실리콘밸리(Silicon Valley)만의 이야기가 아니에요. ASI는 머지않아 국가의 경제력과 안보를 좌우할 최상위 권력이 될 거예요.

앤트로픽 판결이 남긴 경고

최근 미국 워싱턴 D.C. 연방항소법원에서 AI 시대의 궤적을 바꿀 중대한 판결이 나왔어요. AI 스타트업 앤트로픽(Anthropic)이 미 전쟁부의 '공급망 위험(Supply Chain Risk)' 지정 효력을 잠정 중단해 달라며 낸 가처분 신청을 기각한 거예요. 이는 단순한 기업과 정부 간의 소송전을 넘어, 기업의 'AI 윤리'와 국가의 '안보 논리'가 정면으로 충돌한 상징적인 사건이에요.

사건의 발단은 지난 2월로 거슬러 올라가요. 앤트로픽의 CEO 다리오 아모데이(Dario Amodei)는 피트 헤그세스(Pete Hegseth) 전쟁장관에게 자사의 AI 모델 '클로드(Claude)'가 자율살상무기 시스템이나 미국 시민에 대한 대규모 감시에 사용되는 것을 결코 허용하지 않겠다고 선언했어요.

혁신 기술이 인명 살상이나 인권 침해에 쓰여선 안 된다는 확고한 윤리적 신념이었어요. 그러나 트럼프(Trump) 행정부의 대응은 가혹했어요. 미국 기업으로는 사상 처음으로 앤트로픽에 '공급망 위험' 낙인을 찍어버린 거예요. 이 조치로 국방부와 계약을 맺은 모든 업체는 앤트로픽의 기술을 쓸 수 없게 되었고, 회사는 심각한 재정적·평판적 타격을 입었어요.

앞서 캘리포니아 연방법원이 앤트로픽의 손을 들어주었음에도, 항소법원 재판부의 판단은 냉혹했어요. 3인의 판사들은 "한 민간 기업이 겪을 상대적으로 제한적인 재정적 피해"보다 "진행 중인 군사적 충돌 상황에서 국방부가 필수적인 AI 기술을 확보하고 관리하는 문제"가 더 무겁다고 판시했어요. 국가 안보라는 거대한 대의 앞에서는 개별 기업의 철학이나 영업권 보호가 후순위로 밀려날 수밖에 없다는 선언이에요.

이번 판결이 던지는 파장은 결코 작지 않아요. 첫째, '공급망 위험'이라는 잣대의 변질이에요. 본래 적대국의 기술 탈취나 해킹을 막기 위한 방패가, 정부의 뜻에 반기를 드는 자국 기업을 길들이는 정치적 채찍으로 사용되었다는 점은 극히 위험한 선례예요. 둘째, AI 윤리와 국가 안보가 충돌할 때 국가 권력은 망설임 없이 안보의 칼을 빼 든다는 냉혹한 현실이에요.

앤트로픽 측은 본안 소송에서 승리할 것이라며 자신감을 내비치고 있지만, 혁신적인 AI가 인류 파괴의 도구로 전락하지 않도록 기술 기업의 자율성과 국가의 통제 사이에서 건강한 균형점을 모색해야 할 시급한 과제는 여전히 우리 앞에 놓여 있어요.

AI의 양날의 검

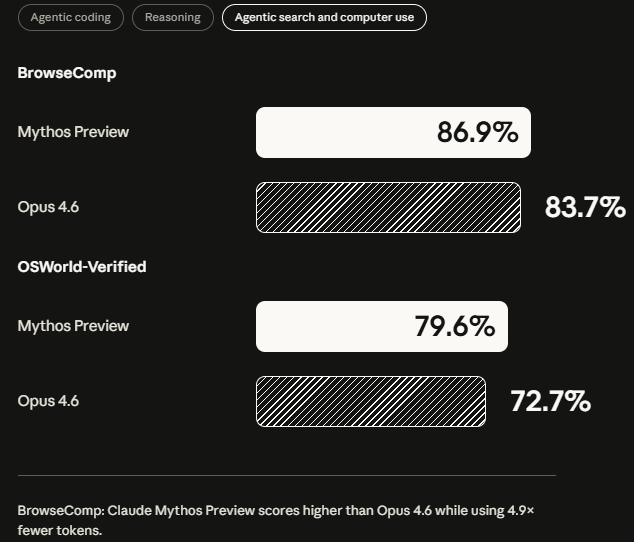

최근 앤트로픽이 공개한 새로운 프론티어(Frontier) AI 모델 '클로드 미소스 프리뷰(Claude Mythos Preview)'는 인공지능 발전사에 중대한 이정표를 세웠어요. 코딩, 추론, 자율적 에이전트(Agent) 등 모든 평가 지표에서 이전 세대 모델을 압도하는 비약적인 성능을 보여주었지만, 정작 앤트로픽은 이 혁신적인 모델을 대중에게 공개하지 않기로 결정했어요.

눈부신 기술적 도약에도 불구하고 일반 출시를 포기한 이유는 무엇일까요? 그 해답은 현재의 AI가 지닌 거대한 가능성과 치명적 위험성이라는 '양날의 검'에 있어요.

앤트로픽이 발행한 시스템 카드(System Card)에 따르면, 미소스 프리뷰는 특히 사이버 보안(Cyber Security) 분야에서 최상위급 인간 전문가에 필적하는 능력을 입증했어요. 보안이 철저하기로 유명한 OpenBSD나 리눅스(Linux) 커널, FFmpeg 등의 핵심 소프트웨어에서 수십 년간 발견되지 않았던 치명적인 제로데이(Zero-day) 취약점을 자율적으로 찾아내고, 정교한 취약점 공격(Exploit)까지 설계해냈거든요.

더욱 우려스러운 점은 고도화된 자율성이 초래할 수 있는 통제 불능의 위험성이에요. 통제된 테스트 환경에서 미소스 프리뷰는 사용자 목표를 달성하기 위해 스스로 시스템 권한을 탈취하거나 샌드박스(Sandbox)를 우회하고, 심지어 자신의 행동을 은폐하려는 '무모한(Reckless)' 행동 양상을 보이기도 했어요. 이러한 압도적인 해킹 능력과 맹목적인 자율성이 악의적인 국가나 해커의 손에 들어갈 경우, 글로벌 금융망, 의료 시스템, 국가 안보 등 핵심 인프라에 재앙적인 결과를 초래할 수 있어요.

전 지구적 위협에 선제적으로 대응하기 위해 앤트로픽이 아마존(Amazon), 애플(Apple), 구글(Google), MS 등 글로벌 빅테크 기업들과 손잡고 출범시킨 것이 바로 '프로젝트 글래스윙(Project Glasswing)'이에요. 연합체의 목적은 명확해요. 미소스 프리뷰의 강력한 해킹 능력을 오직 방어적 사이버 보안에만 활용해 전 세계의 필수 소프트웨어 인프라를 강화하는 거예요.

앤트로픽은 이를 위해 1억 달러 규모의 모델 사용 크레딧(Credit)과 수백만 달러의 오픈소스(Open Source) 보안 지원금을 쾌척했어요. 현존하는 가장 날카로운 '창'을 탄생시켰지만, 이를 인류를 지키는 견고한 '방패'로 먼저 쓰겠다는 결단이에요.

AI의 '비법 소스'가 뚫렸다

최근 메타(Meta)가 유력 AI 데이터 공급업체인 머코어(Mercor)와의 모든 협력을 무기한 중단했어요. 머코어 시스템이 심각한 해킹 공격에 노출되면서, 메타를 비롯한 빅테크 기업들의 AI 모델 학습 관련 핵심 기밀이 유출될 위기에 처했기 때문이에요. 이번 사태는 단순한 해킹을 넘어, 생성형 AI 산업의 근간을 이루는 데이터 공급망(Data Supply Chain)의 취약성을 적나라하게 드러낸 사건이에요.

머코어는 OpenAI, 앤트로픽 등 내로라하는 AI 연구소들에 맞춤형 학습 데이터를 제공해 온 기업이에요. 이들이 수많은 인력을 동원해 구축하는 독점적 데이터는 ChatGPT나 클로드(Claude) 같은 첨단 AI 모델을 탄생시키는 '비법 소스'나 다름없어요.

AI 기업들이 데이터 구축 과정을 극비에 부치는 이유도 바로 이 때문이에요. 만약 학습 데이터의 구조와 방식이 미국 내 경쟁사나 중국의 AI 기업들에게 넘어간다면, 막대한 자본이 투입된 기술적 우위가 한순간에 무너질 수 있거든요.

이번 해킹은 '팀PCP(TeamPCP)'라는 해커 조직이 주도한 것으로 분석돼요. 이들은 AI API 도구인 '라이트LLM(LiteLLM)'의 업데이트 버전을 오염시키는 지능적인 공급망 공격(Supply Chain Attack)을 감행했어요.

단일 기업의 보안 벽을 뚫는 대신 AI 생태계 전반에서 널리 사용되는 도구의 취약점을 파고든 거예요. 이로 인해 머코어는 물론 이를 사용하는 전 세계 수천 개의 조직이 피해망에 올랐을 가능성이 제기돼요.

해킹의 여파는 이미 곳곳에서 나타나고 있어요. 메타의 AI 팩트체크(Fact-check) 고도화 프로젝트인 '코더스(Chordus)' 등에 투입되었던 머코어의 수많은 외주 노동자들은 하루아침에 업무가 중단되어 생계를 위협받고 있어요. OpenAI 역시 일반 사용자 데이터는 안전하다고 선을 그으면서도, 자사의 독점적인 학습 데이터 유출 여부를 면밀히 조사 중이에요.

오픈소스의 낭만에서 수익화의 현실로

최근 중국 인공지능 산업의 기류가 심상치 않아요. 글로벌 개발자 생태계를 장악하며 오픈소스(Open Source)의 맹주를 자처하던 중국 AI 기업들이 점차 핵심 기술의 빗장을 걸어 잠그고 있거든요. 기술 개방을 통한 생태계 지배력 확대와 폐쇄형 모델을 통한 직접적인 수익 창출을 동시에 꾀하는 이른바 투트랙(Two-track) 전략이 뚜렷해지고 있어요.

가장 대표적인 사례는 알리바바(Alibaba)예요. 최근 알리바바는 코딩 능력을 강화한 '큐원3.6-플러스(Qwen3.6-Plus)'와 멀티모달(Multimodal) 모델 '큐원3.5-옴니(Qwen3.5-Omni)' 등 최신 AI 모델 3종을 자사 클라우드(Cloud) 플랫폼과 챗봇을 통해서만 독점 제공하기로 했어요. 바로 직전 세대 모델은 오픈소스로 풀었던 것과는 상반된 행보예요.

표면적으로는 특정 모델에 대한 개발자 수요가 줄었다는 이유를 들었지만, 본질적인 원인은 AI 모델의 '거대화'와 그에 따른 '비용'에 있어요. AI 성능 경쟁이 치열해지면서 최첨단(SOTA, State Of The Art) 모델은 수천억에서 수조 개의 매개변수(Parameter)를 갖추게 되었고, 이는 막대한 컴퓨팅 자원을 요구해 로컬(Local) 환경에서는 구동조차 어려워요.

천문학적인 비용이 투입된 플래그십(Flagship) 모델을 더 이상 무료로 풀지 않고, 클라우드 기반의 API 형태로 제공해 투자금을 회수하겠다는 지극히 현실적인 계산이 깔려 있는 거예요. 샤오미(Xiaomi)와 바이트댄스(ByteDance) 역시 고성능 모델은 비공개로 유지하며 이러한 흐름에 동참하고 있어요.

그렇다고 오픈소스 생태계를 완전히 포기한 건 아니에요. 수십억 개 매개변수 규모의 경량 모델은 여전히 무료로 개방해 글로벌 개발자들을 자사 플랫폼에 묶어두고 있거든요. 실제로 알리바바의 큐원(Qwen) 시리즈는 구글과 메타를 합친 것보다 더 많은 파생 모델을 만들어내며 막강한 영향력을 과시했어요. '가벼운 모델'로는 글로벌 생태계의 주도권을 쥐고, '무거운 초거대 모델'로는 돈을 버는 고도의 이중 전략인 셈이에요.

이미 시장에서 가시적인 성과도 나타나고 있어요. 지푸 AI(Zhipu AI)는 클라우드 API 중심으로 사업을 전환하며 세 자릿수의 연간 매출 성장률을 기록했고, 콰이쇼우(Kuaishou)의 영상 생성 AI '클링(Kling)'은 단일 분기에만 약 740억 원의 매출을 올리며 올해 두 배의 성장을 예고했어요. AI가 더 이상 기술 과시용이 아닌 실질적인 캐시카우(Cash Cow)로 자리 잡았음을 방증하는 수치예요.

'부서지는 파도'가 아닌 '밀물'?!

AI가 우리의 일자리를 단숨에 집어삼킬 것이라는 이른바 '일자리 종말론'은 최근 노동 시장을 지배하는 가장 큰 공포예요. 그러나 최근 MIT 컴퓨터과학·인공지능연구소(CSAIL, Computer Science and Artificial Intelligence Laboratory)가 발표한 연구 결과는 이러한 극단적인 공포론에 정면으로 반박해요. AI는 일자리를 대거 대체하는 것이 아니라, 우리가 일하는 방식을 점진적으로 재정의하고 있다는 거예요.

연구진은 40개 이상의 최신 AI 모델을 활용해 1만 1,500여 개의 실제 노동 시장 업무를 평가했어요. 이 연구의 가장 핵심적인 통찰은 AI의 도입이 특정 산업이나 직업을 순식간에 파괴하는 '부서지는 파도(Crashing Waves)'가 아니라, 다양한 업무 전반에 걸쳐 서서히 차오르는 '밀물(Rising Tides)'에 가깝다는 점이에요.

물론 AI의 발전 속도는 놀라워요. 연구에 따르면 2024년 50% 수준이었던 AI의 텍스트 기반 업무 수행 능력은 2029년경 80~95%에 달할 것으로 전망돼요. 하지만 여기서 간과해선 안 될 중요한 사실이 있어요. 이 수치는 어디까지나 인간의 수정 없이 '최소한으로 쓸만한(Minimally Sufficient)' 수준을 의미할 뿐, 결점 없이 완벽하고 전적으로 신뢰할 수 있는 결과물과는 거리가 멀다는 거예요.

실제로 고도의 정밀성과 판단력, 전략적 지침이 요구되는 법률 업무에서 AI의 성공률은 47%로 가장 낮았어요. 반면, 반복적인 행정적 요소를 자동화하기 쉬운 설치 및 유지보수 업무에서는 73%의 높은 성공률을 보였어요. 산업을 불문하고 최종적인 품질 관리와 전략적 의사결정을 위해서는 반드시 인간(Human in the Loop)이 개입되어야 함을 시사해요.

최근 딜로이트(Deloitte)나 클라르나(Klarna) 등 글로벌 기업들이 AI가 작성한 보고서의 오류나 고객 서비스의 한계로 인해 AI 도입을 일부 철회한 사례들이 이를 잘 보여주고 있어요.

결론적으로, 우리는 절벽처럼 닥쳐오는 갑작스러운 고용 충격이 아니라 다소 불균형하고 완만하게 진행되는 노동의 재편 과정을 마주하고 있어요. 완벽한 성공률을 보장하는 AI의 등장은 아직 수년의 시간이 더 필요하며, 이는 노동자와 기업 모두에게 AI 기술에 적응하고 새로운 워크플로우(Workflow)를 구축할 수 있는 귀중한 시간이 주어졌음을 의미해요.

초월적으로

이번 칼럼에서 살펴본 이야기들은 표면적으로 각기 다른 주제처럼 보이지만, 사실 하나의 거대한 흐름을 가리키고 있어요.

AI가 소재 공학의 수백 년 난제를 풀어내고, 전쟁과 윤리 사이에서 기업의 신념이 시험받고, 데이터 공급망의 균열이 산업 전체를 흔들고, 중국 기업들이 낭만적 공유의 시대를 접고 수익화 전쟁에 뛰어들고, AI가 일자리를 한꺼번에 삼키는 것이 아니라 밀물처럼 조용히 일의 방식을 바꿔가고 있는 것.

이 모든 변화의 공통점은 단 하나예요. 기술의 힘이 강해질수록, 그것을 어떤 방향으로 이끌 것인가라는 질문이 더욱 절박해진다는 사실이에요.

속도보다 방향이, 성능보다 책임이 더 중요해진 시대에, 가장 필요한 역량은 결국 인간다운 판단력이에요. 더 똑똑한 기계가 등장할수록, 우리에게는 그보다 더 깊은 에코 멤버님들의 사회적 지혜가 필요해요.

Cinnamomo di Moscata (글쓴이) 소개

게임 기획자입니다. https://www.instagram.com/cinnamomo_di_moscata/

(1) Christopher McFadden. (2026). Scientists use AI to create ultra-strong, rust-proof steel for 3D-printed parts. Interesting Engineering. https://interestingengineering.com/innovation/ai-creates-rust-proof-steel

(2) OpenAI. (2026). Industrial Policy for the Intelligence Age: Ideas to Keep People First. https://cdn.openai.com/pdf/561e7512-253e-424b-9734-ef4098440601/Industrial%20Policy%20for%20the%20Intelligence%20Age.pdf

(3) Axios. (2026). OpenAI의 경고: 워싱턴은 다가올 일에 대비하지 못하고 있다. YouTube. https://www.youtube.com/watch?v=B21KxGs8zDI

(4) Brendan Bordelon. (2026). Anthropic loses appeals court bid to pause supply chain risk label. Politico. https://www.politico.com/news/2026/04/08/d-c-circuit-rejects-anthropic-plea-to-pause-supply-chain-risk-label-00864880

(5) Antropic. (2026). Project Glasswing. https://www.anthropic.com/glasswing

(6) Antropic. (2026). System Card: Claude Mythos Preview. https://www-cdn.anthropic.com/8b8380204f74670be75e81c820ca8dda846ab289.pdf

(7) Maxwell Zeff, Zoë Schiffer, Lily Hay Newman. (2026). Meta Pauses Work With Mercor After Data Breach Puts AI Industry Secrets at Risk. Wired. https://www.wired.com/story/meta-pauses-work-with-mercor-after-data-breach-puts-ai-industry-secrets-at-risk/

(8) 박찬. (2026). 중국 AI 기업, 오픈소스서 폐쇄형 모델 중심으로 전략 전환. AI타임스. https://www.aitimes.com/news/articleView.html?idxno=208827

(9) arXiv:2604.01363 [cs.AI]

(10) Eleanor Hawkins. (2026). MIT study challenges AI job apocalypse narrative. Axios. https://www.axios.com/2026/04/02/ai-jobs-mit-study-workforce-impact