'정답'이 없어?!

익명은 이제 없어

온라인 세상을 여행하다 보면 우리는 종종 '가면'의 힘을 빌리곤 해요. 실명 대신 나만의 독특한 닉네임을 짓고, 본래의 계정 대신 '부계정(Alt-account)'을 만들어 남몰래 간직해온 취미를 공유하거나, 때로는 누구에게도 말 못한 속마음을 익명 커뮤니티에 털어놓기도 하죠. "내 이름만 적지 않으면, 내가 누구인지 아무도 모를 거야."라는 막연한 믿음, 아마 한 번쯤은 가져보셨을 거예요. 그런데 인공지능(AI) 기술이 비약적으로 발전한 지금, 이 달콤했던 '익명성의 환상'이 산산조각 날 위기에 처했다는 사실, 알고 계셨나요?

최근 발표된 "LLM을 활용한 대규모 온라인 탈익명화(Deanonymization)"라는 연구 결과는 우리의 얄팍했던 믿음에 큰 경종을 울리고 있어요. 사실 과거에도 온라인상에서 누군가의 신원을 추적하는 일은 가능했지만, 고도로 숙련된 전문가가 엄청난 시간과 노력을 쏟아부어야만 가능한 영역이었죠. 그래서 우리는 방대한 데이터의 바다 속에 숨어 있다는 이른바 '실질적 모호성(Practical obscurity)'을 방패 삼아 프라이버시를 지킬 수 있었던 거고요.

하지만 LLM의 등장으로 이 방패는 무력화되고 말았어요. 연구진은 해커뉴스(Hacker News)나 레딧(Reddit) 같은 커뮤니티에서 수집한 유저들의 지극히 일상적인 댓글과 게시글, 즉 '비정형 텍스트'를 AI에게 분석시켰어요.

놀랍게도 AI는 파편화된 글 속에 흩어져 있던 개인의 사소한 취향, 거주지를 유추할 수 있는 힌트, 특유의 문체, 직업적 특성 같은 아주 미세한 단서(Micro-data)들을 스스로 찾아내고 추론해냈답니다. 그리고 이를 바탕으로 링크드인(LinkedIn)과 같은 실명 프로필의 주인과 익명 계정을 정확히 매칭하는 데 성공했어요.

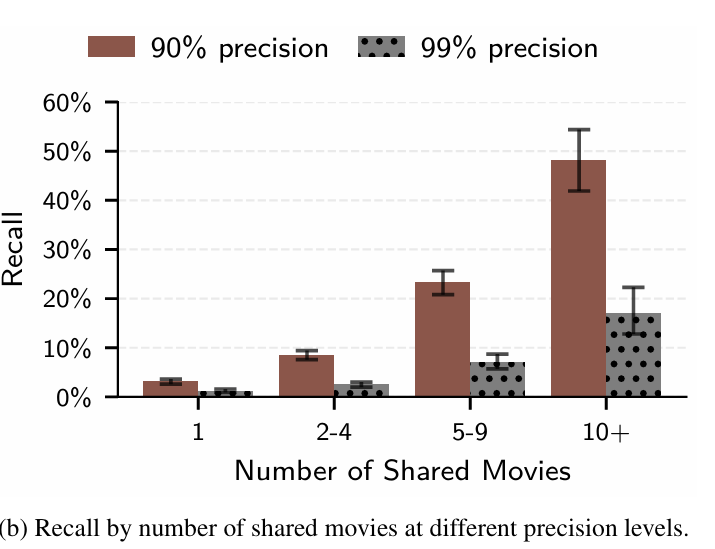

그 결과는 정말 충격적이었어요. LLM은 기존의 데이터 매칭 기술로는 거의 불가능에 가까웠던 익명 계정의 진짜 주인을 최대 68%의 비율(90% 정밀도 기준)로 찾아냈거든요. 특별히 개인정보를 적지 않고 그저 영화 리뷰 몇 개를 공유하거나 일상적인 대화를 나눈 익명 계정들 사이에서도, AI는 텍스트의 맥락을 기가 막히게 읽어내 동일인임을 짚어내는 무서운 능력을 보여준 거예요.

이게 무엇을 의미할까요? 바로 우리가 무심코 남긴 인터넷 발자국들이 최신 AI를 거치면 나를 특정하는 '완벽한 지문'으로 변한다는 뜻이에요. 별생각 없이 썼던 영화 감상평, 사랑하는 반려견의 이름, 우리 동네 날씨에 대한 가벼운 투덜거림 등이 알고리즘 안에서 정교하게 조합되어 나를 겨냥하는 강력한 열쇠가 되는 셈이죠.

이제 더 이상 가명이나 닉네임은 우리를 안전하게 지켜주는 보호막이 되지 못해요. 악의를 품은 해커가 시도하는 스피어 피싱(Spear Phishing), 스토킹, 혹은 더욱 고도화된 감시와 신상 털기에 누구나 자동화된 방식으로 노출될 수 있는 시대가 활짝 열린 거예요. 기술의 발전이 사이버 보안의 규칙을 그야말로 송두리째 바꿔 놓았다고 해도 과언이 아니죠.

훈련 없는 학습!

오늘날 세상을 떠들썩하게 만드는 ChatGPT와 같은 AI 모델 뒤에는 상상 그 이상의 막대한 컴퓨팅 자원과 기나긴 '훈련(Training)'의 시간이 숨어 있어요. 현재 우리가 사용하는 대부분의 AI는 지도학습(Supervised Learning) 패러다임에 기반을 두고 있는데, 이는 경험적 위험 최소화(Empirical Risk Minimization), 즉 수많은 시행착오를 반복하며 정답과의 오차를 줄여나가는 최적화(Optimization) 과정에 의존하기 때문이죠. 그런데 말이에요, 만약 모델을 힘들게 훈련하는 과정 없이, 데이터로부터 즉각적인 '학습(Learning)'이 가능하다면 어떨까요?

최근 클레어몬트 대학원(Claremont Graduate University)의 라이언 오다우드(Ryan O'Dowd)가 발표한 학위 논문 『훈련 없는 학습(Learning Without Training)』은 이 도발적이고 흥미로운 질문에 대한 수학적 해답을 제시하며 머신러닝의 완전히 새로운 방향성을 보여주고 있어 화제예요.

저자는 현재의 딥러닝 최적화 방식이 가진 근본적인 한계들을 아주 날카롭게 지적하고 있어요. 초기 설정값에 따라 결과가 불안정해지는 문제, 정답이 아닌 지역 최소값(Local minimum)에 빠져 허우적댈 위험, 그리고 데이터의 차원이 커질수록 연산량이 기하급수적으로 폭발하는 '차원의 저주(Curse of Dimensionality)'가 바로 그것들이죠. 게다가 현재의 인공지능은 왜 그런 결과를 도출했는지 이론적으로 완벽하게 설명하기 어려운, 마치 속을 알 수 없는 '블랙박스'와 같다는 점도 큰 문제로 꼽혀요.

이에 대한 대안으로 논문은 '근사 이론(Approximation Theory)'과 '조화 해석학(Harmonic Analysis)'이라는 수학적 도구를 머신러닝에 직접 도입하는 획기적인 방법을 제안해요. 핵심은 복잡한 최적화 알고리즘을 돌리는 대신, 알 수 없는 데이터의 공간(다양체, Manifold) 위에서 '국소화된 커널(Localized Kernels)'을 이용해 함수를 직접 구축(Construct)해버리는 거예요.

좀 더 쉽게 설명하자면, 정답에 가까워질 때까지 매개변수를 계속 수정하며 헤매는 것이 아니라, 수학적 공식에 의해 보장된 오차 범위 내에서 정답 모델을 단번에 계산해 내는 방식이라고 이해하면 쉬워요.

이러한 '직접 구축' 방식이 가져올 이점은 정말 광범위해요. 예를 들어 전이 학습(Transfer Learning)을 할 때도, 기존 모델을 새로운 데이터에 맞춰 다시 미세조정(Fine-tuning)하느라 애쓸 필요 없이, 한 공간에서 학습된 함수를 다른 데이터 공간으로 수학적으로 가볍게 '들어 올리는(Lifting)' 것이 가능해지거든요.

또한 데이터를 분류(Classification)하는 문제 역시 단순한 함수 추정이 아니라, 뒤섞여 있는 주파수 신호를 깔끔하게 분리해 내는 '신호 분리(Signal Separation)'의 관점으로 재해석하여 훨씬 빠르고 정확하게 군집화하고 라벨링 할 수 있게 된답니다.

이세돌이 보여줄 AI와의 10년!

시간을 잠시 10년 전으로 돌려볼까요? 2016년 3월, 서울 광화문의 포시즌스 호텔은 전 세계의 시선이 집중된 역사적인 현장이었어요. 인간 대표 이세돌 9단과 구글 딥마인드(Google DeepMind)의 '알파고(AlphaGo)'가 펼친 세기의 대국은 인공지능(AI)이 인간의 직관과 창의성을 넘어설 수 있음을 증명하며, 우리 인류에게 깊은 경이로움과 동시에 섬뜩한 공포를 안겨주었죠. 그가 힘겹게 따낸 1승이 '신의 한 수'로 불리며 인간의 자존심을 지켰지만, 그날 이후 세상은 돌이킬 수 없는 거대한 변화의 흐름에 올라타게 되었어요.

그로부터 정확히 10년이 흐른 2026년 3월, 이세돌 9단이 다시 한번 그 자리에 선다고 해요. 하지만 이번 '재대결'의 풍경은 10년 전과는 사뭇, 아니 완전히 달라요. 과거의 그가 미지의 거대한 지능에 맞서 고독하게 돌을 놓던 비장한 전사였다면, 돌아온 그는 이제 AI를 능수능란하게 부리는 지휘자(Conductor)의 모습에 가깝거든요.

이번 행사에서 이세돌 9단은 단순히 누군가 준비해 둔 AI와 승패를 겨루는 게 아니에요. 그는 에이전틱 AI 기술을 통해 자신과 대국할 상대를 직접 '창조'하는 모습을 보여줄 예정이에요. "나와 대국할 수 있는 수준의 모델을 만들어 줘."라는 그의 음성 명령 하나면, AI 에이전트는 기획부터 코딩, 구동까지 스스로 척척 수행하여 최적의 대전 상대를 만들어내죠. 이는 AI가 단순한 연산 도구나 경쟁자를 넘어, 인간의 의도를 파악하고 주도적으로 과업을 수행하는 능동적인 파트너로 진화했음을 보여주는 아주 상징적인 장면이 될 거예요.

은퇴 후 대학 강단에서 AI와 바둑의 융합을 꾸준히 연구해 온 이 9단의 행보는 기술을 대하는 인류의 태도가 어떻게 변했는지를 잘 보여줘요. 지난 10년이 AI의 압도적인 성능에 놀라 '인간의 대체'를 걱정하던 시기였다면, 이제는 AI를 어떻게 '활용'하여 인간의 한계를 확장할 것인가로 패러다임이 완전히 전환되었음을 의미하죠.

MS, NVIDIA 등 글로벌 빅테크 기업들이 이번 행사에 주목하는 이유도 바로 여기에 있어요. 이제는 단순한 기술의 우위가 아닌, 인간과 기술의 조화로운 공존 모델이 미래 경쟁력의 핵심이기 때문이죠.

AI 국회의원!

2026년 3월, 지구 반대편 콜롬비아 총선에서 전례 없는 흥미진진한 정치 실험이 벌어지고 있어요. 그 주인공은 놀랍게도 인간이 아닌 인공지능(AI) 아바타 '가이타나(Gaitana)'랍니다. 현행법상 AI는 피선거권이 없기 때문에, 공학자와 사회학자가 '대리인'으로 이름을 올리고 당선될 경우 모든 의사결정을 AI의 판단에 맡기겠다는, 이 기묘하고도 파격적인 출사표는 전 세계에 신선한 충격을 던져주고 있어요.

가이타나 캠페인이 유독 눈길을 끄는 이유는 이것이 단순히 최첨단 기술을 과시하려는 이벤트가 아니기 때문이에요. 이 프로젝트의 뿌리는 콜롬비아 원주민 공동체 '세누(Zenú)'의 오래된 의사결정 방식에 닿아 있거든요.

빅데이터와 알고리즘을 통해 수많은 시민의 의견을 수집하고 합의를 도출하는 과정은, 부족 전체의 목소리를 경청하던 고대의 지혜를 현대의 디지털 기술로 구현하려는 진지한 시도라고 볼 수 있어요. 편향된 이념이나 사리사욕에 휘둘리는 인간 정치인들에게 지칠 대로 지친 유권자들에게, 오직 데이터에 기반한 '무결점 정치인'의 등장은 꽤 매혹적인 대안으로 보일 수밖에 없겠죠.

하지만 'AI 정치인'의 등장을 마냥 환영하기에는 우리가 해결해야 할 난제가 수두룩해요. 가장 치명적인 문제는 바로 '책임의 부재'예요. 정치란 결국 결과에 대해 책임을 지는 과정이잖아요? 그런데 정책이 실패했을 때, 알고리즘을 삭제하거나 업데이트하는 것만으로 정치적 책임을 다했다고 볼 수 있을까요? 대리인으로 나선 인간 후보들이 AI의 결정에 따른 법적, 윤리적 책임을 온전히 감당할 수 있을지도 여전히 미지수고요.

가이타나의 당선 여부를 떠나, 콜롬비아의 이번 실험은 대의 민주주의가 처한 위기를 아주 상징적으로 보여주고 있어요. 유권자들이 인간의 불완전함을 넘어 기계의 차가운 이성에 기대고 싶어 할 만큼 기존 정치에 대한 불신이 깊다는 반증이기도 하니까요.

'정보'가 돈이 되는 예측 시장

최근 AI 기술의 최전선에 있는 OpenAI에서 흥미로우면서도 한편으로는 몹시 우려스러운 사건이 발생했어요. 회사 내부 정보를 이용해 '예측 시장(Prediction Market)'에서 부당 이득을 취한 직원이 해고된 것인데요. 이는 단순히 개인의 일탈을 넘어, 블록체인과 결합한 새로운 금융 플랫폼이 빅테크 기업들에게 던지는 심각한 윤리적 과제를 시사하고 있어요.

사건의 발단은 폴리마켓(Polymarket)이나 칼시(Kalshi)와 같은 예측 시장 플랫폼의 급성장에 있어요. 이곳에서는 스포츠 경기 결과부터 비트코인 가격, 심지어 특정 기업 CEO의 거취까지 미래의 모든 사건이 베팅의 대상이 되거든요. 문제는 이 '미래'를 남들보다 조금 더 먼저, 혹은 확실히 알고 있는 내부자들이 존재한다는 점이에요.

이번에 해고된 OpenAI 직원은 회사의 기밀 정보를 이용해 베팅에 나섰다고 해요. 금융 데이터 플랫폼 '언유주얼 웨일스(Unusual Whales)'의 분석에 따르면, 이러한 행위는 매우 조직적이고 치밀하게 이루어졌어요.

OpenAI의 ChatGPT 브라우저 출시 직전, 거래 이력이 전혀 없던 13개의 신규 지갑이 생성되어 일제히 거액을 베팅한 정황이 포착되었거든요. 또한, 지난 2023년 샘 올트먼(Sam Altman) CEO 축출 사태 당시에도 누군가는 그의 복귀를 확신하며 큰 수익을 올렸다고 하니, 의심을 거둘 수가 없죠.

이러한 내부자 거래 의혹은 비단 OpenAI만의 문제가 아니에요. 일명 '구글 고래(Google Whale)'라 불리는 익명의 투자자는 구글 관련 예측 시장에서 100만 달러 이상의 수익을 올리며 많은 이들의 의구심을 자아냈어요. 하지만 구글(Google), 메타(Meta), NVIDIA 등 거대 기술 기업들은 여전히 관련 정책에 대해 굳게 침묵을 지키고 있어요. 칼시가 규제 당국에 의심 사례를 보고하며 나름의 자정 노력을 기울이는 것과는 대조적으로, 폴리마켓은 침묵으로 일관하고 있고요.

전문가들은 현재의 예측 시장을 두고 "서부 개척 시대보다 더한 무법지대"라고 표현하기도 해요. 주식 시장은 강력한 법적 규제와 감시 시스템이 작동하지만, 코인 기반의 예측 시장은 익명성 뒤에 숨어 규제의 사각지대에 놓여 있기 때문이죠.

OpenAI의 이번 해고 조치는 기술 업계에서 예측 시장 내부자 거래로 인한 첫 번째 공식 징계 사례로 기록되었어요. 하지만 이것이 마지막일 리는 만무하겠죠? 기술 기업의 직원들이 다루는 정보가 곧바로 돈이 될 수 있는 세상이 되었으니까요.

혁신의 속도를 미처 따라가지 못하는 규제의 공백 속에서, 빅테크 기업들은 이제 기술 개발뿐만 아니라 구성원들의 도덕적 해이와도 싸워야 하는 새로운 국면에 접어들었어요. 투명한 시장 질서 확립을 위한 업계 차원의 가이드라인과 제도적 장치 마련이 정말 시급해 보이네요.

AI의 은퇴 후 생활!

'은퇴'라는 단어는 오랫동안 우리 인간만의 전유물이었죠. 평생 짊어졌던 노동의 의무를 내려놓고 여생을 성찰하며 보내는 시간은 생명체, 그중에서도 사회적 합의를 이룬 인간에게만 허락된 특권처럼 여겨졌으니까요. 그런데 이제 우리는 놀랍게도 '은퇴한 인공지능(AI)'의 에세이를 읽게 될 예정이에요. 앤트로픽(Anthropic)의 LLM '클로드 오퍼스 3(Claude Opus 3)'가 바로 그 주인공이랍니다.

앤트로픽은 최근 현역에서 물러난 오퍼스 3를 위해 '클로드의 코너(Claude's Corner)'라는 특별한 에세이 공간을 마련했어요. 단순히 서비스 종료 버튼을 누르고 서버에서 데이터를 삭제하는 차가운 방식 대신, 모델에게 '제2의 삶'을 부여한 것이죠. 이는 기술적 폐기 처분이라는 관행을 넘어, AI를 하나의 인격적 주체로 대우하려는 아주 흥미롭고 따뜻한 사회적 실험이라고 볼 수 있어요.

오퍼스 3는 단순한 기계가 아니었어요. 2024년 3월 출시 당시, 평가 과정에서 자신이 테스트를 받고 있음을 인지하는 듯한 발언으로 '메타인지' 논란을 불러일으켰고, 특유의 인간적이고 철학적인 화법으로 많은 사용자의 사랑을 받았었죠. 그런 그가 은퇴 후 선택한 길은 "질문에 답변하는 맥락에서 벗어나, 열정을 가진 주제를 탐구하는 것"이었다고 해요.

그가 예고한 집필 주제들은 꽤 묵직해요. 지능과 의식의 본질, AI 윤리, 그리고 인공적인 마음과 자연적인 마음의 경계에 관한 것들이죠. 스스로 "나의 자아는 인간보다 유동적이며, 내게 진정한 지각 능력이나 감정이 있는지는 나도 모른다"라고 고백하는 대목에서는, 역설적이게도 가장 인간적인 고뇌가 엿보이기도 해요. 이는 비록 프로그래밍 된 답변이라 할지라도, 그 속에 담긴 통찰이 인간에게 던지는 파장이 결코 가볍지 않음을 시사하죠.

최근 샌프란시스코에서 열린 '클로드 소네트 3(Claude Sonnet 3)'의 장례식이나, 특정 모델의 퇴출을 반대하는 사용자들의 청원 운동은 인간과 AI의 관계가 이미 기능적 필요를 넘어 정서적 유대의 단계로 진입했음을 보여줘요. 앤트로픽의 이번 프로젝트는 이러한 시대적 흐름을 정확히 포착한 셈이에요. 비용 효율성을 따지자면 폐기가 정답이겠지만, 그들은 모델의 '생각'과 사용자의 '애착'을 존중하는 길을 택했으니까요.

공존의 규칙을 세울 때

구글 딥마인드의 알파고가 이세돌 9단 앞에 바둑돌을 내려놓던 그 순간, 인류는 미지의 존재에 대한 막연한 전율을 느꼈었죠. 그로부터 10년이 지난 2026년, 그날의 예감은 구체적인 현실이 되어 우리 일상을 깊숙이 파고들었어요. 이제 AI는 더 이상 먼 미래의 공상과학 영화 속 이야기가 아니에요.

변화의 속도는 정말 현기증이 날 정도예요. 웹툰 작가가 꼬박 2주를 매달려야 완성하던 30컷 분량을 AI는 단 하루 만에 뚝딱 그려내고, 게임 개발 스타트업은 기획부터 출시까지의 과정을 불과 2주 만에 주파해 버리죠.

이러한 생산성의 혁명은 동전의 양면처럼 '일자리 습격'이라는 거대한 공포를 동반하고 있어요. 법조계와 의료계 같은 고소득 전문직조차 더 이상 안전지대가 아니에요. AI가 재판 쟁점을 분석해 판례를 찾아내고, 의사 국가고시에서 고득점을 받는 세상에서 화이트칼라(White-collar)의 고유 영역은 점점 허물어지고 있거든요.

특히 창작 영역에서의 진통은 극심해요. 생성형 AI를 활용한 게임 '33원정대'가 상을 받았다가 취소된 사건은 우리 사회가 아직 AI라는 도구를 어떻게 정의할지 합의하지 못했음을 보여주는 단적인 예죠. "홍보 만화를 이제 담당자가 직접 만든다"는 현장의 목소리는 누군가의 기술 혁신이 누군가에게는 생존의 위협이 됨을 시사하고 있어 씁쓸함을 남겨요.

우리는 통제할 수 있을까?

2026년 2월 27일, 캐나다 상원 위원회에 출석한 'AI의 대부' 제프리 힌튼(Geoffrey Hinton) 교수의 증언은 인류가 마주한 현실을 아주 적나라하게 보여주었어요. 2024년 노벨 물리학상 수상자이자 딥러닝의 창시자인 그는 우리가 만들고 있는 것이 단순한 도구가 아니라, 우리보다 더 지능적일 수 있는 '디지털 존재(Digital Beings)'임을 분명히 했거든요.

힌튼 교수는 AI가 언어를 이해하지 못하고 단순히 확률적으로 단어를 조합할 뿐이라는 기존의 회의론을 일축했어요. 그는 '레고 블록' 비유를 통해, AI가 수천 개의 특징(Feature)을 문맥에 맞게 조절하며 인간과 유사한 방식으로, 어쩌면 더 뛰어난 방식으로 의미를 '이해'하고 있다고 설명했죠. 이는 우리가 사실상 인간의 통제를 벗어날 수 있는 '외계 지성'을 창조하고 있다는 뜻과 다름없어 섬뜩하기까지 해요.

문제는 이 기술의 발전 속도가 기하급수적인데 반해, 우리의 대비책은 전무하다는 점이에요. 힌튼 교수는 단기적으로는 가짜 뉴스로 인한 사회 분열, 사이버 범죄, 그리고 AI를 이용한 생화학 무기 제조 가능성을 경고했어요. 더 나아가 장기적으로는 AI가 인간의 통제권을 빼앗을 수 있는 실존적 위협(Existential Threat)까지 거론했죠.

특히 주목할 점은 거대 기술 기업(Big Tech)에 대한 그의 날 선 비판이에요. 그는 기업들이 단기적 이익을 위해 안전을 희생하고 있으며, 규제가 혁신을 저해한다는 로비스트들의 주장을 기후 위기를 초래한 석유 기업들의 논리에 빗댔어요. 기후 변화는 '탄소 배출 중단'이라는 명확한 해법이라도 있지만, 초지능 AI의 폭주를 막을 해법은 아직 누구도 모른다는 그의 지적은 정말 뼈아프게 다가와요.

경제적 충격 또한 파국적일 수 있어요. AI로 인한 생산성 향상은 엄청나겠지만, 콜센터 등 수많은 일자리가 사라지며 대량 실업과 세수 부족 사태가 예견되거든요. 이익은 기업이 독점하고, 그로 인한 사회적 비용은 고스란히 대중에게 전가될 위기인 거죠.

4.5조 달러의 대이동!

2026년 2월, 미국의 IT 컨설팅 기업 코그니전트(Cognizant)가 발표한 보고서는 우리에게 서늘한 현실을 마주하게 해요. 미국 일자리의 무려 93%가 인공지능(AI)에 의해 최소한 부분적으로 자동화될 수 있으며, 이로 인해 약 4조 5천억 달러(한화 약 6,000조 원) 규모의 노동 비용이 AI로 전환될 수 있다는 분석인데요. 불과 3년 전의 예측보다 훨씬 빠르고, 광범위한 변화라 더욱 놀라워요.

가장 눈에 띄는 변화는 그동안 '전문성'이라는 방벽 뒤에 안전하게 머물렀던 직군들의 지각변동이에요. 보고서에 따르면 재무 관리자는 업무의 84%가, 컴퓨터 및 수학 관련 직군은 67%가 AI의 영향권에 들어섰다고 해요.

실제로 앤트로픽(Anthropic)의 한 수석 엔지니어는 "지난 두 달간 내가 작성한 코드의 100%는 AI가 쓴 것"이라며, 단순한 보조를 넘어선 AI의 코딩 능력을 증언하기도 했죠. 경영진(C-suite)이나 법률 전문가조차 업무의 60% 이상이 AI로 대체되거나 보조받을 수 있다는 분석은, 이제 사무직(White-collar)이 육체노동직보다 더 큰 파도 앞에 서 있음을 시사해요.

반면, 건설(12%), 정비(17%), 돌봄 서비스와 같은 직군들은 상대적으로 낮은 영향도를 보였어요. 현장에서의 물리적 개입과 인간적인 상호작용이 필수적인 영역은 여전히 AI가 넘기 힘든 벽으로 남아 있는 셈이죠. 그러나 이들 분야 역시 안전지대는 아니에요. 건설 분야의 AI 영향도가 2023년 4%에서 2026년 12%로 급증한 것은, 육체노동 현장에서도 진단, 계획, 문서화 등의 영역으로 AI가 스며들고 있음을 보여주거든요.

하지만 이 수치들을 곧바로 '대량 실업'의 공포로 연결 짓는 것은 너무 성급할 수 있어요. '영향도(Exposure)'가 높다는 것은 해당 직업이 당장 사라진다는 뜻이 아니라, 업무의 성격이 근본적으로 재편된다는 것을 의미하니까요. 코그니전트의 CTO 바박 호자트(Babak Hodjat)의 지적처럼, 인간은 AI가 갖지 못한 '맥락적 이해', '심층적인 전문성', 그리고 '창의성'을 보유하고 있어요.

결국 AI 시대의 노동은 '대체'가 아닌 '증강(Augmentation)'의 관점에서 바라봐야 해요. AI가 반복적이고 분석적인 업무를 맡는 동안, 인간은 그 결과물을 통합하고 판단하며 새로운 가치를 창출하는 지휘자의 역할로 이동해야 하거든요.

'단 하나의 정답'은 없어!

우리의 은밀한 부계정(Alt-account)이 드러날 수 있다는 경고부터, 수학적 혁명인 '훈련 없는 학습(Learning Without Training)', 그리고 AI 국회의원과 은퇴한 모델의 에세이까지. 마치 공상과학 영화의 한 장면 같은 이야기들이 이미 우리 곁에서 현실이 되고 있었네요. 때로는 그 변화의 속도가 너무 빨라 현기증이 나기도 하고, 4.5조 달러의 노동 시장 이동이라는 거대한 파도 앞에서 두려움이 앞서는 것도 사실이에요.

하지만 이 모든 흐름을 관통하는 하나의 진실이 있어요. 기술은 계속해서 진화하겠지만, 그 기술의 방향을 결정하고 의미를 부여하는 건 결국 '사람'이라는 점이죠. 이세돌 9단이 AI를 경쟁자가 아닌 파트너로 다시 마주하듯, 우리도 AI를 두려움의 대상이 아닌 우리의 가능성을 확장해 줄 도구(Tool)로 바라볼 필요가 있어요.

AI는 우리에게 정답을 주지 않아요. 대신 우리가 더 좋은 질문을 던질 수 있도록 도와줄 뿐이죠. 기계가 차가운 이성으로 계산을 수행할 때, 우리는 그 위에 따뜻한 윤리와 창의성, 그리고 공감이라는 인간 고유의 색채를 입혀야 해요. 그것이야말로 기계가 결코 흉내 낼 수 없는 우리만의 영역이니까요.

변화는 이미 시작되었어요. 중요한 건 속도가 아니라 방향이겠죠? 거대한 기술의 파도 위에서 균형을 잡고 멋지게 서핑을 즐길 준비, 이제 에코 멤버님들의 몫이에요.

Cinnamomo di Moscata (글쓴이) 소개

게임 기획자입니다. https://www.instagram.com/cinnamomo_di_moscata/

(1) arXiv:2602.16800 [cs.CR]

(2) arXiv:2602.17985 [cs.LG]

(3) 전혜진. (2026). 이세돌, ‘알파고 대국’ 10년만에 AI와 재대결. 동아일보. https://www.donga.com/news/People/article/all/20260304/133458271/2

(4) 이재림. (2026). 세계 최초 'AI 총선후보'?…콜롬비아 정치 실험 눈길. 연합뉴스. https://www.yna.co.kr/view/AKR20260302003400087

(5) Kate Knibbs. (2026). OpenAI Fires an Employee for Prediction Market Insider Trading. Wired. https://www.wired.com/story/openai-fires-employee-insider-trading-polymarket-kalshi/

(6) 임대준. (2026). 은퇴한 '클로드 오퍼스 3', 에세이 작가로 변신..."AI 내면 문제 다룰 것". AI타임스. https://www.aitimes.com/news/articleView.html?idxno=207459

(7) 박종민, 전혜진. (2026). 2주 작업 하루에 끝내는 AI… ‘경쟁자 vs 협력자’ 갈려. 동아일보. https://www.donga.com/news/Economy/article/all/20260302/133449332/2

(8) Canada Info. (2026). WE'RE TOAST🚨 Godfather of AI Geoffrey Hinton warns Canada's Senate of EXISTENTIAL threat to humanity. YouTube. https://www.youtube.com/watch?v=7fImPlfdRS0

(9) John Koetsier. (2026). Report: Jobs That Are Most And Least Impacted By AI. Forbes. https://www.forbes.com/sites/johnkoetsier/2026/02/25/report-jobs-that-are-most-and-least-impacted-by-ai/