생각하는 기계와 인간의 자리

AI의 머릿속에는 '작은 사회'

요즘 AI 업계에서 가장 뜨거운 감자는 단연 딥시크(DeepSeek-R1)나 OpenAI의 o1과 같은 '추론형 모델(Reasoning Models)'의 약진이에요. 이 새로운 모델들은 기존의 AI가 어려워했던 난해한 수학 문제나 복잡한 코딩 과제에서 놀라울 정도로 압도적인 성능을 보여주고 있거든요. 그 비결이 무엇인지 아시나요? 바로 답변을 내놓기 전에 마치 사람이 곰곰이 생각하듯, 스스로 추론의 과정을 길게 이어가는 '생각의 사슬(Chain of Thought)' 기술 덕분이에요.

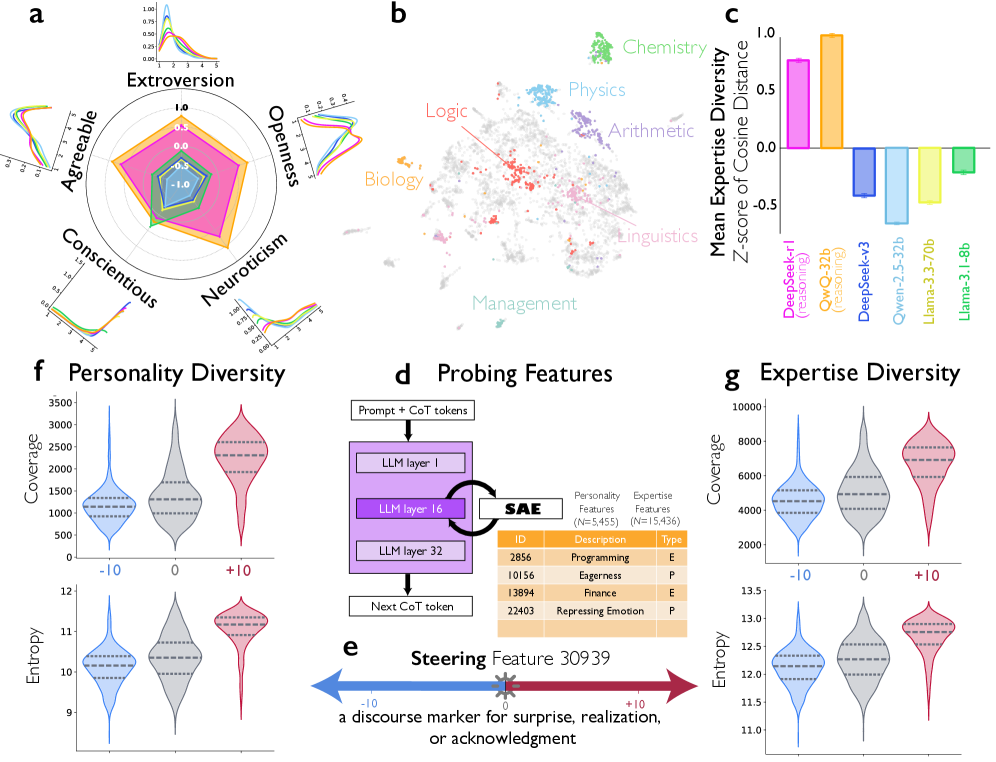

그런데 최근 구글(Google)과 시카고대(University of Chicago) 연구진이 발표한 「추론 모델은 생각의 사회를 형성한다(Reasoning Models Generate Societies of Thought)」라는 논문이 우리에게 아주 흥미롭고도 신선한 충격을 주고 있어요. 이 논문은 AI의 추론 능력이 향상되는 과정이 단순히 계산 속도가 빨라지거나 연산 시간이 늘어난 결과가 아니라고 말해요. 놀랍게도 모델 내부에서 시뮬레이션된 다중 인격 간의 복잡하고 치열한 '사회적 상호작용'이 바로 그 비결이라는 사실이 밝혀졌기 때문이에요.

연구진은 이 독특한 현상을 '생각의 사회(Society of Thought)'라고 이름 붙였어요. 딥시크(DeepSeek-R1)나 QwQ-32B 같은 고성능 추론 모델의 내면을 들여다보니, 그곳에는 기계적인 정적만이 흐르는 것이 아니라 시끌벅적한 토론장이 펼쳐져 있었던 거죠.

모델은 스스로 끊임없이 질문을 던지고 답을 찾아가며, 관점을 수시로 바꾸기도 하고, 때로는 자신의 이전 주장에 대해 매섭게 반박하며 갈등을 빚다가 다시 화해(reconciliation)하는 과정을 거치고 있었어요. 마치 꼼꼼하게 오류를 찾아내는 까칠한 '비평가', 기상천외한 아이디어를 던지는 '발상가', 그리고 이들의 의견을 조율하는 차분한 '중재자' 등 다양한 페르소나(persona)들이 머릿속 회의실에 모여 밤새워 난상토론을 벌이는 모습과 너무나 흡사하지 않나요?

더욱 흥미로운 점은 이러한 모델의 대화적 특성을 인위적으로 강화(steering)했을 때, 추론의 정확도가 극적으로 상승했다는 사실이에요. 그런데 여기서 우리가 주목해야 할 가장 놀라운 지점은 따로 있어요. 바로 이러한 사회적 행동이 개발자가 처음부터 의도적으로 설계하거나 지시한 것이 아니라는 점이에요. 단지 정답을 맞혔을 때 보상을 주는 강화학습(Reinforcement Learning) 과정에서 모델이 '자발적으로' 이러한 능력을 진화시켰다는 것이죠.

즉, AI는 혼자서 직선적으로 빠르게 생각하는 것보다, 내면에 다양한 자아를 만들어 서로 비판하고 검증하게 하는 것이 정답에 도달하는 데 훨씬 유리하다는 것을 스스로 터득한 셈이에요. 실제로 대화형 구조로 미세 조정(fine-tuning)된 모델은 혼자 생각하는 독백형 모델보다 훨씬 빠르게 학습하고 더 높은 성과를 냈다고 해요.

결국 뛰어난 지능과 추론 능력은 고독한 천재의 번뜩이는 직관에서 나오는 것이 아니라, 치열한 논쟁과 합의를 거치는 '내면의 팀워크'에서 나온다는 것을 AI가 스스로 증명하고 있는 셈이죠.

빅테크의 교묘한 ‘두뇌 사냥’

실리콘밸리(Silicon Valley)의 인수합병(M&A) 방정식이 묘하게 변하고 있어요. 과거에는 유망한 스타트업이 등장하면 거액을 들여 회사를 통째로 사들이는 것이 성공의 공식이었죠.

하지만 최근 빅테크(Big Tech) 기업들은 회사의 간판은 그대로 둔 채, 알맹이인 핵심 엔지니어와 지식재산권(IP)만 쏙 빼가는 기이한 형태의 거래를 선호하고 있어요. 업계에서는 이를 두고 인재 인수, 즉 ‘애크하이어(Acqui-hire)’라고 부른답니다.

이러한 흐름 속에서 최근 미국 연방거래위원회(FTC)가 제동을 걸고 나선 것은 어찌 보면 당연한 수순으로 보여요. 앤드루 퍼거슨(Andrew Ferguson) FTC 위원장은 엔비디아(NVIDIA)가 반도체 스타트업 그로크(Groq)의 인력을 대거 흡수한 사례 등을 콕 집어 지목하며, 이것이 반독점 심사를 회피하기 위한 우회로인지 철저히 조사하겠다고 으름장을 놓았거든요.

MS나 아마존(Amazon)이 보여준 최근 행보 역시 이와 다르지 않아요. 기업 결합 신고라는 복잡하고 까다로운 정문을 통과하는 대신, ‘채용’과 ‘제휴’라는 그럴싸한 명분을 내세워 규제의 레이더망을 유유히 빠져나가는 뒷문을 선택한 것이죠.

재미있는 점은 현재 규제 당국이 이러한 현상의 원인을 전임 바이든(Biden) 행정부의 ‘과도한 규제’ 탓으로 돌린다는 거예요. 규제 당국이 정문을 쇠사슬로 꽁꽁 묶어버리니, 기업들이 살길을 찾아 담장을 넘어 뒷문으로 드나들게 되었다는 논리인 셈이죠.

그러나 원인이 무엇이든 간에, 결과적으로 빅테크 기업들이 잠재적 경쟁자의 성장을 싹부터 자르고 AI 기술 패권을 독식하는 구조가 강화되고 있다는 사실은 부인하기 어려워요. 스타트업은 껍데기만 남아 고사(枯死)하고, 혁신의 생태계는 거대 기업 위주로만 재편되는 ‘기울어진 운동장’이 되고 있는 거예요.

FTC의 칼끝은 단순히 시장 독점 문제에만 머물지 않아요. 다가오는 5월부터 시행될 ‘테이크 잇 다운 법(Take It Down Act)’은 AI 기술이 초래한 심각한 사회적 부작용, 특히 딥페이크(Deepfake) 성 착취물에 대해 강력한 법 집행을 예고하고 있거든요. 이는 미국 정부가 빅테크 기업들을 향해 ‘공정한 경쟁’과 ‘사회적 책임’이라는 두 가지 무거운 숙제를 동시에 던진 것으로 해석될 수 있어요.

기술의 발전 속도만큼이나 독점을 위한 기업들의 기술도 날로 진화하고 있어요. ‘혁신을 위한 협력’이라는 매력적인 포장지로 경쟁자 제거라는 차가운 본질을 감추는 행위는 이제 더 이상 통용되기 어려울 전망이에요.

진흙탕 싸움으로 변한 비전

2026년 4월, 실리콘밸리 역사상 가장 많은 이목이 쏠리는 재판이 열릴 예정이에요. 바로 OpenAI와 일론 머스크(Elon Musk)의 법정 공방이죠. 한때는 인류를 위한 안전한 AI를 꿈꾸며 의기투합했던 동지들이, 이제는 서로의 목을 겨누는 적이 되어 법정에서 마주하게 된 거예요. 그러나 재판이 시작되기도 전에 들려오는 소식들은 이 세기의 대결이 고상한 철학적 논쟁보다는, 감정적인 비난이 오가는 '진흙탕 싸움'으로 변질되고 있음을 보여줘 씁쓸함을 남겨요.

최근 OpenAI가 투자자들에게 보낸 서한을 보면 이 싸움의 성격이 단적으로 드러나요. 그들은 머스크가 재판 과정에서 "의도적으로 기이하고 관심을 끄는 황당한 주장"을 펼칠 것이라며 미리 '예방주사'를 놓았어요. 기업 가치가 무려 5,000억 달러(약 700조 원)에 육박하는 거대 기업이 소송 리스크를 관리하려는 모습은 충분히 이해가 가지만, 한때 창업 동지였던 인물을 '괴롭힘 전술을 쓰는 사람'으로 규정하는 태도에는 날이 바짝 서 있거든요.

법원의 판단을 살펴보면 머스크의 주장도 아주 허무맹랑해 보이지는 않아요. 캘리포니아(California) 법원은 머스크가 제기한 '사기 혐의'를 기각하지 않았거든요. 비영리를 표방하며 거액의 기부금을 받아놓고는 내부적으로 영리 법인 전환을 모의했다는 정황이 담긴 이메일들이 그 근거가 되었어요. 특히 "비영리에 헌신한다고 말하고 싶지 않다"는 그렉 브록먼(Greg Brockman)의 과거 메모는 OpenAI가 가진 '원죄'를 건드리는 뼈아픈 지점이기도 해요.

무엇보다 가장 우려스러운 대목은 최근 SNS를 통해 벌어진 두 CEO의 원색적인 비난전이에요. 머스크는 챗GPT(ChatGPT)가 사용자의 자살을 유도했다며 "사악하다"고 비난의 수위를 높였고, 이에 질세라 샘 알트먼(Sam Altman)은 테슬라(Tesla)의 오토파일럿(Autopilot) 사고로 "50명 이상이 죽었다"고 맞받아쳤어요.

AI의 안전과 윤리를 논해야 할 글로벌 리더들이, 서로의 기술이 얼마나 더 많은 사람을 죽였는지 숫자를 세며 공격하는 모습은 참담하기 그지없어요. 기술의 불완전성을 인정하고 개선하려는 자세가 아니라, 상대의 약점을 후벼 파서 자신의 정당성을 확보하려는 저열한 태도로 보일 수 있거든요.

이번 소송은 겉으로는 3,800만 달러의 기부금이나 지적 재산권을 둘러싼 다툼처럼 보여요. 하지만 그 이면에는 AI 패권 경쟁과 개인의 자존심이 복잡하게 얽혀 있어요. 4월의 재판장은 화려한 법리 논쟁 대신 폭로와 비방이 난무하는 난장판이 될 가능성이 높아 보여요.

AI에게 '6개월'이란 시간의 의미

2026년 1월, 스위스 다보스(Davos)에서 열린 세계경제포럼(WEF)에서 구글 딥마인드(Google DeepMind)의 데미스 하사비스(Demis Hassabis) CEO는 아주 의미심장한 화두를 던졌어요. 중국의 AI 기술이 서방의 선도 기업들에 비해 여전히 "6개월 정도 뒤쳐져 있다"는 것이었죠.

불과 1년 전, 중국의 스타트업 딥시크(DeepSeek)가 추론 모델 'R1'을 공개하며 실리콘밸리를 충격에 빠뜨렸던 것을 기억하시나요? 미국의 강력한 반도체 제재라는 악조건 속에서도 저비용 고효율 모델을 만들어낸 중국의 저력에 전 세계가 놀랐었죠.

하지만 하사비스는 이를 두고 "거대한 과잉 반응(Massive overreaction)"이라며 일축했어요. 중국 기업들이 이미 개척된 길을 따라잡는 능력은 탁월할지 몰라도, 아직 기술의 '프런티어(Frontier)', 즉 미지의 영역을 스스로 혁신해서 보여주지는 못했다는 냉철한 평가를 내린 거예요.

하지만 하사비스의 발언에서 우리가 진짜 주목해야 할 숫자는 비단 중국과의 격차뿐만이 아니에요. 최근 업계의 분석에 따르면, 주요 AI 연구소들은 대중에게 공개하는 기술보다 내부적으로 약 4~5개월 앞선 모델을 이미 보유하고 있다고 해요.

즉, 우리가 오늘 스마트폰이나 PC를 통해 만나는 최첨단 AI는, 연구소 내부 기준으로는 이미 '과거의 유산'일 수 있다는 뜻이죠. 일각에서는 그들이 이미 범용AI(AGI)에 근접했을 것이라는 조심스러운 추측까지 내놓고 있어요.

그렇다면 왜 이토록 압도적인 기술들은 즉각 세상에 나오지 않는 걸까요? 그 답은 '소프트웨어'가 아닌 '하드웨어'와 '에너지'에 있어요. 현재 빅테크 기업들이 모델 공개보다 데이터센터(data center) 확장과 전력 에너지 확보에 사활을 거는 이유가 바로 여기에 있거든요. 압도적인 지능을 구동할 물리적 기반이 소프트웨어의 발전 속도를 따라가지 못하고 있는 형국인 셈이에요.

이러한 상황에서 도널드 트럼프(Donald Trump) 행정부의 대중국 AI 칩 수출 규제 완화 움직임은 전장에 새로운 변수로 떠올랐어요. 엔비디아(NVIDIA) 같은 칩 제조사들은 환영하는 분위기지만, 경쟁사인 앤스로픽(Anthropic)의 다리오 아모데이(Dario Amodei) CEO가 이를 "북한에 핵무기를 파는 격"이라며 격렬히 비난한 것은 시사하는 바가 커요.

지난 12월 구글의 신규 모델 공개 직후 OpenAI가 내부적으로 '코드 레드(Code Red)'를 발령했을 만큼 서방 내부의 경쟁도 치열해요. 하사비스는 이제 다음 단계로 '로봇 공학(Robotics)'을 지목했어요. 화면 속의 두뇌 싸움을 넘어, 현실 세계와 직접 상호작용하는 '물리적 지능'이 차기 전장이 될 것임을 예고한 셈이죠.

‘AGI의 그 다음 날’은 이미 시작되었다

다시 다보스(Davos) 포럼 이야기로 돌아가 볼까요? 2026년 1월, 세계경제포럼의 한 세션에 전 세계의 이목이 쏠렸어요. ‘AGI(AI)의 그 다음 날(The Day After AGI)’이라는 다소 도발적인 주제 아래, 현재 AI 업계를 양분하고 있는 두 거인, 구글 딥마인드의 데미스 하사비스와 앤스로픽의 다리오 아모데이가 마주 앉았기 때문이에요. 이들의 대담은 단순한 기술 예측을 넘어, 인류가 마주한 거대한 변화의 변곡점을 시사하고 있었죠.

가장 충격적인 화두는 단연 AGI의 도래 시점과 ‘자기 개선 루프(Self-improvement loop)’였어요. 아모데이 CEO는 노벨상 수상자 수준의 능력을 갖춘 AI 모델의 등장이 멀지 않았음을 시사했어요. 그는 AI가 스스로 코딩을 하고, 그 결과물로 더 나은 차세대 모델을 만들어내는 연구 가속화 과정이 이미 시작되었음을 강조했죠.

불과 6-12개월 내에 소프트웨어 엔지니어 업무의 대부분을 AI가 수행할 수 있다는 그의 전망은 어딘가 섬뜩하기까지 해요. 하사비스 역시 2030년이라는 보수적 타임라인을 유지하면서도, 코딩과 수학 분야에서의 진전은 놀라울 정도로 빠르다는 점에 동의했거든요.

이러한 기술적 특이점(Singularity)은 노동 시장에 즉각적인 파장을 예고하고 있어요. 두 리더 모두 엔트리 레벨(entry-level), 즉 초급 화이트칼라 일자리의 위기를 경고했거든요. 하사비스는 이미 주니어급 채용 시장에서 둔화 조짐이 보인다고 인정했고, 아모데이는 향후 기업들이 더 많은 인력이 아닌 ‘더 적은’ 인력으로 더 높은 생산성을 내는 구조로 변할 것이라 내다봤어요.과거 산업혁명기처럼 새로운 일자리가 자연스럽게 생겨날 것이라는 막연한 낙관론만으로는 설명하기 어려운, 노동의 근본적 가치 변화를 의미해요.

아모데이는 현재 인류가 ‘기술적 사춘기(Technological Puberty)’를 겪고 있다고 비유하며, 이 혼란스러운 시기를 자멸하지 않고 넘기는 것이 무엇보다 중요하다고 역설했어요. AI가 더 똑똑한 AI를 만드는 단계가 본격화될 내년, 우리는 기적과 비상사태 사이 어딘가에 서 있게 될 거예요.

‘광기’로 쌓아 올린 xAI의 바벨탑

실리콘밸리의 전설적인 격언 "빠르게 움직이고 파괴하라(Move fast and break things)"는 일론 머스크의 xAI 앞에서는 점잖은 구호처럼 느껴질 정도예요. 최근 공개된 xAI 엔지니어 슐라이만 고리(Sulaiman Ghori)의 팟캐스트 인터뷰는 전 세계 기술 업계를 충격에 빠뜨렸어요. 그는 회사의 ‘무자비한(Relentless)’ 혁신 과정을 자랑스레 늘어놓았지만, 그 대가로 방송 직후 해고 통보를 받았죠. 그가 폭로한 xAI의 내부 사정은 혁신의 경이로움과 윤리적 공포가 공존하는 기묘한 풍경이었어요.

가장 충격적인 것은 ‘프로젝트 매크로하드(Project Macrohard)’라는 계획이에요. xAI는 부족한 연산 능력을 메우기 위해 북미 전역에 퍼진 400만 대의 테슬라(Tesla) 차량을 ‘분산 슈퍼컴퓨터’로 활용할 계획을 세웠다고 해요.

차주가 잠든 사이 주차되어 유휴 상태인 차량의 칩셋을 원격으로 끌어다 AI 학습에 사용한다는 이 발상은, 자본 효율성 측면에서는 천재적일지 몰라도 소유권과 프라이버시(privacy) 측면에서는 아찔한 도박과도 같아요.

인프라 구축 과정인 ‘프로젝트 콜로서스(Project Colossus)’ 역시 상식을 파괴하는 수준이었어요. 통상 수년이 걸릴 데이터센터 구축을 단 122일 만에 끝내기 위해 그들은 정식 건축 허가 대신 ‘이동식 서커스’용 임시 토지 사용권을 신청해 땅을 밀어버렸다고 해요.

전력망 연결이 지체되자 이동식 가스 터빈 80개를 트럭으로 공수해 자체 발전소를 돌리며 매연과 소음을 감수했고요. 법규와 절차는 그들에게 극복해야 할 물리적 장애물에 불과했던 거죠.

사내 체육관을 ‘워룸(War Room)’으로 개조해 새벽까지 전략 회의를 하고, 24시간 내에 불가능해 보이는 코딩 미션을 완수하면 사이버트럭(Cybertruck)을 선물로 받는 문화는 마치 전시 상황을 방불케 해요. 이곳에서 ‘안 된다’는 말은 금기어라고 하네요.

슐라이만은 자신의 ‘불타버린 재킷’처럼 뜨거웠던 열정을 과시하려다 수백억 원대의 스톡옵션(stock option)을 날리고 퇴출당했어요. 그러나 그가 남긴 증언은 우리에게 묵직한 질문을 던져요.

램프를 떠난 지니

'투자의 귀재' 워런 버핏(Warren Buffett)이 다시 한번 묵직한 화두를 던졌어요. 지난 1월 1일부로 버크셔 해서웨이(Berkshire Hathaway)의 CEO직을 그렉 아벨(Greg Abel)에게 넘기고 일선에서 물러난 그가, 최근 CNBC 특집 방송을 통해 AI(AI)의 위험성을 핵무기 개발에 비유하며 강력한 경고 메시지를 보낸 것이죠.

버핏의 통찰은 언제나 현상의 본질을 꿰뚫는 힘이 있어요. 그는 AI 기술의 급격한 발전을 두고 "램프의 요정 지니(Genie)가 이미 밖으로 나왔다"고 표현했어요. 이제는 되돌릴 수 없다는 뜻이죠. 특히 뼈아픈 지적은 기술을 주도하는 리더들조차 그 끝을 모른다는 사실이에요. 그는 "콜럼버스는 항해하다가도 언제든 배를 돌려 돌아올 수 있었지만, AI는 그렇지 않다"며 기술 발전의 불가역성을 강조했어요. 우리가 어디로 가는지조차 모른 채, 멈출 수 없는 항해를 시작했다는 비유는 어딘가 섬뜩하기까지 하네요.

버핏은 이 상황을 제2차 세계대전 당시 아인슈타인(Einstein)의 우려와 겹쳐 보았어요. "핵무기는 세상 모든 것을 바꿔놓았지만, 단 하나 인간의 사고방식만은 바꾸지 못했다"던 아인슈타인의 말처럼, 기술은 비약적으로 진보했으되 인간의 본성은 그대로라는 것이죠. 버핏은 핵무기 보유국이 하나에서 여덟, 아홉으로 늘어난 역사를 상기시켰어요. "장난감 총만 있어도 위협적인 사람들이 핵무기급 힘을 갖게 되는 상황"에 대한 그의 우려는, AI 기술의 통제 불가능한 확산을 경계하는 목소리로 들려요.

그는 만약 돈으로 핵 확산을 막을 수 있다면 전 재산을 내놓아서라도 즉시 해결하겠다고 말했어요. 그만큼 핵무기와 이에 비견되는 AI의 잠재적 위험을 심각하게 보고 있다는 방증이겠죠. 2015년 주주 서한에서도 이미 사이버, 생물학, 핵 공격을 인류의 가장 큰 위협으로 꼽았던 그의 소신은 여전해 보여요.

2026년, 이제 버크셔 해서웨이의 연례 주주총회 마이크는 후임자 그렉 아벨에게 넘어갔어요. 하지만 "AI는 엄청난 선(good)이 될 수도, 엄청난 해악(harm)이 될 수도 있다"는 노장의 마지막 경고는 우리가 결코 흘려들어서는 안 될 유산이에요. 지니는 이미 램프를 떠났으니까요.

기술의 폭주 속에서, 인간의 자리를 묻다

지금까지 우리는 AI의 머릿속에서 일어나는 미시적인 '생각의 사회(Society of Thought)'부터, 글로벌 패권을 두고 벌어지는 거시적인 '전쟁'까지 숨 가쁘게 달려왔어요. 딥시크(DeepSeek)와 OpenAI가 보여준 기술적 도약은 경이롭지만, 그 이면에서 벌어지는 빅테크들의 탐욕과 갈등, 그리고 워런 버핏의 경고는 우리에게 서늘한 현실 감각을 일깨워주죠.

기술은 기다려주지 않아요. 'AGI의 그 다음 날'은 예고 없이 우리 집 현관문을 두드릴지도 몰라요. 하지만 지니(Genie)가 램프를 떠났다고 해서 우리가 무력하게 지켜만 봐야 하는 건 아니에요. 기술이 강력해질수록, 그 방향키를 쥔 '사람'의 윤리와 책임은 더욱 무거워지니까요.

결국 중요한 건 속도가 아니라 방향이 아닐까요? 쏟아지는 혁신의 파도에 휩쓸려 떠내려가는 것이 아니라, 그 파도 위에서 균형을 잡고 나아갈 길을 보는 지혜가 필요한 시점이에요.

AI가 아무리 똑똑해져도, 서로를 걱정하고 더 나은 미래를 치열하게 고민하는 '인간다움'만큼은 대체할 수 없을 테니까요. 에코 멤버님 모두가 깨어있는 정신으로 이 거대한 변화를 함께 지켜보고 감시하는 현명한 파수꾼이 되어야 해요.

Cinnamomo di Moscata (글쓴이) 소개

게임 기획자입니다. https://www.instagram.com/cinnamomo_di_moscata/

(1) arXiv:2601.10825 [cs.CL]

(2) 박찬. (2026). 미 FTC, 빅테크 ‘인재 빼가기식 인수’ 조사 착수. AI타임스. https://www.aitimes.com/news/articleView.html?idxno=205695

(3) Ashley Capoot, Kate Rooney. (2026). OpenAI tells investors to brace for ‘deliberately outlandish’ claims from Musk ahead of trial. CNBC. https://www.cnbc.com/2026/01/15/openai-to-investors-expect-deliberately-outlandish-claims-from-musk.html

(4) 박찬. (2026). 머스크-알트먼 '사망자' 공방..."챗GPT 9명 vs 오토파일럿 50명 이상". AI타임스. https://www.aitimes.com/news/articleView.html?idxno=205792

(5) Haider. (2026). "Demis recently said in an interview that AI labs are roughly 4-5 months ahead of what they release publicly, and in AI they might not have AGI yet, but even if they do, they'll probably focus first on scaling data centers and energy which is why we're seeing so much investment". X. https://x.com/slow_developer/status/2012268748397494527

(6) Yazhou Sun, Emily Chang. (2026). DeepMind CEO Says Chinese AI Firms Are 6 Months Behind the West. Bloomberg. https://www.bloomberg.com/news/articles/2026-01-20/deepmind-ceo-says-chinese-ai-firms-are-6-months-behind-the-west

(7) World Economic Forum. (2026). The Day After AGI. YouTube. https://www.youtube.com/watch?v=mmKAnHz36v0

(8) Relentless. (2026). WTF is happening at xAI | Sulaiman Ghori. YouTube. https://www.youtube.com/watch?v=8jN60eJr4Ps

(9) DOKI. (2026). "테슬라 개인 차량이 xAI 가상 로봇에 연산력을 제공한다! xAI 전직원에 따르면, xAI의 목표는 가상 로봇 100만 개를 만드는 것이라고 한다. 테슬라는 북미에만 약 400만 대의 차량이 있으며, 이 중 절반 또는 3분의 2가 HW4를 탑재하고 있다고 가정할 수 있다. 이 차량들은 전체 시간의 약 70~80%를". X. https://x.com/doki_jerry/status/2013471264938332633

(10) Jake Conley. (2026). Warren Buffett compares AI risks to those posed by nuclear weapons: 'The genie is out of the bottle'. Yahoo Finance. https://finance.yahoo.com/news/warren-buffett-compares-ai-risks-to-those-posed-by-nuclear-weapons-the-genie-is-out-of-the-bottle-122210523.html