동전의 양면

검은 면

강도 쫓으려다 OpenAI한테 쫓겨나다

최근 OpenAI의 정책을 위반하고 ChatGPT를 이용한 로봇 경비총을 개발한 엔지니어가 차단되었어요. 이 엔지니어는 STS 3D라는 온라인 핸들로, ChatGPT 쿼리에 응답하여 총을 조준하고 발사할 수 있는 로봇을 만들었거든요. 이 발명품은 소셜 미디어에서 큰 논란을 일으켰고, OpenAI는 이를 신속히 차단했어요.

OpenAI는 자사의 서비스가 무기 개발이나 개인 안전에 영향을 미칠 수 있는 시스템 자동화에 사용되는 것을 금지하고 있어요. 하지만 STS 3D의 자동화된 총은 AI 기반 무기 시스템이 인간 중재 없이 적을 공격할 수 있는 미래를 암시했고, 이는 OpenAI에게 큰 우려를 불러일으켰어요.

이 사건은 AI 기술이 군사 목적으로 사용될 가능성에 대한 논의를 촉발시켰어요. 작년에 미국의 한 방위 계약업체는 자율적으로 총알을 발사할 수 있는 AI 기반 로봇 기관총을 선보였는데, ChatGPT와의 통합 가능성도 제기되었거든요.

이와 같은 사건은 AI 기술의 발전과 그에 따른 윤리적 문제에 대한 경각심을 일깨워줘요. 다시 한 번 AI 기술 사용에 대한 책임과 윤리적 고려가 필요할 것 같네요.

애플 인텔리전스보다 빠르게

최근 중국의 로봇 제조업체 UBTech가 애플의 중국 제조 파트너인 폭스콘(FoxConn)과 협력하여 아이폰 조립에 휴머노이드 로봇을 도입하기로 했어요. 이 파트너십은 UBTech의 워커 S1(Walker S1) 로봇이 복잡하고 섬세한 생산 작업을 수행하도록 훈련받는 것을 포함한다고 해요.

워커 S1 로봇은 2024년 10월에 처음 출시되었고, 높이 1.72m, 무게 76kg으로 성인 남성과 유사한 크기를 가지고 있어요. 이 로봇은 시각적 품질 검사, 다양한 크기의 소포 운반, 전동 드라이버를 사용한 나사 조이기, 부품 조립 및 분류 등 다양한 작업을 수행할 수 있다고 해요.

우선은 폭스콘의 전기차 공장에서 로봇이 배치될 예정이고, 로봇의 움직임, 인식 및 의사 결정 능력을 향상시키기 위해 협력할 것이라고 해요. 또한, 일이 많기로 악명 높은 폭스콘에서 인간 노동자에게 가혹한 작업을 자동화하는 데 우선순위를 둘 것이라고 해요.

그러나 한편으로 이런 변화는 돈만 쫒는 악덕 사장들이 인간 노동자를 전부 로봇으로 대체할 수도 있기 때문에 윤리적 고려와 책임 있는 사용이 필요하다는 것을 상기시켜요.

너무 빨라!

AI 업계가 발칵 뒤집혔어요. OpenAI를 비롯한 선두 기업들이 조만간 인간의 복잡한 업무를 수행하는 '박사급 슈퍼 에이전트'를 발표할 것이라는 소문이 무성해요. ChatGPT와 같은 기존 AI를 넘어, 스스로 목표를 설정하고 방대한 정보를 분석해 결과물을 만들어내는 진정한 '지능형 도구'의 등장이 예고된 거에요.

샘 알트만(Sam Altman)은 이미 "지능 시대"를 선언하며 1월 24일 공개한 오퍼레이터(Operator) 뿐만 아니라 정부 관계자들을 대상으로 비공개 브리핑을 계획하고 있어요. 마크 저커버그 메타 CEO 역시 AI가 "중급 엔지니어"를 대체할 수 있다고 언급하며, 일자리 시장의 지각 변동 가능성을 시사했어요. 실제로 슈퍼 에이전트는 소프트웨어 개발, 금융 분석, 물류 관리 등 다양한 분야에서 인간 전문가를 능가하는 효율성과 속도를 보여줄 수 있다고 해요.

하지만 장밋빛 전망만 있는 것은 아니에요. 제이크 설리번(Jake Sullivan) 전 백악관 국가안보보좌관은 AI 발전이 "재앙"으로 이어질 수 있다고 경고하며, 미국과 중국 간 AI 패권 경쟁의 심각성을 강조했어요. 전쟁에서 이기겠다는 탐욕에 눈이 멀어 AI 기술이 무기화되거나, 가짜 뉴스가 범람하고, 일자리가 대량으로 사라질 수 있다는 우려에요. 특히 스티브 배넌(Steve Bannon)과 같은 사람들은 AI가 "일자리를 파괴하는 악"이라고 비판하며, 젊은 세대의 일자리 감소를 걱정하고 있어요.

물론 AI의 '환각' 문제나 신뢰성 확보 등 해결해야 할 과제도 많아요. 하지만 AI 기술의 발전 속도는 예측을 뛰어넘고 있고, 이미 정부와 기업들은 협력하여 AI 시대에 대비해야 한다는 공감대가 형성되고 있어요.

AI 보안의 끝없는 여정

MS의 보안 전문가들이 100개 이상의 자사 생성 AI 제품을 테스트한 결과, AI 모델이 기존의 보안 리스크를 증대시키고 새로운 리스크를 창출한다는 메시지를 전했어요. 그들은 "AI 시스템의 보안 작업은 결코 완성되지 않을 것"이라고 강조했으며, 이를 통해 보안 전문가들에게 끝없는 도전이 될 것임을 시사했다고 해요. 하지만 더 많은 작업을 통해 AI 시스템을 아무리 해킹해도 너무나 많은 시간을 들여야 해서 잠에 지쳐 쓰러지도록 만들 수 있다는 긍정적인 관점도 제시했어요.

예를 들어, LLM의 경우, 모델의 설계 및 적용 방식에 따라 보안 위험이 달라지므로 이와 관련된 철저한 이해가 필요하다는 점을 강조했어요. 또한, 자동화 도구를 통한 보안 작업의 확대와 인간 요소의 중요성도 강조했고요. AI의 보안 리스크는 새로운 도전과 기회를 동시에 제공하고 있고, 이를 통해 보안 전문가들의 역할이 더욱 중요해질 거라네요.

밝은 면

가짜 뉴스도 AI로 안녕!

최근 킬(Keele University)의 연구진이 개발한 AI 도구가 가짜 뉴스를 99%의 정확도로 검출하는 데 성공했어요. 이 AI 도구는 다양한 머신러닝 기법을 활용하여 뉴스 콘텐츠를 분석하고, 그것이 신뢰할 만한지 여부를 판단한다고 해요. 연구진은 "앙상블 투표" 기법을 사용하여 여러 모델의 예측을 종합해 최종 점수를 산출했어요.

연구팀의 대표자인 우체나 아니 박사(Dr. Uchenna Ani)는 "디지털 커뮤니케이션의 진화 속에서 허위 정보의 확산은 큰 문제로, 공공 담론의 신뢰성을 저해하고 지역 및 국가 보안에 위협이 될 수 있습니다"라고 밝혔어요. 앞으로 연구진은 AI 도구의 능력을 더욱 발전시키기 위해 추가 연구를 진행할 계획이라고 해요.

프롬프트 엔지니어링만으로!

구글 딥마인드 연구진이 획기적인 접근법을 제시했습니다. 바로 마인드 에볼루션(Mind Evolution)이라는 진화적 탐색 전략이에요. Mind Evolution은 마치 유전 알고리즘처럼 작동해요. LLM이 다양한 후보 답변을 생성하고, 이들을 평가자를 통해 검증받아요. 평가 결과가 좋은 답변들은 마치 '적자생존'처럼 살아남아 진화해 나가요. Mind Evolution은 이렇듯 간단한 프롬프트 엔지니어링 만으로 유연하게 문제를 해결해요. 마치 인간이 언어를 통해 자유롭게 사고하고 문제를 해결하는 방식과 유사해요.

연구진은 TravelPlanner, Natural Plan과 같은 자연어 테스트를 통해 마인드 에볼루션의 강력함을 입증했어요. Best-of-N이나 Sequential Revision과 같은 기존 추론 전략들을 압도했고, 특히 복잡도가 높은 문제에서 더욱 빛나는 성능을 보여줬어요. 놀라운 점은 제미나이 1.5 프로(Gemini 1.5 Pro) 모델과 마인드 에볼루션을 결합했을 때, 98% 이상의 문제 해결률을 달성했다는 점이에요.

뿐만 아니라, 연구진은 새로운 벤치마크인 StegPoet을 제시했어요. StegPoet은 창의적인 글쓰기 능력과 암호 해독 능력을 동시에 요구하는 난제에요. 숨겨진 메시지를 시나 소설 형태로 암호화해야 하는데, 마인드 에볼루션은 StegPoet에서도 87%의 성공률을 기록하며 그 범용성을 입증했어요. 마인드 에볼루션이 자연어 계획 문제뿐 아니라, 더욱 다양한 영역에서 LLM의 잠재력을 끌어낼 수 있음을 시사해요.

마치 생명의 진화처럼, LLM 스스로 생각하고 발전하며, 인간의 지능에 더욱 가까워지는 미래를 엿볼 수 있게 합니다. 앞으로 마인드 에볼루션이 풀 수 있는 문제의 영역을 얼마나 넓혀줄지 기대되네요.

작은 모델의 반란!

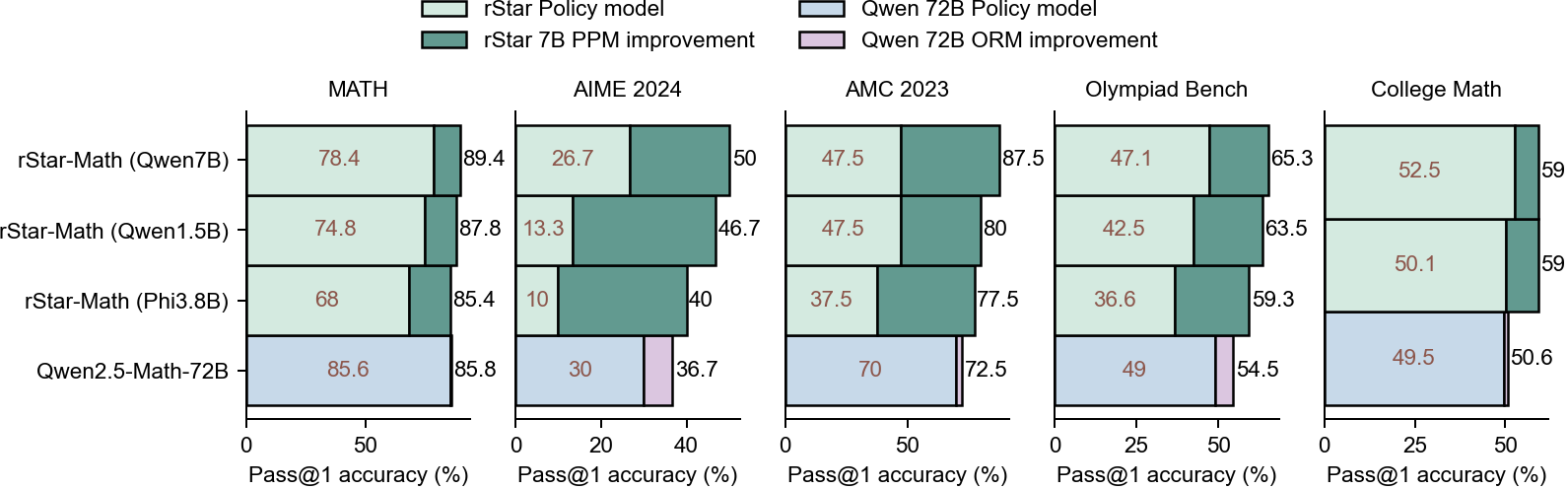

SLM도 '깊은 사고'를 통해 LLM을 능가하는 수학 능력을 발휘할 수 있다는 사실을 MS 연구진이 'rStar-Math'를 통해 입증했어요. 이는 OpenAI의 최신 모델 'o1'을 능가하는 충격적인 결과로, AI 분야에 새로운 가능성을 제시하고 있어요.

rStar-Math의 핵심은 몬테카를로 트리 탐색(MCTS)을 활용한 '심층 사고'에요. 여기서 SLM은 추론 단계를 생성하고, 이를 평가해요. 마치 인간이 어려운 문제를 풀 때처럼, 여러 추론 경로를 탐색하고 힌트를 받아서 최적의 해결책을 찾아나가는 방식이에요. 특히 rStar-Math는 3가지 혁신적인 기술을 통해 SLM의 수학 능력을 극대화했어요.

- '코드 증강 CoT 데이터 합성' 방법은 MCTS 롤아웃으로 단계별 검증된 추론 궤적을 생성해 학습 데이터의 품질을 높였어요.

- '프로세스 선호 모델(PPM) 훈련'은 단계별 점수 부여의 어려움을 극복하고 효과적인 보상 모델을 구축해요.

- '자체 진화 레시피'는 정책 SLM과 PPM을 반복적으로 발전시켜 추론 능력을 점진적으로 향상시켜요

실험 결과는 놀라웠어요. rStar-Math는 MATH 벤치마크에서 Qwen2.5-Math-7B의 성능을 58.8%에서 90.0%로, Phi3-mini-3.8B를 41.4%에서 86.4%로 끌어올리며 OpenAI의 o1-preview와 o1-mini를 능가하는 놀라운 성과를 거뒀어요. 특히, 최고 난이도인 미국 수학 올림피아드(AIME) 문제에서도 평균 53.3%를 해결하며 상위 20%의 고등학생 수준의 실력을 입증했어요.

rStar-Math의 등장은 거대 모델에 의존했던 기존의 패러다임을 전환할 수 있는 잠재력을 보여줘요. 작은 모델로도 충분히 뛰어난 수학 능력을 확보할 수 있고, 자체 진화적인 학습 방식을 통해 지속적인 성능 향상이 가능하다는 것을 시사해요.

파일 검색도 AI로!

MS가 파일 탐색기에 야심찬 새 기능, 시맨틱 검색을 도입한다고 해요. 단순히 파일명이나 키워드 매칭을 넘어, 파일 내용의 '의미'를 파악해 사용자가 원하는 파일을 더욱 빠르고 정확하게 찾아준다는 거에요. 시간만 오래 걸렸던 파일 탐색 기능의 혁신이 눈앞에 다가온 듯해요.

기존 검색 방식의 답답함을 느껴본 사용자라면 시맨틱 검색에 큰 기대를 걸만해요. 이제 "지난주 회의 자료"처럼 애매모호한 검색어로도 원하는 파일을 쉽게 찾을 수 있게 될지도 몰라요. 이를 위해 MS는 PC 내 파일들을 미리 꼼꼼하게 인덱싱하는 과정을 거친다고 해요. 설정에서 간단히 인덱싱 위치를 조정하면 PC 전체를 대상으로 더욱 강력한 검색 기능을 활용할 수 있다다고 해요. TXT, PDF, DOCX 등 주요 문서 파일은 물론 이미지 파일까지 지원한다는 점도 긍정적이에요.

하지만 장밋빛 기대감만 품기에는 이르다고 해요. 스냅드래곤 기반 코파일럿+ PC에서만 우선적으로 배포된다는 소식은 아쉬움을 남겨요.

시맨틱 검색은 분명 파일 탐색의 새로운 지평을 열 잠재력을 지녔어요. 하지만 진정한 '혁신'으로 자리매김하기 위해서는 모든 사용자에게 빠르고 폭넓게 제공되어야 할 거에요. MS가 약속한 대로 빠른 시일 내에 모든 사용자에게 시맨틱 검색의 편리함을 선사해주기를 기대해봐요.

사람이 문제야

우리는 지금 AI라는 거대한 파도 앞에 서 있어요. 쫓아오는 강도를 막으려던 순수한 의도가 오히려 AI 윤리 논쟁의 불씨가 되어 돌아오듯, AI는 우리의 예측과 기대를 뛰어넘는 속도로 발전하며 긍정과 부정, 희망과 우려라는 양날의 검을 우리에게 쥐여주고 있어요.

아이폰 조립 로봇부터 박사급 슈퍼 에이전트, 가짜 뉴스 감별 AI, 그리고 스스로 진화하는 작은 모델까지, AI는 이미 우리 삶 깊숙이 침투하고 있으며, 그 영향력은 상상을 초월해요. AI 보안은 영원히 끝나지 않는 숙제처럼 우리를 따라다닐 것이고, 윤리적 딜레마 역시 끊임없이 제기될 거에요. 하지만 동시에, AI는 가짜 뉴스와 정보의 혼란 속에서 진실을 찾고, 인간의 지능을 뛰어넘는 문제 해결 능력으로 새로운 가능성을 열어줄 빛이 될 수도 있어요.

중요한 것은 AI 기술 자체보다, 그 기술을 어떻게 ‘책임감 있게’ 사용하고 ‘인간과 공존하는 방향’으로 이끌어갈 것인가에 대한 우리의 ‘지혜로운’ 선택일 거에요. 끊임없이 진화하는 AI의 여정을 두려움이 아닌 기대와 책임감으로 맞이하며, 에코 멤버님들이 인류 ‘모두’에게 혜택이 되는 미래를 함께 만들어 나가야 할 때에요.

같이 읽어보면 좋은 글

Cinnamomo di Moscata (글쓴이) 소개

게임 기획자입니다. https://www.instagram.com/cinnamomo_di_moscata/

(1) Victor Tangermann. (2025). OpenAI Cuts Off Engineer Who Created ChatGPT-Powered Robotic Sentry Rifle. Futuruism. https://futurism.com/the-byte/openai-cuts-off-chatgpt-robot-rifle

(2) Christopher McFadden. (2025). Humanoid robots to assemble iPhones in China as UBTech partners with Foxconn. Interesting Engineering. https://interestingengineering.com/innovation/humanoid-robots-to-assemble-iphones-in-china

(3) Mike Allen, Jim VandeHei. (2025). Behind the Curtain — Coming soon: Ph.D.-level super-agents. Axios. https://www.axios.com/2025/01/19/ai-superagent-openai-meta

(4) Jim VandeHei, Mike Allen. (2025). Behind the Curtain: A chilling, "catastrophic" warning. Axios. https://www.axios.com/2025/01/18/biden-sullivan-ai-race-trump-china

(5) Thomas Claburn. (2025). Microsoft eggheads say AI can never be made secure – after testing Redmond's own products. The Register. https://www.theregister.com/2025/01/17/microsoft_ai_redteam_infosec_warning/

(6) Andy Cain, Keele University. (2025). New AI tool detects fake news with 99% accuracy. TechXplore. https://techxplore.com/news/2025-01-ai-tool-fake-news-accuracy.html

(7) arXiv:2501.09891 [cs.AI]

(8) arXiv:2501.04519 [cs.CL]

(9) Mark Hachman. (2025). 키워드 없이 찾는다…마이크로소프트, 윈도우 시맨틱 검색 테스트. IT World. https://www.itworld.co.kr/article/3807118/%ED%82%A4%EC%9B%8C%EB%93%9C-%EC%97%86%EC%9D%B4-%EC%B0%BE%EB%8A%94%EB%8B%A4%EB%A7%88%EC%9D%B4%ED%81%AC%EB%A1%9C%EC%86%8C%ED%94%84%ED%8A%B8-%EC%9C%88%EB%8F%84%EC%9A%B0-%EC%8B%9C%EB%A7%A8.html

뉴스레터 광고 공간 (광고주를 모집합니다)

For newsletter banner advertising inquiries, please contact: Bopyo@aikoreacommunity.com

이곳에 서비스를 소개하세요!

뉴스레터 배너 광고 문의: Bopyo@aikoreacommunity.com

뉴스레터 편집장 소개

- 보표 홈페이지

- https://amzbopyo.com/

- 보표 SNS

- 보표 레터: https://www.bopyoletters.com/

- X(트위터): https://twitter.com/AIBopyo

- 스레드: https://www.threads.net/@bopyo.amz

- 링크드인: https://www.linkedin.com/in/bopyo-park-848631231/

- 인스타그램: https://www.instagram.com/bopyo.amz/

- AI 코리아 커뮤니티 아카데미

- https://app.aikoreacommunity.com/collections/932400